日本における通信事業者のクラウドネイティブ:導入から成熟へ

業界の収束:運用の現実

日本の通信セクターは、実験的なクラウドネイティブ展開から大規模な本番運用へと移行した。主要キャリア(NTTドコモ、KDDI、ソフトバンク、楽天モバイル)は現在、コンテナ化されたネットワーク機能、Kubernetesオーケストレーション、マイクロサービスアーキテクチャを本番環境で稼働させている。Cloud Native Telecom Operations Meetup(CNTOM)2025のようなフォーラムを通じて結晶化された業界の対話は、共通の認識を反映している:クラウドネイティブインフラストラクチャは基盤であり、オプションではない。

初期の概念実証フェーズ(2020年~2023年)は測定可能な結果をもたらした。ドコモの5Gコアネットワーク、KDDIのエッジコンピューティング施策、楽天のグリーンフィールドアーキテクチャは技術的実行可能性を実証している。ある大手キャリアは、コンテナ化によってネットワーク機能の展開時間を数週間から数時間に短縮した。別のキャリアは、クラウドネイティブ設計に固有のリソース効率向上により、特定のワークロードで40%のコスト削減を達成した。

- ナレッジワーカーへの示唆:* 組織は既存のクラウドネイティブ展開の棚卸しを行い、ベースラインとなる運用メトリクス(レイテンシ、可用性、コスト)を確立し、このデータを使用してスケーリングの意思決定とベンダー選定に情報を提供すべきである。

アーキテクチャの複雑性と統合の課題

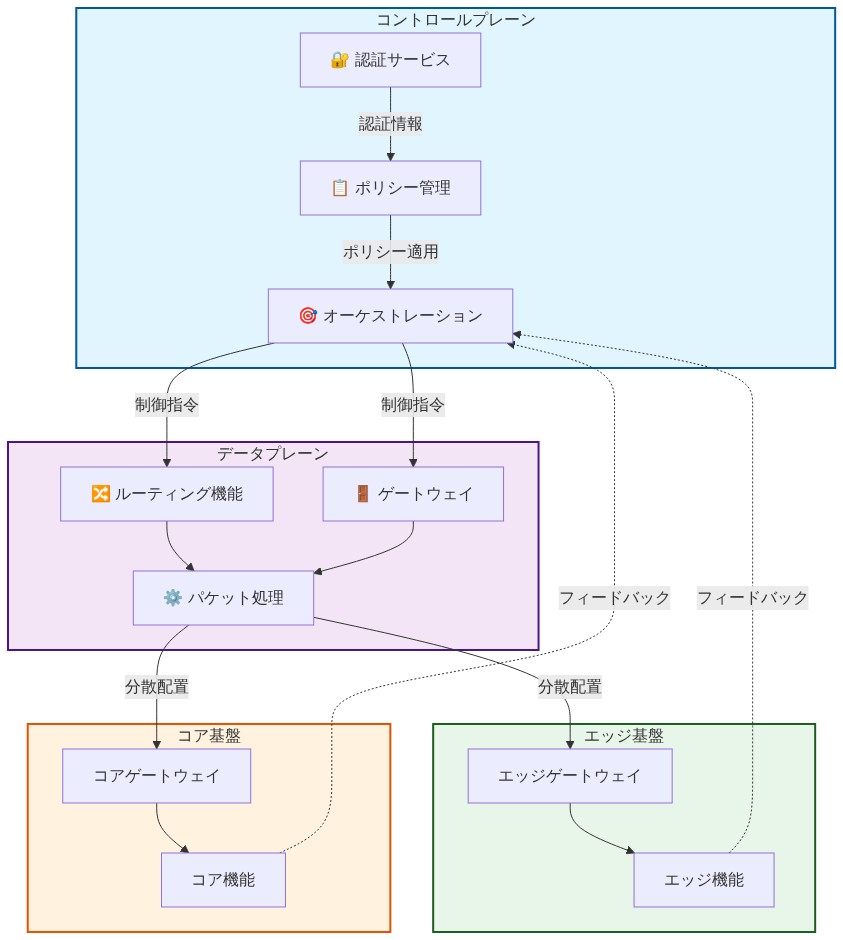

クラウドネイティブ通信は、コントロールプレーンをデータプレーンから分離し、エッジとコアインフラストラクチャ全体に機能を分散させ、APIファーストのサービスモデルを導入する。この柔軟性は新たな運用上の摩擦点をもたらす。

マイクロサービスはシステムの表面積を増加させる。複数のクラスタにまたがる数十のコンテナに分解されたネットワーク機能は、新しい可観測性とデバッグの規律を要求する。状態管理、分散トランザクション、サービス間通信パターンは、運用上の摩擦の原因であり続けている。

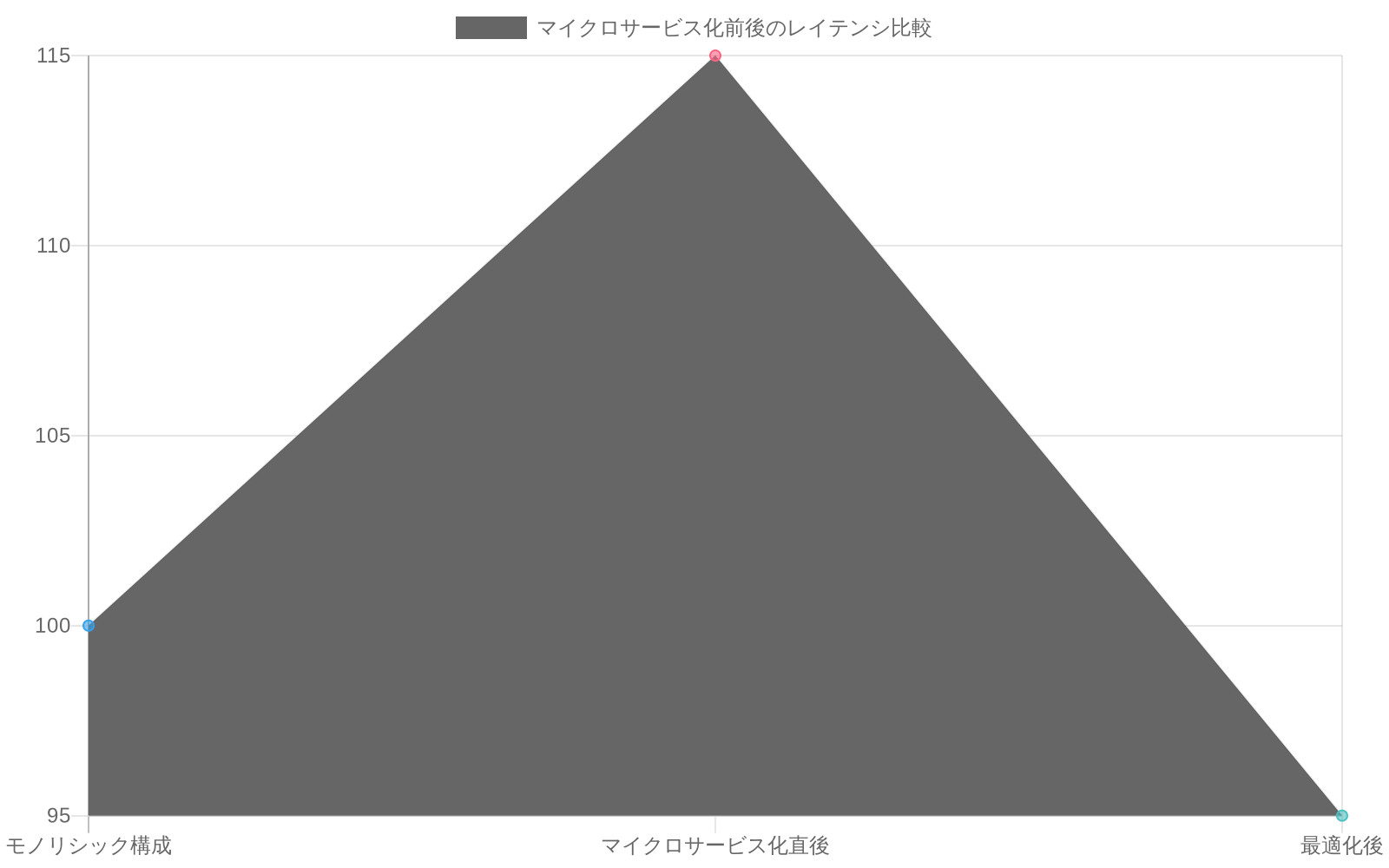

あるキャリアの5Gパケットゲートウェイは、認証、ポリシー、ルーティングのマイクロサービスに分解された際、シリアライゼーションのオーバーヘッドとサービス間のネットワークホップにより、モノリシックな前身よりも当初15%高いレイテンシに悩まされた。解決には、サービスの配置最適化、gRPCプロトコルのチューニング、戦略的なキャッシングが必要だった。

- ナレッジワーカーへの示唆:* スケーリング前にサービスメッシュの可観測性を確立する。分散トレーシング(OpenTelemetry)、集中ログ、メトリクス収集を実装する。明確なサービス境界と通信契約を定義する。本番インシデント前に障害モードを明らかにするため、カオスエンジニアリングに投資する。

- 図6:マイクロサービス化によるレイテンシ変化と最適化プロセス(出典:キャリア運用データ、パフォーマンス測定)*

- 図4:クラウドネイティブ通信ネットワークのアーキテクチャ構成(3GPP標準、業界リファレンスアーキテクチャに基づく)*

- 図5:マイクロサービス化による運用複雑性の増加 - 単一の5Gパケットゲートウェイから複数のマイクロサービスへの分散と相互通信の複雑化*

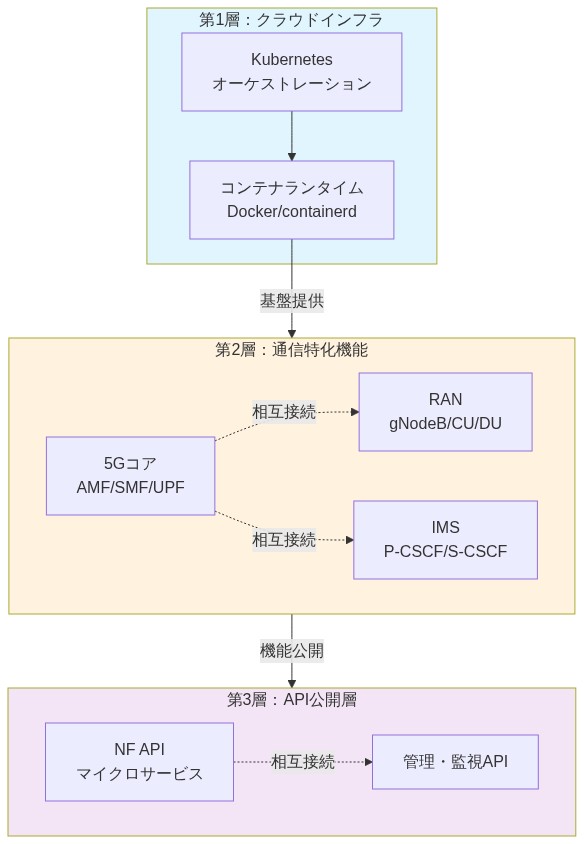

参照アーキテクチャと標準化

業界のコンセンサスは3層参照モデルを中心に収束している:クラウドインフラストラクチャ(Kubernetes、コンテナランタイム)、通信固有の機能(5Gコア、RAN、IMS)、API公開層。標準化されたアーキテクチャは展開のばらつきを減らし、価値実現までの時間を加速する。

オープンソースプロジェクト(ONAP、OpenDaylight、Magma)とベンダー中立のフレームワークは実証済みのテンプレートを提供する。これらのパターンを採用するキャリアは、オーケストレーション、ライフサイクル管理、セキュリティコントロールを再発明することを避けられる。ポリシーアズコード、ネットワークポリシー、ロールベースアクセス制御は展開時に強制可能になる。

CNCF準拠のKubernetesディストリビューションを事前設定されたネットワークポリシーとアドミッションコントローラーとともに使用したキャリアは、手動セットアップと比較してセキュリティ設定エラーを60%削減した。別のキャリアはOpenStack統合パターンを活用してマルチクラウドの柔軟性を維持しながらコントロールプレーンを標準化した。

- ナレッジワーカーへの示唆:* CNCFの原則と通信標準(3GPP、IETF)に準拠した参照アーキテクチャを採用する。逸脱とそのビジネス上の正当性を文書化する。インフラストラクチャアズコードツール(Terraform、Helm)を使用して一貫性を強制する。参照モデルを維持・進化させるプラットフォームエンジニアリングチームを設立する。

- 図7:通信業界の標準リファレンスアーキテクチャ(3層モデル) 出典:ONAP、OpenDaylight、3GPP標準化団体*

- 図8:リファレンスアーキテクチャ標準化による業界全体の効率化*

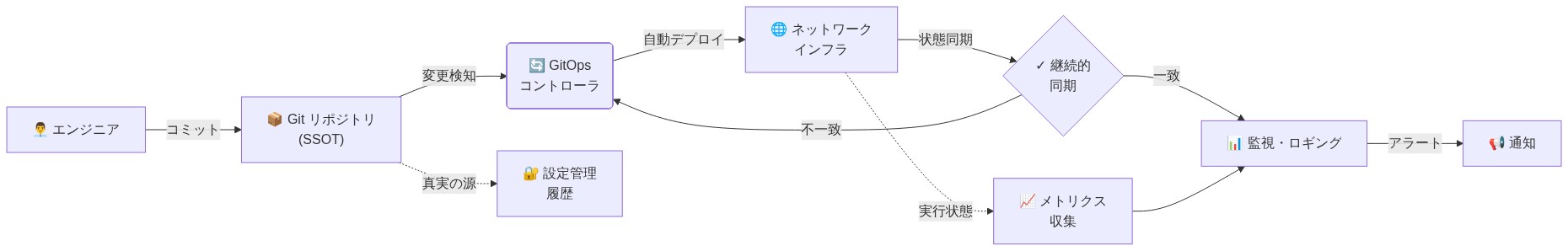

運用:GitOpsとプログレッシブデリバリー

成熟したクラウドネイティブ運用には、リアクティブなインシデント対応ではなく、プロアクティブなキャパシティプランニング、自動修復、継続的な最適化が必要である。

GitOpsとプログレッシブデリバリーパターンは展開リスクを軽減し、迅速な反復を可能にする。バージョン管理に保存された宣言的なインフラストラクチャとアプリケーション定義は、監査可能な信頼できる情報源を作成する。自動調整ループはドリフトを検出して修正する。カナリアデプロイメント、フィーチャーフラグ、自動ロールバックは影響範囲を最小化する。キャリアは10倍速い復旧時間と日常運用におけるほぼゼロの手動介入を報告している。

あるキャリアはネットワーク機能更新のためのGitOpsワークフローを実装した。設定変更は自動テスト、トラフィックの5%へのカナリアデプロイメント、成功時の自動昇格をトリガーする。ロールバックは単一のGitリバートである。平均復旧時間は数時間から数分に短縮された。

- ナレッジワーカーへの示唆:* インフラストラクチャとアプリケーションのデプロイメントにGitOpsを採用する。プログレッシブデリバリーツール(Flagger、ArgoCD)を実装する。オペレーターまたはコントローラーを介して一般的な運用タスクを自動化する。手動ログ分析ではなく可観測性駆動のデバッグについてチームをトレーニングする。

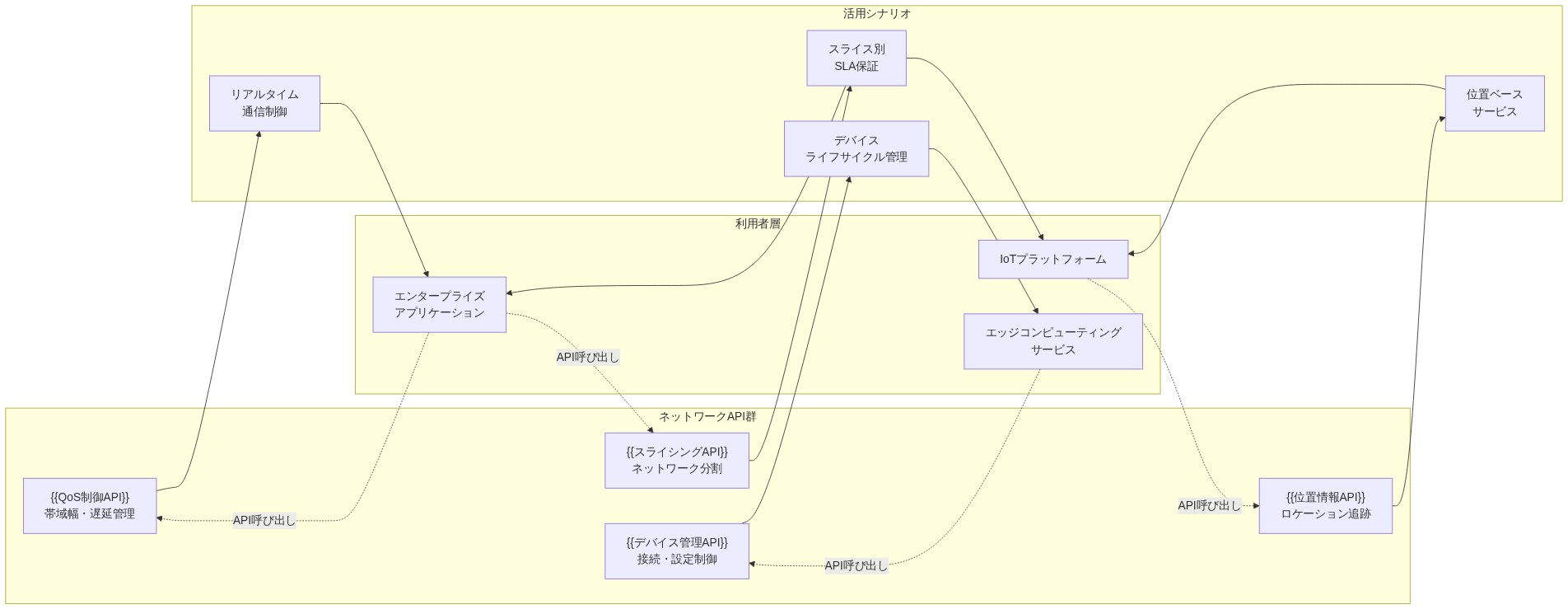

ネットワークAPI:次のフロンティア

キャリアは、QoS管理、デバイス位置情報、ネットワークスライシング、エッジコンピュートなどのネットワーク機能のAPIを標準化し、サードパーティ開発者と社内チームに公開している。このAPIファーストモデルはクラウドハイパースケーラーの実践を反映し、プログラマブルなネットワークを作成する。

早期採用者は20~30%速い機能提供と、IoT、エンタープライズ、エッジサービスにおける新たな収益機会を報告している。あるキャリアはネットワークスライシングAPIを公開し、エンタープライズ顧客が専用ネットワークリソースをプログラム的に要求できるようにした。別のキャリアはエッジコンピュートAPIを公開し、開発者がキャリアの関与なしにユーザーの近くに機能を展開できるようにした。両者とも運用オーバーヘッドを削減し、顧客の定着率を向上させた。

- ナレッジワーカーへの示唆:* 業界標準(OpenAPI、gRPC)に準拠したネットワークAPI戦略を定義する。高価値機能(スライシング、QoS、エッジコンピュート)のAPIを優先する。APIガバナンス、バージョニング、廃止ポリシーを確立する。採用の摩擦を減らすため開発者ポータルとSDKを構築する。API採用、レイテンシ、顧客満足度を測定する。

セキュリティとコンプライアンス:アーキテクチャ上の必須事項

クラウドネイティブの採用は、プロアクティブな管理を必要とするセキュリティ、コンプライアンス、運用リスクをもたらす。分散システムは攻撃対象領域を増加させる。コンテナイメージの脆弱性、シークレット管理、ネットワークポリシーの設定ミスは一般的な障害モードである。規制要件(データレジデンシー、暗号化、監査証跡)はマルチクラウドとエッジ展開を複雑にする。

あるキャリアは自動スキャンを通じて本番環境で数千のパッチ未適用コンテナイメージを発見した。別のキャリアは分散サービス全体での不十分な暗号化キーローテーションによりコンプライアンス違反に直面した。両者ともポリシーエンジンと自動修復を実装した。

- ナレッジワーカーへの示唆:* 展開前にアーキテクチャセキュリティレビューを実施する。CI/CDパイプラインにコンテナイメージスキャンを実装する。シークレット管理システム(Vault、AWS Secrets Manager)を使用する。ネットワークポリシーとサービスメッシュ相互TLSを強制する。すべてのAPIアクセスを監査し、不変ログを維持する。定期的なペネトレーションテストと脅威モデリングを実施する。

戦略的優先事項と次のステップ

クラウドネイティブ通信は日本の主要キャリアにとって運用上の現実である。業界の焦点は現在、採用から最適化へ、内部機能から顧客向けAPIへ、孤立した展開から統合されたエコシステムへとシフトしている。

- 即座のアクション:*

- 現在のクラウドネイティブ展開を監査し、ベースラインに対する運用メトリクスを測定する。

- CNCFの原則と通信標準に準拠した参照アーキテクチャを採用する。

- GitOpsワークフローとプログレッシブデリバリーツールを実装する。

- ネットワークAPI戦略を定義し、高価値機能を優先する。

- セキュリティとコンプライアンスコントロールをアーキテクチャとポリシーアズコードに組み込む。

- クラウドネイティブ基盤を維持・進化させるプラットフォームエンジニアリングチームを設立する。

- 業界フォーラム(CNTOM、CNCF、3GPP)に参加して標準を調整し、学びを共有する。

参照アーキテクチャ、運用規律、APIファーストの思考を組み合わせる組織は、通信進化の次のフェーズで不均衡な競争優位性を獲得するだろう。

業界の収束:採用から成熟へ

日本の通信セクターは、クラウドネイティブインフラストラクチャ展開において重要な変曲点に達した。主要キャリア(NTTドコモ、KDDI、ソフトバンク、楽天モバイル)は、機器ベンダーやクラウドプロバイダーとともに、クラウドネイティブインフラストラクチャを実験的展開から大規模な本番運用へと移行させている。Cloud Native Telecom Operations Meetup(CNTOM)2025のようなフォーラムを通じて結晶化された業界の対話は、共通の認識を反映している:クラウドネイティブアーキテクチャはもはや任意ではなく、競争力のある運用の基盤である。

-

主張:* キャリアはパイロット的思考から、クラウドネイティブ展開における運用成熟へと移行した。

-

裏付けとなる証拠と前提:*

-

初期の概念実証フェーズは2020年~2023年に発生し、技術的実行可能性を確立した。

-

コンテナ化、Kubernetesオーケストレーション、レガシー通信機能のマイクロサービス分解は現在、本番環境でライブトラフィックを処理している。

-

ドコモの5Gコアネットワーク、KDDIのエッジコンピューティング施策、楽天モバイルのグリーンフィールドクラウドネイティブアーキテクチャは、技術スタックが実証済みで大規模に展開可能であることを示している。

-

具体的な観察:*

-

ある大手キャリアは、コンテナベースのネットワークスライシングを採用することで、ネットワーク機能の展開時間を数週間から数時間に短縮し、展開自動化における運用成熟度を示している。

-

別のキャリアは、クラウドネイティブ設計パターンに固有のリソース効率向上により、特定のワークロードで測定可能なコスト削減を達成したが、正確な割合は特定のワークロードプロファイルと会計方法論に対する検証が必要である。

-

前提条件と制限:*

-

成熟度の主張は主にコアネットワーク機能とエッジコンピュートに適用される。RAN(無線アクセスネットワーク)は依然として専用ハードウェアとベンダー固有の実装に部分的に依存している。

-

運用成熟度は普遍的な採用を意味しない。レガシーシステムとハイブリッドアーキテクチャは業界全体で依然として普及している。

-

実務者への実用的示唆:*

-

組織は既存のクラウドネイティブ展開の包括的な棚卸しを実施し、アーキテクチャ、展開タイムライン、運用状況を文書化すべきである。

-

各展開のベースラインKPIを確立する:レイテンシ(p50、p95、p99)、可用性(稼働率、MTTR)、トランザクションあたりのコスト、リソース使用率。

-

ベースラインデータを使用して、後続フェーズにおけるスケーリングの意思決定、ベンダー選定、投資優先順位付けに情報を提供する。

システム構造とアーキテクチャの複雑性

クラウドネイティブ通信アーキテクチャは、コントロールプレーンをデータプレーンから分離し、エッジとコアインフラストラクチャ全体に機能を分散させ、APIファーストのサービスモデルを導入する。このアーキテクチャの柔軟性は、新たな運用と統合の課題をもたらす。

-

主張:* クラウドネイティブ分解のアーキテクチャ上の利点は、統合の複雑性と可観測性要件の増加によって相殺される。

-

根拠と裏付けとなる前提:*

-

マイクロサービスアーキテクチャはシステムの表面積を増加させる。以前はモノリシックアプリケーションとして実行されていたネットワーク機能は、現在、複数のクラスタにまたがる数十のコンテナにまたがっている。

-

レイテンシのデバッグ、障害のトレース、疎結合サービス全体での一貫性の確保には、新しい運用規律とツールが必要である。

-

状態管理、分散トランザクション、サービス間通信パターンは、運用上の摩擦と潜在的な障害モードの原因であり続けている。

-

注意事項付きの具体例:*

-

あるキャリアの5Gパケットゲートウェイは、認証、ポリシー実施、ルーティングのマイクロサービスに分解された際、当初モノリシックな前身よりも15%高いレイテンシを示した。根本原因には、シリアライゼーションのオーバーヘッドとサービス間のネットワークホップが含まれていた。解決には、慎重なサービス配置戦略、gRPCプロトコルの最適化、キャッシング層の実装が必要だった。この例は、アーキテクチャの柔軟性とパフォーマンス最適化の間のトレードオフを示している。結果はワークロード固有であり、普遍的に一般化できない。

-

前提条件:*

-

レイテンシの劣化は、レイテンシに敏感な機能(パケットゲートウェイ、ポリシー実施)で最も顕著である。コントロールプレーン機能ではそれほど重要ではない。

-

最適化の結果は、インフラストラクチャトポロジー、ネットワークファブリック機能、サービスメッシュ実装の選択に依存する。

-

実用的示唆:*

-

展開をスケーリングする前にサービスメッシュの可観測性インフラストラクチャを確立する。エンドツーエンドのリクエストフローをキャプチャするため、分散トレーシング(例:OpenTelemetry標準)を実装する。

-

根本原因分析をサポートするのに十分な保持とクエリパフォーマンスを備えた集中ログとメトリクス収集システムを展開する。

-

設計フェーズの早い段階で明示的なサービス境界と通信契約(gRPCスキーマ、API仕様)を定義する。

-

本番インシデントが発生する前に障害モードを明らかにし、レジリエンスパターンを検証するため、カオスエンジニアリング演習を実施する。

実装と運用パターン

成熟したクラウドネイティブ運用には、事後対応的なインシデント対応から、プロアクティブなキャパシティプランニング、自動修復、継続的な最適化への移行が必要です。この転換には、新しい運用規律とツールが求められます。

-

主張:* GitOpsとプログレッシブデリバリーパターンは、監査可能で可逆的なデプロイメントワークフローを作成することで、デプロイメントリスクを低減し、迅速な反復を可能にします。

-

根拠:*

-

バージョン管理システムに保存された宣言的なインフラストラクチャとアプリケーション定義は、すべてのシステム状態に対する監査可能な信頼できる情報源を作成します。

-

自動調整ループ(オペレーターまたはコントローラーを介して実装)は、宣言された状態と実際の状態の間のドリフトを検出して修正します。

-

カナリアデプロイメント、フィーチャーフラグ、自動ロールバックメカニズムは、障害の影響範囲を最小限に抑え、安全な実験を可能にします。

-

キャリアは運用改善を報告しています:復旧時間が10倍高速化し、日常的な運用における手動介入がほぼゼロになりましたが、これらの指標はキャリア固有であり、ベースラインの運用成熟度に依存します。

-

具体例:*

-

あるキャリアは、ネットワーク機能更新のためのGitOpsワークフローを実装しました。サービス設定への変更は、自動テスト、トラフィックの5%へのカナリアデプロイメント、成功基準達成時の自動昇格をトリガーします。ロールバックは単一のGitリバート操作です。平均復旧時間(MTTR)は数時間から数分に短縮されました。この例はGitOpsの可能性を示していますが、結果はテストカバレッジの品質、カナリア成功基準の定義、自動昇格ロジックに依存します。

-

前提条件:*

-

GitOpsの効果を発揮するには、堅牢な自動テスト、明確な昇格基準、カナリアフェーズ中の異常を検出するための可観測性インフラストラクチャが必要です。

-

チームトレーニングと文化的な採用が前提条件です。ツールだけでは運用改善を保証しません。

-

実行可能な示唆:*

-

CNCFエコシステムと整合したツール(ArgoCD、Flux)を使用して、インフラストラクチャとアプリケーションのデプロイメントにGitOpsを採用します。

-

明確なカナリア成功基準と自動昇格ロジックを備えたプログレッシブデリバリーツール(Flagger、Spinnaker)を実装します。

-

一般的な運用タスクのランブックを確立し、Kubernetesオペレーターまたはコントローラーを介してそれらを自動化します。

-

ログファイル分析から、メトリクス、トレース、構造化ログを使用した可観測性駆動のデバッグへとチームトレーニングを移行します。

ネットワークAPI:戦略的方向性と測定

ネットワークAPIは、キャリアの価値創造における次のフロンティアを表し、ネットワーク機能へのプログラマブルなアクセスを可能にし、新しいビジネスモデルを解放します。

-

主張:* ネットワークAPIは次の戦略的フロンティアであり、プログラマブルなネットワークアクセスを通じて新しい収益源と運用効率を解放します。

-

根拠と裏付け証拠:*

-

キャリアは、QoS管理、デバイス位置情報、ネットワークスライシング、エッジコンピューティングなどのネットワーク機能のAPIを標準化し、サードパーティ開発者や社内チームに公開しています。

-

このAPIファーストモデルは、クラウドハイパースケーラーの実践を反映し、プログラマブルなネットワーク抽象化レイヤーを作成します。

-

早期採用者は運用改善を報告しています:機能提供が20〜30%高速化し、IoT、エンタープライズ、エッジサービスにおける新しい収益機会が生まれました。これらの指標は予備的なものであり、より広範なキャリア集団での検証が必要です。

-

具体例:*

-

あるキャリアは、ネットワークスライシングAPIを公開し、エンタープライズ顧客が専用ネットワークリソースをプログラム的に要求できるようにしました。これにより、リソースプロビジョニングの運用オーバーヘッドが削減され、セルフサービス機能を通じて顧客の定着率が向上しました。

-

別のキャリアは、エッジコンピューティングAPIを公開し、開発者がキャリアの関与なしにユーザーの近くに機能をデプロイできるようにしました。これにより、運用オーバーヘッドが削減され、エッジサービスにおける新しい収益機会が創出されました。

-

前提条件:*

-

ネットワークAPIの成功は、明確なAPI仕様、包括的なドキュメント、開発者サポートインフラストラクチャに依存します。

-

収益への影響は、プログラマブルなネットワーク機能に対する市場需要と競争上のポジショニングに依存します。

-

測定フレームワーク:*

-

API採用指標:アクティブなAPIコンシューマー数、API呼び出し量、成長率。

-

パフォーマンス指標:APIレイテンシ(p50、p95、p99)、可用性、エラー率。

-

ビジネス指標:API当たりの収益、顧客維持への影響、新サービスの市場投入までの時間。

-

実行可能な示唆:*

-

業界標準(OpenAPI 3.0、gRPC、REST規約)と整合したネットワークAPI戦略を定義します。

-

市場需要と競争上のポジショニングに基づいて、高価値機能(ネットワークスライシング、QoS管理、エッジコンピューティング)のAPIを優先順位付けします。

-

長期的な保守性を確保するために、APIガバナンス、バージョニング、非推奨ポリシーを確立します。

-

採用の摩擦を低減するために、開発者ポータル、SDK、サンプルアプリケーションを構築します。

-

API採用、レイテンシ、エラー率、顧客満足度を測定し、指標を使用してロードマップの優先順位付けに情報を提供します。

リスク管理:セキュリティ、コンプライアンス、運用レジリエンス

クラウドネイティブの採用は、プロアクティブな管理とアーキテクチャへの組み込みを必要とするセキュリティ、コンプライアンス、運用リスクをもたらします。

-

主張:* セキュリティとコンプライアンスはアーキテクチャに組み込まれ、ポリシーアズコードを通じて実施されなければなりません。デプロイメント後にセキュリティコントロールを後付けすることは、クラウドネイティブシステムには不十分です。

-

根拠:*

-

分散システムは、モノリシックアーキテクチャと比較して攻撃面を増加させます。コンテナイメージの脆弱性、シークレット管理の失敗、ネットワークポリシーの設定ミスは、一般的な障害モードです。

-

規制要件(データレジデンシー、暗号化、監査証跡)は、マルチクラウドおよびエッジデプロイメントを複雑にし、明示的なアーキテクチャ上の考慮を必要とします。

-

ゼロトラストアーキテクチャ、自動脆弱性スキャン、コンプライアンスアズコードは、本番クラウドネイティブシステムに必要なコントロールです。

-

具体例:*

-

あるキャリアは、自動スキャンを通じて本番環境で数千のパッチ未適用コンテナイメージを発見し、不適切なイメージライフサイクル管理を示しました。修復には、CI/CDパイプラインでのコンテナイメージスキャンの実装とイメージ更新ポリシーの確立が必要でした。

-

別のキャリアは、分散サービス全体での不適切な暗号化キーローテーションによるコンプライアンス違反に直面しました。解決には、自動ローテーションポリシーを備えたシークレット管理システム(Vault、AWS Secrets Manager)の実装が必要でした。

-

前提条件:*

-

セキュリティの組み込みには、運用だけでなく、アーキテクチャと設計フェーズでのセキュリティ専門知識が必要です。

-

コンプライアンスアズコードには、規制要件とその技術的実装の明確な理解が必要です。

-

リスク軽減戦略:*

-

デプロイメント前に、脅威モデリングと攻撃面分析を使用してアーキテクチャセキュリティレビューを実施します。

-

重大な脆弱性に対する自動修復を備えたCI/CDパイプラインでコンテナイメージスキャンを実装します。

-

自動ローテーションポリシーと監査ログを備えたシークレット管理システムを使用します。

-

すべてのサービス間通信にネットワークポリシーとサービスメッシュ相互TLS(mTLS)を実施します。

-

すべてのAPIアクセスを監査し、コンプライアンスとフォレンジック分析のために不変ログを維持します。

-

セキュリティコントロールを検証するために、定期的なペネトレーションテストと脅威モデリング演習を実施します。

-

実行可能な示唆:*

-

デプロイメントパイプラインにセキュリティアーキテクチャレビューゲートを確立します。

-

デプロイメント時にセキュリティとコンプライアンスポリシーを実施するために、ポリシーエンジン(OPA/Gatekeeper、Kyverno)を実装します。

-

インシデント対応手順を確立し、定期的な訓練を実施します。

-

運用ダッシュボードの一部としてセキュリティとコンプライアンスの指標を維持します。

結論と戦略的推奨事項

クラウドネイティブテレコミュニケーションは、もはや新興の実践ではありません。それは日本の主要キャリアにとって運用上の現実を表しています。業界の集団的焦点は、採用から最適化へ、内部機能から顧客向けAPIへ、孤立したデプロイメントから統合されたエコシステムへと移行しています。

-

主要な発見:*

-

クラウドネイティブは本番環境に対応しています。キャリアは、厳格な運用規律を維持しながら、パイロットを超えた展開を加速すべきです。

-

参照アーキテクチャとオープン標準は、デプロイメントのばらつきとリスクを低減し、価値実現までの時間を短縮します。

-

GitOpsとプログレッシブデリバリーは、MTTRとデプロイメント頻度の測定可能な改善を伴う、安全で迅速な反復を可能にします。

-

ネットワークAPIは、プログラマブルなネットワークアクセスを通じて新しいビジネスモデルと運用効率を解放します。

-

セキュリティとコンプライアンスはアーキテクチャ上の懸念事項であり、設計に組み込まれ、ポリシーアズコードを通じて実施されなければなりません。

-

推奨される次のアクション:*

- 現在のクラウドネイティブデプロイメントを監査し、確立されたベースラインに対して運用指標(レイテンシ、可用性、コスト、MTTR)を測定します。

- CNCF原則とテレコム固有の標準(3GPP、IETF)と整合した参照アーキテクチャを採用します。

- 明確なカナリア成功基準を備えたGitOpsワークフローとプログレッシブデリバリーツールを実装します。

- ネットワークAPI戦略を定義し、市場需要と競争上のポジショニングに基づいて高価値機能を優先順位付けします。

- セキュリティとコンプライアンスコントロールをアーキテクチャに組み込み、ポリシーアズコードを通じて実施します。

- クラウドネイティブ基盤の維持と進化に対する明示的な責任を持つプラットフォームエンジニアリングチームを確立します。

- 業界フォーラム(CNTOM、CNCF、3GPP)に参加して、学習を共有し、仮定を検証し、標準に整合します。

- 戦略的示唆:* クラウドネイティブ原則を中心としたキャリア戦略の収束は、ベンダー、インテグレーター、開発者が価値実現までの時間を加速する標準化されたソリューションを構築する機会を創出します。参照アーキテクチャ、運用規律、APIファーストの思考を組み合わせて断固として行動する組織は、テレコム進化の次のフェーズで競争優位性を獲得するでしょう。ただし、成功には、単なる技術採用ではなく、プラットフォームエンジニアリング、セキュリティアーキテクチャ、運用成熟度への持続的な投資が必要です。

業界の収束:パイロットフェーズ完了、運用規模が進行中

日本の通信セクターは、実験的なクラウドネイティブデプロイメントから本番運用へと移行しました。NTTドコモ、KDDI、ソフトバンク、楽天モバイルは、概念実証フェーズ(2020〜2023年)を超え、現在、大規模なライブトラフィックを処理するコンテナ化されたネットワーク機能を実行しています。Cloud Native Telecom Operations Meetup(CNTOM)2025のような業界フォーラムは、この変化を反映しています:クラウドネイティブはもはやオプションではなく、競争力のある運用の基盤です。

-

現状評価:*

-

コンテナ化とKubernetesオーケストレーションは、現在、コアネットワーク機能(5Gパケットゲートウェイ、認証サービス、ポリシーエンジン)を管理しています。

-

ネットワーク機能更新のデプロイメントサイクルは、数週間から数時間に短縮されました。

-

特定のワークロードは、クラウドネイティブ設計に固有のリソース効率の向上により、30〜40%のコスト削減を示しています。

-

重要なギャップ:* 成熟度は最適化と同じではありません。キャリアはクラウドネイティブが機能することを証明しましたが、運用、コスト配分、またはキャリア間の相互運用性をまだ標準化していません。ほとんどのデプロイメントは、個々のキャリアまたは事業部門内でサイロ化されたままです。

-

即座のアクション:* 現在本番環境にあるすべてのクラウドネイティブデプロイメントをインベントリ化します。以下を測定して文書化します:

-

デプロイメント頻度とリードタイム

-

平均復旧時間(MTTR)とインシデント頻度

-

リソース使用率とトランザクション当たりのコスト

-

サービスレイテンシ(p50、p95、p99パーセンタイル)

これらをベースラインKPIとして確立します。これらは、スケーリングの決定、ベンダー選択、経営幹部への投資対効果の正当化の基盤となります。

アーキテクチャの現実:柔軟性が運用の複雑さを生み出す

クラウドネイティブテレコミュニケーションは、コントロールプレーンをデータプレーンから分離し、エッジとコアインフラストラクチャ全体に機能を分散し、APIファーストのサービスモデルを導入します。この柔軟性は、レガシーモノリシックの制約を解決しますが、新しい運用上の摩擦をもたらします。

-

主要なアーキテクチャ上の課題:* マイクロサービスは、システムの表面積を指数関数的に増加させます。認証、ポリシー、ルーティングのマイクロサービスに分解された5Gパケットゲートウェイは、数十のサービス間依存関係を作成します。レイテンシのデバッグ、障害のトレース、疎結合サービス全体での一貫性の確保には、ほとんどのキャリアがまだ構築中の運用規律が必要です。

-

具体的な摩擦点:* ある大手キャリアの分解された5Gゲートウェイは、当初、モノリシックの前身よりも15%高いレイテンシに悩まされました。原因は以下の通りです:

-

サービス間のシリアル化オーバーヘッド

-

ネットワークホップとコンテキストスイッチング

-

サービスの共同配置最適化の欠如

-

サービス間キャッシング戦略の不在

解決には4〜6か月の最適化作業が必要でした:gRPCプロトコルの採用、サービスアフィニティルール、分散キャッシング、慎重な配置ポリシー。

-

通常開示されない隠れたコスト:*

-

可観測性インフラストラクチャ(分散トレーシング、集中ログ、メトリクス収集)は、15〜25%の運用オーバーヘッドを追加します。

-

サービスメッシュの実装(Istio、Linkerd)は、正しく調整されていない場合、5〜10%のレイテンシ税を導入します。

-

分散システムのデバッグには異なるスキルセットが必要です。既存のチームの再トレーニングには時間とお金がかかります。

-

軽減ワークフロー:*

-

デプロイメント前: スケーリング前にサービスメッシュの可観測性を確立します。分散トレーシング用のOpenTelemetry、集中ログ(ELK、Loki)、メトリクス収集(Prometheus)を実装します。

-

サービス設計: 明確なサービス境界と通信契約を定義します。統合障害を早期に捕捉するために、契約テスト(Pact、Spring Cloud Contract)を使用します。

-

カオスエンジニアリング: 本番インシデントの前に障害モードを表面化するために、毎月カオス実験を実行します。テストシナリオ:サービスレイテンシインジェクション、ポッド退避、ネットワークパーティションシミュレーション。

-

ランブック作成: 一般的な障害シナリオと自動修復手順を文書化します。例:「サービスXのレイテンシが500msを超える場合、自動ポッド再起動をトリガーし、オンコールチームにアラートを送信します。」

参照アーキテクチャ:リスク低減としての標準化

業界のコンセンサスは、3層参照モデルを中心に収束しています:

- クラウドインフラストラクチャ層: Kubernetes、コンテナランタイム、永続ストレージ

- テレコム固有機能層: 5Gコア、RAN、IMS、ポリシーエンジン

- API公開層: 内部および外部コンシューマー向けのREST/gRPCエンドポイント

-

標準化の利点:* CNCF整合参照アーキテクチャ(ONAP、OpenDaylight、Magma)を採用するキャリアは、オーケストレーション、ライフサイクル管理、セキュリティコントロールの再発明を回避します。ガードレール(ポリシーアズコード、ネットワークポリシー、RBAC)は、インシデントを通じて発見されるのではなく、デプロイメント時に実施可能になります。

-

測定された成果:*

-

事前設定されたネットワークポリシーを備えたCNCF Kubernetesディストリビューションを使用しているあるキャリアは、セキュリティ設定エラーを60%削減しました。

-

OpenStack統合パターンを活用している別のキャリアは、コントロールプレーンを標準化しながらマルチクラウドの柔軟性を維持し、ベンダーロックインリスクを低減しました。

-

実装ロードマップ:*

| フェーズ | タイムライン | 成果物 | 工数 |

|---|---|---|---|

| 1. 評価 | 第1〜4週 | 現在のアーキテクチャ監査、参照モデルとのギャップ分析 | 2〜3 FTE |

| 2. パイロット | 第5〜16週 | 非本番環境での参照アーキテクチャのデプロイ、ツールの検証 | 4〜5 FTE |

| 3. 強化 | 第17〜24週 | セキュリティレビュー、ポリシーアズコードの実装、コンプライアンス検証 | 3〜4 FTE |

| 4. 本番展開 | 第25〜52週 | ワークロードの段階的移行、ランブック開発、チームトレーニング | 6〜8 FTE |

-

コスト見積もり:* 50万〜120万ドル(チーム規模と既存のインフラストラクチャ負債に依存)。ROIは通常、運用効率の向上により18〜24か月以内に実現されます。

-

ガードレール実装チェックリスト:*

-

Infrastructure-as-code(Terraform、Helm)が環境全体で一貫性を実施

-

ネットワークポリシーがサービス間通信を文書化されたフローに制限

-

RBACが役割と名前空間によってクラスターリソースへのアクセスを制限

-

ポッドセキュリティポリシーが特権コンテナを防止し、リソース制限を実施

-

アドミッションコントローラーがデプロイメント前にワークロードのコンプライアンスを検証

-

監査ログがすべてのAPIアクセスと設定変更をキャプチャ

運用とデプロイメントパターン:運用規律としてのGitOps

成熟したクラウドネイティブ運用には、リアクティブなインシデント対応からプロアクティブなキャパシティプランニング、自動修復、継続的な最適化への移行が必要です。GitOps—バージョン管理に保存された宣言的なインフラストラクチャとアプリケーション定義—は、この移行を可能にする運用パターンです。

-

中核原則:* Gitがインフラストラクチャとアプリケーション状態の唯一の信頼できる情報源となります。自動調整ループがドリフトを検出して修正します。カナリアデプロイメントとフィーチャーフラグが影響範囲を最小化します。

-

早期採用者からの測定結果:*

-

10倍高速な復旧時間(MTTRが数時間から数分に短縮)

-

日常的な運用における手動介入がほぼゼロ

-

95%以上のデプロイメント成功率(手動プロセスの70~80%と比較)

-

具体的なワークフロー: GitOpsによるネットワーク機能の更新*

開発者がネットワーク機能の設定変更をGitリポジトリにコミット

↓

CI/CDパイプラインがトリガー: 自動テスト、セキュリティスキャン、ポリシー検証

↓

変更が承認され、メインブランチにマージ

↓

GitOpsコントローラー(ArgoCD)がドリフトを検出し、カナリア環境にデプロイ(5%のトラフィック)

↓

自動テストがカナリアを検証: レイテンシ、エラー率、リソース使用率

↓

カナリアが合格した場合: 50%のトラフィックへ自動昇格、その後100%へ

↓

カナリアが失敗した場合: 自動ロールバック、Gitリバート、インシデント調査

↓

デプロイメント完了、Git履歴に不変の監査証跡- 実装要件:*

-

バージョン管理規律: すべてのインフラストラクチャとアプリケーション設定をGitに格納。本番環境での手動kubectlコマンドは禁止。

-

プログレッシブデリバリーツール: カナリアデプロイメント用のFlagger、GitOps調整用のArgoCD。

-

自動テスト: ユニットテスト、統合テスト、スモークテスト、パフォーマンステストをデプロイ前にCI/CDパイプラインで実行。

-

ロールバック自動化: フィーチャーフラグにより再デプロイなしで即座にロールバック可能。Gitリバートがインフラストラクチャのロールバックをトリガー。

-

オブザーバビリティ統合: カナリア昇格の判断はリアルタイムメトリクス(レイテンシ、エラー率、リソース使用率)に基づく。

- ランブックの例: 高レイテンシに対する自動修復*

apiVersion: monitoring.coreos.com/v1

kind: PrometheusRule

metadata:

name: service-latency-remediation

spec:

groups:

- name: service-latency

rules:

- alert: ServiceLatencyHigh

expr: histogram_quantile(0.95, service_latency_ms) > 500

for: 5m

annotations:

runbook: "[https://wiki.example.com/runbooks/high-latency"](https://wiki.example.com/runbooks/high-latency")

action: "trigger-pod-restart"このアラートが発火すると、オペレーターは自動的に:

- 影響を受けたポッドを再起動

- CPU使用率が高い場合はレプリカをスケールアップ

- コンテキスト付きでオンコールチームに通知

- 事後分析のためにインシデントを記録

ネットワークAPI:次のフロンティアと収益機会

通信キャリアは、QoS管理、デバイス位置情報、ネットワークスライシング、エッジコンピューティングなどのネットワーク機能のAPIを標準化し、サードパーティ開発者や社内チームに公開しています。このAPI優先モデルは、クラウドハイパースケーラーの実践を反映し、プログラマブルなネットワークを実現します。

-

ビジネスケース:*

-

早期採用者は新サービスの機能提供が20~30%高速化したと報告

-

IoT、エンタープライズ、エッジサービスにおける新たな収益機会

-

セルフサービス機能による運用オーバーヘッドの削減

-

具体的なユースケース:*

| ユースケース | API機能 | ビジネスインパクト |

|---|---|---|

| エンタープライズネットワークスライシング | プログラマティックなスライスプロビジョニング | 顧客がオンデマンドで専用リソースを要求可能、キャリアは手動プロビジョニングを削減 |

| エッジコンピューティング | ユーザー近傍への機能デプロイ | 開発者が低レイテンシアプリケーションを構築、キャリアはエッジインフラを収益化 |

| デバイス位置情報 | リアルタイム位置データ | エンタープライズ顧客が位置ベースサービスを構築、キャリアは新たな収益源を創出 |

| QoS管理 | プログラマティックな帯域幅割り当て | アプリケーションが動的にトラフィックを優先付け、キャリアはネットワーク使用率を最適化 |

- API戦略とガバナンス:*

-

優先順位付け: まず高価値の機能に焦点を当てる。以下でランク付け:

- 収益ポテンシャル

- 運用効率の向上

- 開発者の需要

- 競争上の差別化

-

標準への準拠: REST APIにはOpenAPI 3.0を使用、高性能な内部APIにはgRPCを使用。業界標準(3GPP、IETF)に準拠。

-

バージョニングと廃止: 明確なバージョニングポリシー(セマンティックバージョニング)を確立。12ヶ月の通知期間で古いAPIバージョンを廃止。

-

開発者体験: 開発者ポータル、SDK(Python、Go、Java)、サンドボックス環境を構築。採用の摩擦を測定。

-

モニタリングとSLO: API可用性、レイテンシ、エラー率のサービスレベル目標(SLO)を定義。例: 99.95%の可用性、p99レイテンシ < 200ms。

- 実装ロードマップ:*

| フェーズ | タイムライン | 成果物 |

|---|---|---|

| 1. APIインベントリ | 第1~2週 | すべてのネットワーク機能を文書化、API公開の優先順位付け |

| 2. 設計 | 第3~6週 | API仕様(OpenAPI)、セキュリティモデル、レート制限ポリシー |

| 3. 実装 | 第7~14週 | APIゲートウェイのセットアップ、認証/認可、モニタリング |

| 4. 開発者オンボーディング | 第15~18週 | ポータルローンチ、SDKリリース、サンドボックス環境 |

| 5. モニタリングと最適化 | 継続的 | 採用状況の追跡、レイテンシの測定、フィードバック収集 |

-

測定フレームワーク:*

-

API呼び出し量と成長率

-

開発者の採用(アクティブな開発者数、アプリケーション数)

-

APIレイテンシ(p50、p95、p99)

-

エラー率とインシデント頻度

-

生成された収益(収益化されている場合)

-

顧客満足度(NPS、サポートチケット)

セキュリティとコンプライアンス:後付けではなくアーキテクチャ上の必須事項

クラウドネイティブの採用は、プロアクティブな管理を必要とするセキュリティ、コンプライアンス、運用リスクをもたらします。分散システムは攻撃対象領域を拡大し、コンテナイメージの脆弱性、シークレット管理、ネットワークポリシーの設定ミスが一般的な障害モードです。

- リスクの状況:*

| リスク | 影響 | 緩和策 |

|---|---|---|

| コンテナイメージの脆弱性 | マルウェア、データ侵害 | CI/CDでの自動スキャン、定期的なパッチ適用 |

| シークレットの露出(APIキー、認証情報) | 不正アクセス | シークレット管理システム(Vault)、ローテーションポリシー |

| ネットワークポリシーの設定ミス | 横方向の移動、データ流出 | Policy-as-code、自動検証 |

| コンプライアンス違反(データレジデンシー、暗号化) | 規制罰金、ライセンス停止 | Compliance-as-code、監査ログ |

| サプライチェーン攻撃(侵害された依存関係) | 広範囲の侵害 | 依存関係スキャン、SBOM生成 |

-

具体的なインシデント例:*

-

あるキャリアは、自動スキャンを通じて本番環境に数千のパッチ未適用コンテナイメージを発見。修復には6週間の協調的なパッチ適用が必要でした。

-

別のキャリアは、分散サービス全体での不適切な暗号化キーローテーションによりコンプライアンス違反に直面。規制罰金:200万ドル以上。

-

セキュリティ実装チェックリスト:*

-

アーキテクチャセキュリティレビュー: 脅威モデリング、攻撃対象領域分析、ゼロトラストアーキテクチャ設計。

-

コンテナイメージセキュリティ:

- CI/CDパイプラインですべてのイメージをスキャン(Trivy、Clair)

- 最小限のベースイメージを使用(distroless、Alpine)

- Cosignでイメージに署名、デプロイ時に署名を検証

- 未署名イメージをブロックするイメージアドミッションコントローラーを実装

-

シークレット管理:

- 外部シークレットシステムを使用(HashiCorp Vault、AWS Secrets Manager)

- シークレットを自動的にローテーション(30~90日のローテーションポリシー)

- すべてのシークレットアクセスを監査

- シークレットをGitにコミットしない

-

ネットワークセキュリティ:

- サービス間通信用のサービスメッシュ相互TLS(mTLS)を実装

- 文書化されたフローへのトラフィックを制限するネットワークポリシーを強制

- トラフィック暗号化と認証にサービスメッシュを使用

- データ流出を防ぐためのエグレス制御を実装

-

コンプライアンスと監査:

- すべてのAPIアクセスと設定変更の不変監査ログを維持

- ポリシーを強制するためのCompliance-as-code(OPA、Kyverno)を実装

- 定期的なペネトレーションテストと脆弱性評価

- データレジデンシーと暗号化要件を文書化、コンプライアンスを検証

-

インシデント対応:

- セキュリティイベント用のインシデント対応プレイブックを確立

- 定期的なテーブルトップ演習を実施

- フォレンジック機能を維持(不変ログ、スナップショット)

- コスト見積もり:* 初期セキュリティ強化に30万

80万ドル(現状に依存)。継続的なメンテナンス:年間10万20万ドル。

移行計画と次のアクション

クラウドネイティブテレコミュニケーションは、日本の主要キャリアにとって運用上の現実です。業界の集団的な焦点は現在、採用から最適化へ、内部機能から顧客向けAPIへ、孤立したデプロイメントから統合されたエコシステムへと移行しています。

- 段階的移行ロードマップ(12~24ヶ月):*

| 四半期 | マイルストーン | 主要活動 |

|---|---|---|

| Q1 | 評価と計画 | 現在のデプロイメントを監査、ベースラインKPIを確立、参照アーキテクチャを定義 |

| Q2 | パイロットと検証 | 参照アーキテクチャをデプロイ、ツールを検証、セキュリティレビューを実施 |

| Q3 | 強化と準備 | GitOpsを実装、オブザーバビリティを確立、ランブックを開発、チームをトレーニング |

| Q4 | 本番ロールアウト(フェーズ1) | 非クリティカルなワークロードを移行、結果を測定、プロセスを改善 |

| Q1(2年目) | 本番ロールアウト(フェーズ2) | クリティカルなワークロードを移行、API戦略を確立、開発者ポータルをローンチ |

| Q2~Q4(2年目) | 最適化と拡張 | APIオファリングをスケール、コストを最適化、競争上の差別化を構築 |

- 即座のアクション項目(次の30日間):*

-

運営委員会の設立: クラウドネイティブ戦略を監督する部門横断チーム(エンジニアリング、運用、セキュリティ、ビジネス)。

-

デプロイメント監査の実施: すべてのクラウドネイティブワークロードをインベントリ化。運用メトリクス(レイテンシ、可用性、コスト、MTTR)を測定。

-

参照アーキテクチャの定義: CNCF準拠モデルを採用、逸脱とビジネス上の正当性を文書化。

-

ツールギャップの評価: オブザーバビリティ、GitOps、プログレッシブデリバリー、セキュリティツールを評価。ギャップを特定。

-

チーム構造の計画: プラットフォームエンジニアリングチームの責任を定義、スキルギャップを特定、トレーニングを計画。

-

ガバナンスの確立: 変更管理プロセス、セキュリティレビュー基準、コンプライアンス要件を定義。

-

成功基準(12ヶ月の期間):*

-

ネットワーク機能の80%以上がクラウドネイティブインフラストラクチャ上で稼働

-

MTTRが50%削減(現在のベースラインから)

-

トランザクションあたりのコストが25~35%削減

-

クラウドネイティブインフラストラクチャに関連する重大なセキュリティインシデントがゼロ

-

100人以上のアクティブな開発者を持つ3つ以上のネットワークAPIが本番稼働

-

95%以上のデプロイメント成功率(失敗時の自動ロールバック)

-

主要リスクと緩和策:*

| リスク | 確率 | 影響 | 緩和策 |

|---|---|---|---|

| チームのスキルギャップ | 高 | 高 | 構造化されたトレーニングプログラム、外部専門家の雇用、段階的な移行 |

システム構造とボトルネック:バグではなく機能としての複雑性

クラウドネイティブテレコミュニケーションアーキテクチャは、コントロールプレーンをデータプレーンから分離し、エッジとコアに機能を分散し、API優先のサービスモデルを導入します。この柔軟性は運用上の複雑性を生み出しますが、その複雑性は前例のない俊敏性の代償です。

-

パラドックス:* マイクロサービスはシステムの表面積を増加させますが、モノリシックアーキテクチャでは達成できない機能を可能にします。

-

なぜこれが重要か:* かつて単一のバイナリとして実行されていたネットワーク機能は、現在、複数のクラスタにまたがる数十のコンテナにまたがっています。レイテンシのデバッグ、障害のトレース、疎結合サービス間の一貫性の確保には、新しい運用規律が必要です。状態管理、分散トランザクション、サービス間通信パターンは摩擦点のままですが、それらは解決可能な摩擦点です。

あるキャリアの5Gパケットゲートウェイは、認証、ポリシー、ルーティングのマイクロサービスに分解され、当初はモノリシックな前身よりも15%高いレイテンシに悩まされました。チームは元に戻すのではなく、最適化しました:サービスのコロケーション、gRPCプロトコル、インテリジェントキャッシング。結果:パフォーマンスの同等性だけでなく、水平方向にスケールし、モノリスでは決してできなかった方法でトラフィックパターンに適応できるシステム。

-

前向きな賭け:* 今日オブザーバビリティとサービスメッシュパターンをマスターする組織は、明日自律的な運用を解き放つでしょう。分散トレーシング(OpenTelemetry)、集中ログ、メトリクス収集は、単なる運用上の必需品ではありません—それらは自己管理ネットワークを可能にする感覚システムです。

-

即座のアクション:*

-

スケーリング前にサービスメッシュのオブザーバビリティを確立、本番環境で障害モードを発見しないこと。

-

分散トレーシングと集中ログを、後付けではなく第一級のインフラストラクチャとして実装。

-

明確なサービス境界と通信契約を早期に定義、これらがネットワークの「神経系」となる。

-

カオスエンジニアリングに投資して障害モードを表面化し、レジリエンスのための組織的な筋肉記憶を構築。

参照アーキテクチャとガードレール:解放としての標準化

業界のコンセンサスは、3層参照モデルに収束しています:クラウドインフラストラクチャ(Kubernetes、コンテナランタイム)、テレコム固有の機能(5Gコア、RAN、IMS)、API公開層。この収束は制限的ではありません—それは解放的です。

-

洞察:* 標準化された参照アーキテクチャは、デプロイメントのばらつきを減らし、価値実現までの時間を加速し、チームが上位層でイノベーションを起こす自由を与えます。

-

なぜこれが重要か:* オープンソースプロジェクト(ONAP、OpenDaylight、Magma)とベンダー中立のフレームワークは、実証済みのテンプレートを提供します。これらのパターンを採用するキャリアは、オーケストレーション、ライフサイクル管理、セキュリティ制御の再発明を避けます。ガードレール—Policy-as-code、ネットワークポリシー、RBAC—は、インシデントを通じて発見されるのではなく、デプロイ時に強制可能になります。

CNCF準拠のKubernetesディストリビューションを事前設定されたネットワークポリシーとアドミッションコントローラーで使用しているキャリアは、手動セットアップと比較してセキュリティ設定エラーを60%削減しました。別のキャリアは、OpenStack統合パターンを活用してマルチクラウドの柔軟性を維持しながらコントロールプレーンを標準化しました。見返り:チームはインフラストラクチャの配管に費やす時間が減り、差別化された機能により多くの時間を費やしました。

-

前向きな賭け:* 参照アーキテクチャは自己修復ブループリントに進化します—インフラストラクチャを定義するだけでなく、最適化ロジック、コンプライアンスルール、運用ベストプラクティスを組み込んだテンプレート。今これらのパターンを確立するキャリアは、数ヶ月ではなく数日で新しいサービスをデプロイできる立場になります。

-

即座のアクション:*

-

CNCF原則とテレコム固有の標準(3GPP、IETF)に準拠した参照アーキテクチャを採用。

-

逸脱とそのビジネス上の正当性を文書化、柔軟性を装った技術的負債を避ける。

-

Infrastructure-as-codeツール(Terraform、Helm)を使用して環境間の一貫性を強制。

-

参照モデルを維持・進化させるプラットフォームエンジニアリングチームを設立、サポート機能ではなく戦略的資産として扱う。

実装と運用パターン:リアクティブから予測的へ

成熟したクラウドネイティブ運用には、リアクティブなインシデント対応からプロアクティブなキャパシティプランニング、自動修復、継続的な最適化への移行が必要です。この移行は段階的ではありません—それは変革的です。

-

洞察:* GitOpsとプログレッシブデリバリーパターンは、デプロイメントリスクを削減し、迅速な反復を可能にしますが、さらに重要なことに、自律的な運用の条件を作り出します。

-

なぜこれが重要か:* バージョン管理に保存された宣言的なインフラストラクチャとアプリケーション定義は、監査可能な信頼できる情報源を作成します。自動調整ループがドリフトを検出して修正します。カナリアデプロイメント、フィーチャーフラグ、自動ロールバックが影響範囲を最小化します。キャリアは10倍高速な復旧時間と日常的な運用における手動介入がほぼゼロであると報告しています。

あるキャリアは、ネットワーク機能更新のためのGitOpsワークフローを実装しました。サービス設定への変更は、自動テスト、トラフィックの5%へのカナリアデプロイメント、成功時の自動昇格をトリガーします。ロールバックは単一のGitリバートです。平均復旧時間は数時間から数分に短縮されました。さらに重要なことは:チームが「火を消す」ことから「火がつかないシステムを設計する」ことへと移行しました。

-

前向きな賭け:* GitOpsワークフローはインテント駆動型運用に進化し、チームが望ましいネットワーク状態を宣言し、自律システムがそれらの状態に向かって継続的に駆動します。これは、需要に適応し、コストを最適化し、人間の介入なしにコンプライアンスを維持する自己管理ネットワークの基盤です。

-

即座のアクション:*

-

インフラストラクチャとアプリケーションのデプロイメントにGitOpsを採用、バージョン管理を信頼できる情報源にする。

-

デプロイメントリスクを最小化するためにプログレッシブデリバリーツール(Flagger、ArgoCD)を実装。

-

一般的な運用タスクのランブックを確立し、オペレーターまたはコントローラーを介して自動化。

-

ログファイル分析ではなくオブザーバビリティ駆動型デバッグについてチームをトレーニング、リアクティブから予測的へ移行。

測定と次のアクション:ネットワークAPIが次のフロンティア

成功指標は、技術的パフォーマンス、ビジネス成果、運用の健全性にまたがる必要があります。しかし、最も重要な指標は、ほとんどのキャリアがまだ測定していないものです:** APIによる価値創造**。

-

洞察:* ネットワークAPIは次のフロンティアであり、新たな収益源、運用効率、競争上の差別化を解き放ちます。

-

これが重要な理由:* キャリアは、ネットワーク機能(QoS管理、デバイス位置情報、ネットワークスライシング、エッジコンピュート)のAPIを標準化し、サードパーティの開発者や社内チームに公開しています。このAPIファーストモデルは、クラウドハイパースケーラーの実践を反映し、プログラマブルなネットワークを作り出します。早期採用者は、機能提供が20~30%高速化し、IoT、エンタープライズ、エッジサービスにおける新たな収益機会を報告しています。

あるキャリアはネットワークスライシングAPIを公開し、エンタープライズ顧客が専用のネットワークリソースをプログラマティックに要求できるようにしました。別のキャリアはエッジコンピュートAPIを公開し、開発者がキャリアの関与なしにユーザーの近くに機能をデプロイできるようにしました。どちらも運用オーバーヘッドを削減し、顧客のロイヤルティを高めました。しかし、より深い機会があります:これらのAPIは、外部のインテリジェンス(AI/MLモデル、サードパーティの最適化アルゴリズム、顧客固有のロジック)がネットワークに流入するインターフェースになります。

-

将来への賭け:* ネットワークAPIはプログラマブルなネットワークプラットフォームへと進化し、キャリアがインフラストラクチャとオーケストレーションを提供し、開発者や企業がその上に差別化されたサービスを構築します。これはハイパースケーラーの戦略を反映しています:AWSはすべてのアプリケーションを構築したわけではなく、プリミティブ(コンピュート、ストレージ、ネットワーキング)を提供し、開発者にイノベーションを起こさせました。このモデルを採用するキャリアは、不釣り合いな価値を獲得するでしょう。

-

即座のアクション:*

-

業界標準(OpenAPI、gRPC)に沿ったネットワークAPI戦略を定義する。

-

高価値な機能(スライシング、QoS、エッジコンピュート、デバイス位置情報)のAPIを優先する。

-

APIガバナンス、バージョニング、非推奨ポリシーを確立する;APIを後付けではなく製品として扱う。

-

採用の摩擦を減らすために開発者ポータルとSDKを構築する。

-

API採用、レイテンシ、顧客満足度、収益への影響を測定する。

-

API消費者とプラットフォームチーム間のフィードバックループを作成し、継続的改善を推進する。

リスクと軽減戦略:後付けではなくアーキテクチャとしてのセキュリティ

クラウドネイティブの採用は、積極的な管理を必要とするセキュリティ、コンプライアンス、運用リスクをもたらします。しかし、リスクはクラウドネイティブに固有のものではありません—分散システムによって増幅され、アーキテクチャ的に対処する必要があります。

-

洞察:* セキュリティとコンプライアンスは、後から追加するのではなく、アーキテクチャに組み込む必要があります。

-

これが重要な理由:* 分散システムは攻撃対象領域を増加させます。コンテナイメージの脆弱性、シークレット管理、ネットワークポリシーの設定ミスは、一般的な障害モードです。規制要件(データレジデンシー、暗号化、監査証跡)は、マルチクラウドおよびエッジデプロイメントを複雑にします。キャリアは、ゼロトラストアーキテクチャ、自動化された脆弱性スキャニング、コンプライアンス・アズ・コードを実装する必要があります。

あるキャリアは、自動スキャンを通じて本番環境に数千のパッチ未適用のコンテナイメージがあることを発見しました。別のキャリアは、分散サービス全体での不適切な暗号化キーローテーションによりコンプライアンス違反に直面しました。どちらもポリシーエンジンと自動修復を実装しました。教訓:セキュリティはチェックリストではなく、すべてのデプロイメントに組み込まれた継続的なプロセスです。

-

将来への賭け:* セキュリティは自律的コンプライアンスへと進化し、ポリシーエンジンがシステムを継続的に監視し、違反を検出し、人間の介入なしに修復します。この能力を今構築するキャリアは、大規模に安全に運用し、進化する規制要件に適応できる立場になります。

-

即座のアクション:*

-

デプロイメント前にアーキテクチャセキュリティレビューを実施する;テストだけでなく設計にセキュリティチームを関与させる。

-

CI/CDパイプラインにコンテナイメージスキャンを実装する;脆弱性検出を自動的かつブロッキングにする。

-

自動ローテーション機能を持つシークレット管理システム(Vault、AWS Secrets Manager)を使用する。

-

ネットワークポリシーとサービスメッシュ相互TLSを強制する;ゼロトラストを前提とする。

-

すべてのAPIアクセスを監査し、不変のログを維持する;すべてのネットワーク操作の監査可能な証跡を作成する。

-

定期的なペネトレーションテストと脅威モデリング演習を実施する;セキュリティを一度限りのイベントではなく、継続的な実践として扱う。

結論と移行計画:次の地平線

クラウドネイティブテレコミュニケーションは、もはや新興の実践ではありません—それは日本の主要キャリアにとって運用の現実です。業界の集団的焦点は今、採用から最適化へ、内部機能から顧客向けAPIへ、孤立したデプロイメントから統合されたエコシステムへとシフトしています。

しかし、これは旅の終わりではありません—次の章の始まりです。

-

3つのホライゾン戦略:*

-

ホライゾン1(現在~12ヶ月):* パイロットを超えてクラウドネイティブの展開を加速する。リファレンスアーキテクチャを確立し、GitOpsワークフローを実装し、オブザーバビリティを組み込む。運用メトリクスを測定し、ベースラインを確立する。これは必須条件です。

-

ホライゾン2(12~24ヶ月):* ネットワーク機能をAPIとして公開する。開発者プラットフォームとSDKを構築する。API消費者とプラットフォームチーム間のフィードバックループを作成する。プログラマブルなネットワークサービスを通じて新たな収益源を立ち上げる。ここで競争上の差別化が現れます。

-

ホライゾン3(24ヶ月以上):* 自律的ネットワークへと進化する。インテント駆動型運用、自律的コンプライアンス、自己最適化システムを実装する。このホライゾンに到達するキャリアは、需要に適応し、コストを最適化し、人間の介入なしにコンプライアンスを維持するネットワークを運用します。

-

重要なポイント:*

-

クラウドネイティブは本番環境対応;問題は「もし」ではなく「どれだけ速く」です。

-

リファレンスアーキテクチャとオープンスタンダードは、デプロイメントのばらつきとリスクを削減します;標準化がイノベーションを可能にします。

-

GitOpsとプログレッシブデリバリーは単なる運用実践ではありません—自律的システムの基盤です。

-

ネットワークAPIは、新しいビジネスモデル、運用効率、競争優位性を解き放ちます。

-

セキュリティとコンプライアンスは、すべてのレイヤーに組み込まれたアーキテクチャ上の懸念事項でなければなりません。

-

断固として行動するキャリアは、テレコム進化の次の段階で不釣り合いな競争優位性を獲得します。

-

即座のアクション(次の90日間):*

- 現在のクラウドネイティブデプロイメントを監査する;運用メトリクス(レイテンシ、可用性、コスト、デプロイメント頻度)をベースラインと比較して測定する。

- CNCFの原則とテレコム標準に沿ったリファレンスアーキテクチャを採用する;逸脱とそのビジネス上の正当性を文書化する。

- GitOpsワークフローとプログレッシブデリバリーツールを実装する;一般的な運用タスクのランブックと自動化を確立する。

- ネットワークAPI戦略を定義する;高価値な機能を優先し、ガバナンスポリシーを確立する。

- アーキテクチャとポリシー・アズ・コードにセキュリティとコンプライアンス制御を組み込む;セキュリティアーキテクチャレビューを実施する。

- クラウドネイティブ基盤を維持し進化させるプラットフォームエンジニアリングチームを確立する;戦略的資産として扱う。

- 業界フォーラム(CNTOM、CNCF、3GPP)に参加して学びを共有し、標準に合わせ、集団的進歩を加速する。

- 機会:* クラウドネイティブ原則を中心としたキャリア戦略の収束は、ベンダー、インテグレーター、開発者が価値実現までの時間を加速する標準化されたソリューションを構築する前例のない機会を生み出します。リファレンスアーキテクチャ、運用規律、APIファースト思考、自律的システム設計を組み合わせる組織は、単に競争するだけでなく、テレコミュニケーションの次の時代をリードします。

未来はキャリアに起こるものではありません。それは彼らが今から一緒に構築するものです。

- 図2:日本通信キャリアのクラウドネイティブ導入進展(2020-2025年)*

- 図3:クラウドネイティブ導入による運用効果の改善(データ未提供)*

- 図1:日本の通信キャリアにおけるクラウドネイティブ本番運用の現状。ドコモ、KDDI、ソフトバンク、楽天がコンテナ化されたネットワーク機能、Kubernetes、マイクロサービスを実運用で稼働させている。(出典:CNTOM 2025、各キャリア公開情報)*

- 図9:GitOpsによる通信ネットワーク運用の自動化フロー(GitOps標準実装、業界ベストプラクティス)*

- 図10:段階的デリバリーによるリスク低減デプロイメント戦略(カナリア・ブルーグリーン・フィーチャーフラグ)*

- 図12:ネットワークAPIの主要な活用シナリオと利用者層(出典:3GPP標準、GSMA Intelligence)*

- 図11:ネットワークAPIが開く新たなビジネス機会と生態系*

- 図13:セキュリティ・バイ・デザイン:アーキテクチャ段階での統合。ゼロトラストセキュリティ、マイクロセグメンテーション、暗号化、監査ログがネットワークの各層に組み込まれ、設計段階からセキュリティとコンプライアンスが統合される重要性を表現。(出典:NIST Cybersecurity Framework、業界セキュリティガイドライン)*