AWS Lightsail の AI インフラストラクチャへの戦略的進出

Amazon Web Services による OpenClaw の Amazon Lightsail 上のプリコンフィギュアされたインスタンスイメージとしての導入は、アクセス可能な AI インフラストラクチャプロビジョニングへの意図的な拡張を示しています。このオファリングは、インフラストラクチャ構成のオーバーヘッドを最小限に抑えた AI 機能を必要とする開発者および中堅企業という明確な市場セグメントを対象としており、専門プロバイダーが対応する資本集約的な GPU クラスタ市場ではありません。

- 前提条件*: 本分析は、OpenClaw がリソース制約環境に最適化されたコンテナ化またはプリインストール型の AI フレームワークバンドルであることを想定しています。OpenClaw の正確な構成、依存関係、パフォーマンス特性を指定する公式 AWS ドキュメントがない場合、その機能に関する主張はベンダー仕様レビューの保留中のままです。

Amazon Lightsail は AWS の簡略化された仮想プライベートサーバ(VPS)オファリングとして機能し、歴史的には Web ホスティングと開発環境に対応してきました。OpenClaw をワンクリックでデプロイ可能なインスタンスイメージとして統合することで、Lightsail のスコープを AI ツーリングに拡張しながら、その運用シンプリシティの哲学を保持しています。このアプローチは、AI インフラストラクチャデプロイメントにおける文書化された摩擦点に対応しています。ハードウェア調達サイクル、ソフトウェア依存関係の解決、環境構成の複雑性です。

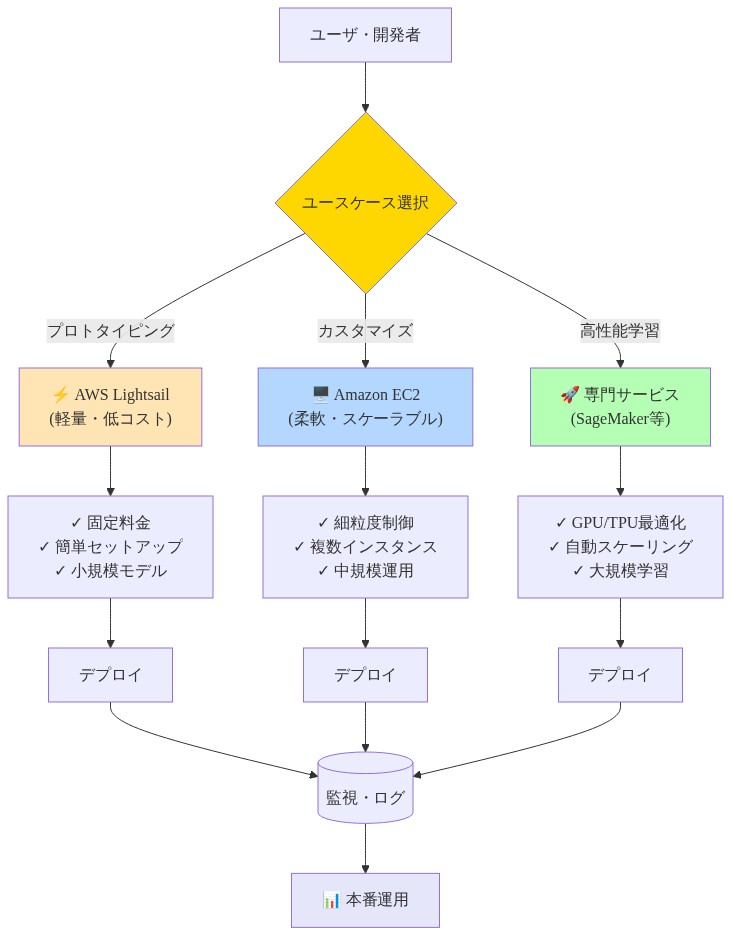

戦略的ポジショニングは、AI ワークロードの多様性が均一なインフラストラクチャ要件を排除することを AWS が認識していることを反映しています。これにより、段階的なデプロイメントアーキテクチャが生成されます。迅速なプロトタイピングと軽量推論用の Lightsail、カスタマイズされた構成用の EC2、高性能トレーニングワークロード用の専門サービスです。実務家にとって、これは開発およびプルーフオブコンセプトフェーズでのデプロイメント時間を数日から数分に短縮することを意味します。

OpenClaw のアーキテクチャと VPS 最適化

プリコンフィギュアされたインスタンスイメージは、バンドルされたソフトウェアバージョン、事前解決された依存関係、VPS 制約に最適化されたリソース割り当てを通じて、文書化されたデプロイメント課題に対応しています。AWS のアプローチは、一般的な障害モードを排除しています。ライブラリバージョンの競合、推移的な依存関係の非互換性、開発システムと本番システム間の環境構成ドリフトです。

- 重要な前提条件*: プリコンフィギュレーションの有効性は、OpenClaw のスコープが Lightsail のリソースプロファイル内に適合するのに十分に制約されていることに依存しています。最小コンピュート要件、メモリフットプリント、ストレージ消費に関する公開仕様がない場合、パフォーマンス主張は未検証のままです。

インスタンスイメージ方法論は、すべてのデプロイメント全体で固定ベースライン構成を確立することにより、再現性を向上させます。これにより、開発、ステージング、テスト環境の分散が削減されます。これは AI モデル評価とデプロイメントの信頼性のための文書化された要件です。チームはインフラストラクチャトラブルシューティングを開発ボトルネックとして排除し、モデル開発と実験に努力をリダイレクトします。

ハードウェア中心のインフラストラクチャに対する競争上のポジショニング

AWS の Lightsail-OpenClaw オファリングは、専門 GPU インフラストラクチャプロバイダーとは異なる市場セグメントに対応しています。GPU アクセラレーテッドコンピューティングは大規模モデルトレーニングに不可欠なままですが、開発ワークフロー、プロトタイピング、軽量推論は汎用コンピュートリソースで効果的に動作することが多いです。

- 必要なデータポイント*: AI ワークロード分布の定量分析、特に開発、プロトタイピング、推論ワークロード対トレーニングワークロードの割合は、市場セグメンテーションに関する主張を実証するでしょう。この分布に関する現在の業界データは限定的なままです。

このポジショニングは市場の二分化を生成します。専門ハードウェアを要求する計算集約的なトレーニング対汎用インフラストラクチャで十分な開発および推論フェーズです。プリコンフィギュアされたアプローチは、多様なハードウェア基盤全体で複数のフレームワークをサポートすることにより、ベンダーロックインを削減し、フレームワーク固有の最適化を必要とする専門 GPU エコシステムと対比しています。

ハードウェア調達サイクルなしで即座にデプロイメントを提供する AWS の能力は、専門インフラストラクチャ投資にコミットする前に AI 実現可能性評価を実施する組織にとって時間対価値の利点を提供します。これは AI ワークロード多様性が増加し、組織が均一な計算需要を想定するのではなく、特定のユースケース要件に一致するインフラストラクチャを必要とする場合に戦略的に関連性があります。

価格設定アーキテクチャと経済的含意

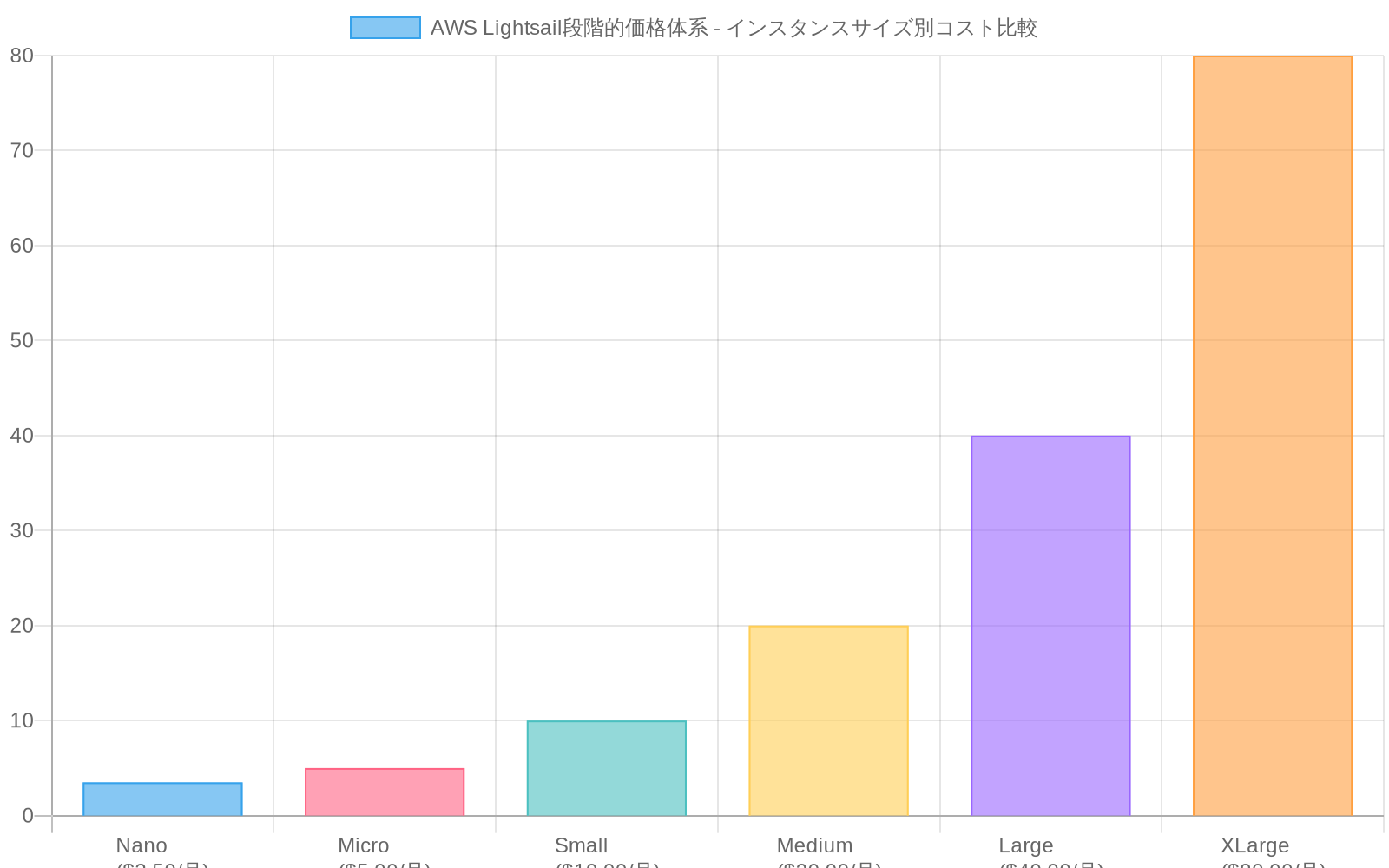

Lightsail は、EC2 の粒度の細かい使用量ベースの課金モデルと対比して、バンドルされたコンピュート、ストレージ、データ転送割り当てを備えた固定月額料金を採用しています。この価格設定構造は、専任の DevOps リソースを欠き、予測可能なコスト構造を必要とする組織にアピールしています。

- 経済分析スコープ*: 総所有コストは直接コンピュート費用を超えて、構成労力、保守オーバーヘッド、専門知識要件を含みます。リソース制約のある組織の場合、プリコンフィギュアされたインスタンスは、インフラストラクチャ管理労力を考慮する場合、潜在的により高い単位コンピュートコストにもかかわらず、優れた経済効率を実証する可能性があります。

予測可能な月額請求は財務計画を簡素化し、予算精度を向上させます。これは特にスタートアップおよび IT 予算が制約されている組織にとって価値があります。これは予期しないリソース消費からのコスト驚きが予算の不確実性を生成する使用量ベースの価格設定モデルと対比しています。

AI 開発ワークフローへの含意

プリコンフィギュアされたインスタンスは、インフラストラクチャプロビジョニングのオーバーヘッドを大幅に削減し、コンセプトから動作するプロトタイプへの開発サイクルを加速させます。この運用効率は、実験文化を根本的に変えます。インフラストラクチャプロビジョニングが些細になると、新しいアプローチをテストするための組織的障壁が減少し、開発速度が潜在的に増加します。

- ガバナンス考慮事項*: デプロイメントの容易さは、リソース拡散、コスト管理、セキュリティポリシー実行に関する運用上の課題をもたらします。組織は、簡略化されたデプロイメントを価値あるものにする俊敏性を保持しながら、制御されていないインスタンス増殖を防ぐ管理統制を実装する必要があります。

市場の断片化と戦略的含意

AWS のオファリングは、AI インフラストラクチャの専門段階への階層化を加速させます。フロンティアモデルトレーニング用のハイパースケール GPU クラスタ、中堅層の専用推論インフラストラクチャ、開発およびプロトタイピング用の軽量 VPS ベースのデプロイメントです。

この市場の断片化は、単一のインフラストラクチャ仮定に異議を唱えます。競争力学は段階全体で大幅に異なります。Lightsail-OpenClaw は AWS を初期 AI 探索フェーズ中に初期顧客関係を確立し、ワークロード要件が進化および成熟するにつれて潜在的なサービス移行経路を生成する位置に置きます。

競合他社は戦略的対応を評価する必要があります。簡略化されたデプロイメントモデルの照合、パフォーマンス利点による差別化、または特定のフレームワークサポートまたはハードウェアアクセスの特化です。市場はますます、多様なユースケース全体で均一なソリューションを想定するのではなく、ワークロード成熟度に一致するインフラストラクチャを要求しています。

主要なポイントと次のアクション

AWS の Lightsail-OpenClaw オファリングは、AI 開発ワークロードのインフラストラクチャプロビジョニング複雑性を削減します。組織は、迅速なデプロイメントと予測可能なコストが専門ハードウェア要件を上回るプロトタイピング、開発、軽量推論シナリオについてこのオプションを評価する必要があります。

実務家は、プリコンフィギュアされたインスタンスを使用して特定のワークロードのベースラインパフォーマンスとコストプロファイルを確立する必要があります。この経験的データは、要件がより高い段階のサービスに進化するにつれてスケーリング決定を通知します。同時に、組織は、運用俊敏性を維持しながらリソース拡散を防ぐガバナンスフレームワークを実装する必要があります。

戦略的含意は明確です。AI インフラストラクチャはワークロード成熟度とパフォーマンス要件によって階層化されています。最適な結果には、多様なワークロードを均一なインフラストラクチャに強制するのではなく、特定のユースケースにデプロイメントアプローチを一致させることが必要です。

主要なポイントと実行ロードマップ

-

Lightsail-OpenClaw を使用する場合:*

-

4 週間未満のタイムラインでの開発およびプロトタイピング

-

秒あたり 100 リクエスト未満のスループットを持つ推論ワークロード

-

専任の DevOps リソースを持たないチーム

-

予測可能なコストを必要とする IT 予算が制約されたプロジェクト

-

迅速な反復サイクルを必要とする実験

-

回避する場合:*

-

GPU アクセラレーションを必要とするモデルトレーニング

-

秒あたり 1000 リクエスト以上のスループットを持つ本番ワークロード

-

カスタムフレームワークバージョンまたは最先端機能を必要とするアプリケーション

-

100 ミリ秒未満のレイテンシを要求するワークロード

-

ダウンタイムなしでインスタンスサイズ変更を必要とする組織

-

30 日間の実装ロードマップ:*

-

第 1 週: 評価*

-

非本番環境で単一の OpenClaw インスタンスを起動

-

推論レイテンシ、スループット、リソース使用率をワークロード要件に対してベンチマーク

-

フレームワークバージョンと依存関係の互換性を文書化

-

予想されるインスタンス数の月額コストを推定

-

第 2 週: ガバナンス*

-

インスタンスライフサイクルポリシーと自動シャットダウンルールを定義

-

コスト配分とチャージバック機構を確立

-

本番デプロイメント用の承認ワークフローを作成

-

コスト異常のための監視とアラートを構成

-

第 3 週: パイロット*

-

チーム実験用に 3~5 個の開発インスタンスをデプロイ

-

コスト、パフォーマンス、リソース使用率を監視

-

デプロイメント経験と運用オーバーヘッドに関するフィードバックを収集

-

プリコンフィギュアされたベースラインとワークロード要件間のギャップを特定

-

第 4 週: スケールまたは移行*

-

成功した実験: 本番インフラストラクチャ(EC2/SageMaker)に移行し、文書化された移行手順を使用

-

失敗した実験: インスタンスを廃止し、学習した教訓をキャプチャ

-

パイロット経験に基づいてガバナンスポリシーを改善

-

次の 6~12 か月のインフラストラクチャ戦略を計画

-

リスク軽減:*

-

プリコンフィギュアされたインスタンスを超えて成長するワークロード用に、Lightsail から EC2 への文書化された移行手順を維持

-

自動バックアップとディザスタリカバリ手順を実装

-

すべてのインスタンスのセキュリティベースラインとコンプライアンススキャンを確立

-

Lightsail イメージとアップストリームリリース間のフレームワークバージョンドリフトを監視

-

成功指標:*

-

実験までの時間: コンセプトから動作するプロトタイプまで 1 日未満

-

コスト予測可能性: 実際の月額コストが予測の ±10% 以内

-

リソース使用率: 平均 CPU/メモリ使用率 40% 以上(適切なサイジングを示す)

-

ガバナンスコンプライアンス: 100% のインスタンスがタグ付けおよび追跡; ゼロの予算外インスタンス

AWS の Lightsail-OpenClaw オファリングは、パフォーマンス最適化よりもデプロイメント速度とコスト予測可能性を優先する組織に真の価値を提供します。成功には、このインフラストラクチャを適切なワークロードに一致させ、簡略化されたデプロイメントを価値あるものにする俊敏性を維持しながらコスト拡散を防ぐガバナンスフレームワークを実装することが必要です。

- 図2:AWSのティアード展開アーキテクチャ - Lightsail、EC2、専門サービスの役割分担とユースケース別選択フロー*

OpenClawのアーキテクチャ:見えないインフラストラクチャが競争優位性になる仕組み

事前設定されたインスタンスイメージは、インフラストラクチャの抽象化に対する新しいアプローチを示しています。実務者が依存関係を調整し、バージョン互換性を管理し、環境の不一致をトラブルシューティングする必要がある代わりに、AWSはこれらの判断をイメージ自体に組み込んでしまいました。

このアプローチは複数の隣接する機会を開きます。

-

スケール時の再現性*:すべてのインスタンスは同じベースラインから起動します。これにより、組織全体で無数の時間を消費する「自分のマシンでは動く」という問題が排除されます。AI実験が加速する将来において、再現性は競争優位性になります。環境全体で確実に結果を複製できるチームは、より速く反復できるのです。

-

標準化を通じたガバナンス*:事前設定されたイメージは、セキュリティポリシー、コンプライアンス要件、組織標準を強制するための自然な接点を作ります。個別の設定を監査する代わりに、組織はイメージを一度認証し、自信を持ってデプロイできます。これは、インフラストラクチャガバナンスが見えなくなる将来を示唆しています。外部コントロールを通じて強制されるのではなく、デプロイメントモデルに組み込まれるのです。

-

インフラストラクチャとしての速度*:プロビジョニングが数日から数分に短縮されると、AI開発作業の性質が変わります。チームはインフラストラクチャ管理からモデル実験へシフトします。この速度優位性は複合的に作用します。10倍多くのアプローチをテストできる組織は、より速くより良いソリューションを発見します。時間とともに、これは早期採用者に対する競争上の堀を作ります。

競争ポジショニング:AI インフラストラクチャ市場の二層化

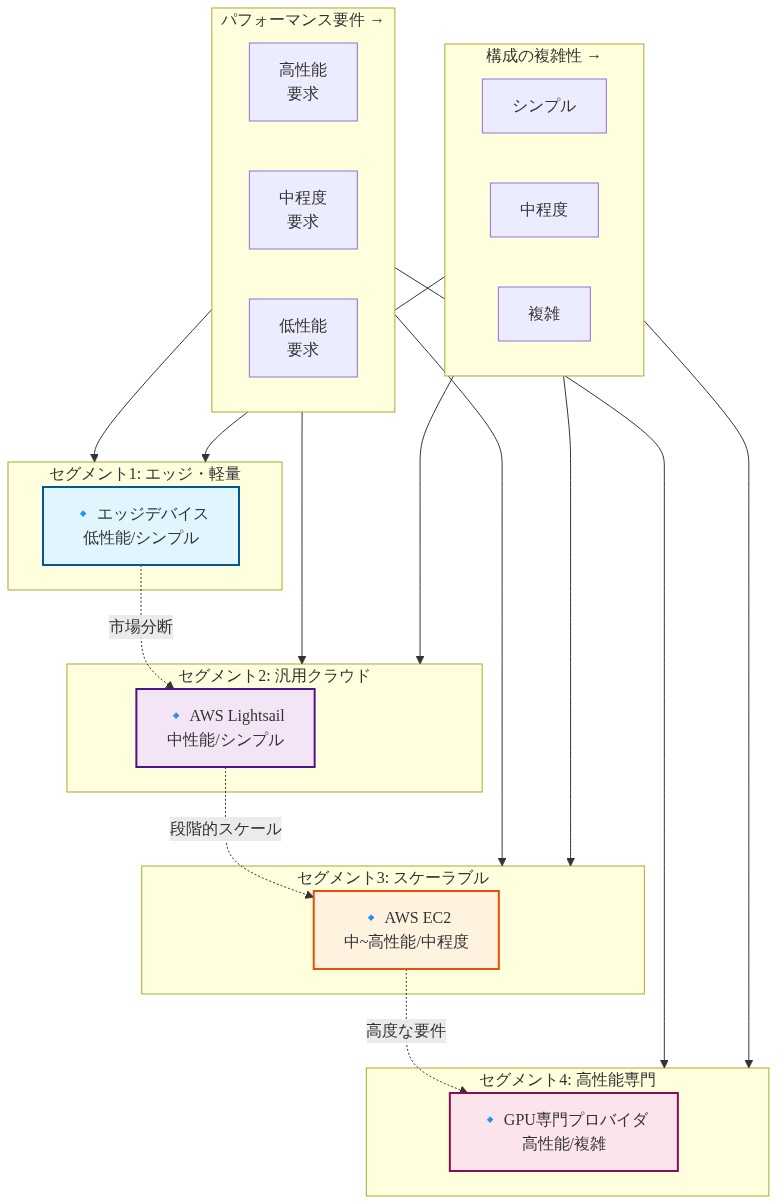

Nvidiaの記録的な収益がGPUアクセラレーテッドコンピューティングへの需要を反映していますが、これは新興の市場構造を隠しています。AI インフラストラクチャ市場は単一のアプローチの周りに統合されていません。根本的に異なるユースケースに対応する異なる層に階層化されています。

-

第1層:フロンティア学習インフラストラクチャ*(専門的なGPUクラスタ、カスタムシリコン)

-

対象:大規模モデル学習、最先端研究

-

経済性:資本集約的、専門的な専門知識が必要

-

競争力学:ハードウェア性能、スケール、FLOP当たりのコスト

-

第2層:本番推論インフラストラクチャ*(専用推論クラスタ、エッジデプロイメント)

-

対象:高スループット、レイテンシに敏感な推論ワークロード

-

経済性:資本コストと運用コストのバランス

-

競争力学:スループット、レイテンシ、推論当たりのコスト

-

第3層:開発と実験インフラストラクチャ*(簡素化されたVPS、事前設定イメージ)

-

対象:プロトタイピング、モデル開発、軽量推論

-

経済性:予測可能、低い資本要件

-

競争力学:価値実現までの時間、使いやすさ、コスト予測可能性

AWSのLightsail-OpenClawオファリングは、大胆な仮定によって第3層を支配しています。ほとんどの組織は第1層インフラストラクチャを必要としないという仮定です。この仮定は正しい可能性が高いです。その含意は深刻です。AI インフラストラクチャの将来は、より大きく、より強力なシステムを構築することではなく、AI ワークロードの実際の分布に一致するインフラストラクチャを作成することについてであることを示唆しています。

このポジショニングはまた、CUDAロックインに異議を唱えます。簡素化されたデプロイメントモデル内で多様なハードウェア基盤全体にわたるフレームワークをサポートすることにより、AWSは専門的なハードウェア依存関係なしにAI機能を求める組織のための代替パスを作成します。AI ワークロードの多様性が増すにつれて、この柔軟性はますます価値が高まります。

価格設定アーキテクチャ:インフラストラクチャ経済学の再構成

Lightsailの固定月額料金モデルは、複雑さへの意図的な拒否を表しています。継続的な最適化とコスト監視を必要とする細粒度の使用量ベースの課金ではなく、Lightsailは予測可能性を提供します。

これは経済計算全体を再構成します。

-

従来のEC2経済学*:単位計算コストは低いですが、最適化、監視、管理に専門知識が必要です。総所有コストには隠れたコストが含まれます。エンジニアリング時間、運用オーバーヘッド、コスト最適化の取り組みです。

-

Lightsail経済学*:単位計算コストは高いですが、組み込みの最適化、簡素化された管理、予測可能な予算が含まれます。総所有コストは、多くの場合、専用インフラストラクチャチームを持たない組織ではLightsailに有利です。

知識労働者と中小組織にとって、これは根本的なシフトを表しています。インフラストラクチャコストは固定の行項目になり、継続的な注意が必要な変数ではなくなります。これにより、組織はインフラストラクチャ最適化ではなくAIモデル開発にリソースを集中できます。この再配分は、おそらくより多くの価値を生み出します。

価格設定モデルはまた、インフラストラクチャが透明で予測可能なコストを備えたコモディティサービスになる将来を示唆しています。このコモディティ化は、インフラストラクチャ決定から財務的不確実性を取り除くことにより、AI採用を加速させます。

AI開発ワークフローへの影響:イノベーションサイクルの加速

インフラストラクチャプロビジョニングが些細になると、AI開発作業の性質が変わります。典型的なAI開発ワークフローを考えてみてください。

- 現在の状態*(事前設定イメージなし):

- ユースケースを特定する(1日)

- インフラストラクチャをプロビジョニングする(3~5日)

- 環境を設定する(2~3日)

- モデルを開発およびテストする(10~20日)

- 本番環境にデプロイする(2~5日)

- 将来の状態*(事前設定イメージあり):

- ユースケースを特定する(1日)

- 事前設定されたインスタンスをデプロイする(15分)

- モデルを開発およびテストする(10~20日)

- 本番環境にデプロイする(1~2日)

インフラストラクチャプロビジョニングと設定で節約された時間(約5~8日)は、価値実現までの時間を25~40%加速させます。複数のAIプロジェクトを実行している組織全体では、これは重大な競争優位性に複合します。

さらに重要なのは、この加速が組織の行動を変えることです。実験が摩擦なくなると、チームはより多くのアプローチをテストし、より多くの仮説を探索し、より良いソリューションを発見します。これは、AI開発速度が主要な競争差別化要因になる将来を示唆しています。

しかし、この速度はガバナンスの課題をもたらします。組織は、リソースの拡散、コスト超過、セキュリティ違反を防ぐ一方で、簡素化されたデプロイメントを価値あるものにする俊敏性を維持するガードレールを実装する必要があります。この問題を解決する組織(摩擦なしに構造を作成する)は、AI インフラストラクチャの民主化から不均衡な価値を獲得します。

市場の断片化と戦略的含意:万能インフラストラクチャの終わり

AWSの動きは、従来のインフラストラクチャの仮定に異議を唱える、より広い市場の断片化を加速させます。一枚岩のAI インフラストラクチャ市場という概念は崩壊し、異なるユースケースに対応する専門的な層に置き換わります。

この断片化はいくつかの戦略的含意を作成します。

-

競争力学が分岐する*:各層は異なる競争圧力の下で動作します。第1層(フロンティア学習)は性能とスケールで競争します。第2層(本番推論)はスループットとレイテンシで競争します。第3層(開発)は使いやすさと価値実現までの時間で競争します。競合他社は同じ戦略で全層に勝つことはできません。

-

ロックイン機構がシフトする*:従来のインフラストラクチャロックインは、専門的なハードウェアと独自のソフトウェアスタックを通じて機能しました。将来のロックインはワークフロー統合とエコシステム効果を通じて機能します。開発ワークフローに早期に組み込まれた組織は、ワークロードが成熟し、より高い層のサービスに移行するにつれて顧客を獲得します。

-

新興の機会*:市場の断片化は、専門的な競合他社のための空白を作成します。組織は、優れた第2層推論インフラストラクチャ、特定のドメイン向けの専門的な第1層学習プラットフォーム、または新興のユースケース向けの革新的な第3層ソリューションを構築する可能性があります。一枚岩のインフラストラクチャプロバイダーの利点は減少します。

-

開発者体験が差別化要因になる*:インフラストラクチャがコモディティ化するにつれて、開発者体験が主要な競争差別化要因として浮上します。簡素化されたデプロイメント、明確な価格設定、統合されたツーリングを通じてAI開発を摩擦なくする組織は、不均衡な市場シェアを獲得します。

隣接する機会とイノベーション空間

Lightsail-OpenClawアプローチは、いくつかの隣接する機会を開きます。

-

専門的な事前設定イメージ*:OpenClawを超えて、AWSは特定のドメイン向けの事前設定イメージを提供できます。ヘルスケアAI、金融サービス、製造業です。各イメージは、ドメイン固有のフレームワーク、コンプライアンス要件、ベストプラクティスをバンドルします。これは、専門的なインフラストラクチャソリューションのマーケットプレイスを作成します。

-

インテリジェントなオートスケーリング*:事前設定されたイメージは、ワークロードパターンに基づくインテリジェントなオートスケーリングを可能にします。手動設定を必要とする代わりに、インスタンスは検出されたユーザーパターンに基づいて自動的にスケーリングでき、パフォーマンスを維持しながらコストを最適化します。

-

統合された可観測性とガバナンス*:事前設定されたイメージは、可観測性、コスト監視、ガバナンスコントロールをデプロイメントモデルに直接組み込むことができます。組織は、追加のツーリングなしにリソース使用、コストドライバー、コンプライアンスステータスの可視性を得ます。

-

コミュニティ主導のイメージマーケットプレイス*:AWSはコミュニティメンバーが事前設定されたイメージを作成および共有できるようにし、専門的なソリューションのエコシステムを作成できます。これはLightsailを汎用VPSオファリングからAI インフラストラクチャイノベーションのプラットフォームに変換します。

-

段階的なワークロード移行*:インテリジェントなツーリングは、ワークロードがLightsailを超えて成長するタイミングを検出し、より高い層のサービスへの移行を推奨できます。これにより、自然なアップグレードパスが作成され、顧客生涯価値が最大化され、ワークロードが適切なインフラストラクチャで実行されることが保証されます。

長期的なビジョン:見えないイネーブラーとしてのインフラストラクチャ

Lightsail-OpenClawの究極の含意は、製品ポジショニングを超えています。インフラストラクチャが見えなくなる将来を示唆しています。実務者がインフラストラクチャの制約を考慮することなく、完全にAIモデル開発に焦点を当てる将来です。

このビジョンには、いくつかの開発が必要です。

-

共通パターンの周りの標準化*:AIワークロードが成熟するにつれて、共通パターンが浮上します。事前設定されたイメージは、これらのパターンの周りで標準化でき、実務者が深いインフラストラクチャ知識なしにデプロイできるようにします。

-

インテリジェントなリソース割り当て*:将来のインフラストラクチャは、ワークロード特性に基づいてリソースを自動的に割り当て、手動プロビジョニング決定を排除できます。実務者がワークロードを説明します。インフラストラクチャが自己設定されます。

-

シームレスなワークロード移行*:ワークロードが進化するにつれて、インフラストラクチャは実務者の介入なしに適切な層に自動的に移行できます。開発ワークロードは透過的に本番インフラストラクチャに卒業します。

-

組み込まれたガバナンスとコンプライアンス*:インフラストラクチャは、組織のポリシー、コンプライアンス要件、セキュリティコントロールをデプロイメントモデルに直接組み込むことができます。ガバナンスは見えなくなります。外部コントロールではなく、インフラストラクチャ設計を通じて強制されます。

このビジョンは、組織がAI インフラストラクチャにアプローチする方法の根本的なシフトを表しています。専門的な専門知識が必要な制約としてのインフラストラクチャではなく、インフラストラクチャはイネーブラーになります。透明で、予測可能で、組織のニーズに合わせられています。

主要な要点と戦略的命令

-

組織向け*:プロトタイピング、開発、軽量推論ワークロード向けのLightsail-OpenClawを評価します。特定のユースケースのベースラインパフォーマンスとコストプロファイルを確立します。リソース拡散を防ぎながら俊敏性を維持するガバナンスフレームワークを実装します。インフラストラクチャの階層化が加速していることを認識します。均一なソリューションを強制するのではなく、デプロイメントアプローチをワークロード成熟度に一致させます。

-

実務者向け*:事前設定されたインスタンスを試して、簡素化されたデプロイメントが開発サイクルをどのように加速させるかを理解します。インフラストラクチャの複雑さが現在イノベーションを制約している機会を特定します。摩擦なしに実験を可能にするガバナンスモデルを提唱します。

-

競合他社向け*:インフラストラクチャ市場が専門的な層に断片化されていることを認識します。差別化には、汎用機能で競争するのではなく、特定のユースケースにインフラストラクチャを一致させることが必要です。専門的なパフォーマンス、ユニークなフレームワークサポート、または優れた開発者体験に競争優位性があるかどうかを検討します。

-

より広い市場向け*:AI インフラストラクチャの民主化が加速しています。インフラストラクチャをAI イノベーションへの障壁として取り除く組織は、より速くより良いソリューションを発見し、競争優位性を作成します。将来は、AI開発を摩擦なくする組織に属しています。インフラストラクチャ決定が見えなくなり、実務者がモデル開発に完全に焦点を当てる組織です。

戦略的含意は明確です。AI インフラストラクチャは、深い専門知識が必要な専門的なドメインから、特定のユースケースに最適化されたコモディティサービスへと移行しています。成功には、一枚岩のインフラストラクチャアプローチに関する仮定を放棄し、専門化を受け入れることが必要です。このシフトを最も早く認識し、ワークロード多様性に合わせたインフラストラクチャ戦略を構築する組織は、AIの継続的な拡大から不均衡な価値を獲得します。

- 図4:AWS Lightsail段階的価格体系 - インスタンスサイズ別月額・年間コスト比較(出典:AWS Lightsail公式料金ドキュメント)*

- 図5:段階的スケーリングにおけるコスト最適化フロー(Cloud Economics and Pricing Architecture Patterns)*

- 図8:AI インフラ市場の分断化 - プレイヤーのポジショニングマトリックス*