今日はエンタープライズAI導入の転換点を迎える

エンタープライズAIは、3つの実現条件の収束によって特徴づけられる重要な岐路に達している。第一に、基盤となる大規模言語モデルとドメイン固有モデルが十分な安定性と予測可能性を達成し、組織がその上に再現可能なシステムを構築できるようになった。これは、以前のモデルの動作と出力品質における変動性からの脱却である。第二に、コンピューティングインフラストラクチャのコストが大幅に低下した。クラウドベースのGPUと専用AIハードウェアの価格は過去18ヶ月で約30〜40%低下し、より広範なユースケースにおいて大規模展開が経済的に正当化できるようになった。第三に、競争圧力が強まっている。AI駆動の自動化を運用化した組織は、測定可能な効率向上と市場シェアの獲得を実証しており、遅れている競合他社に緊急性を生み出している。

この転換点は単なる技術的なものではなく、運用的なものである。重要な変化は、探索的能力評価(「AIシステムを構築できるか?」)から体系的な運用化(「エンタープライズ全体でAIシステムをどのように展開し、統治し、維持するか?」)への移行である。この移行には、アーキテクチャの再考が必要となる。具体的には、データがシステムを通じてどのように流れるか、モデルのバージョンがどのように追跡され検証されるか、そして本番環境でパフォーマンスの劣化がどのように検出され修復されるかである。

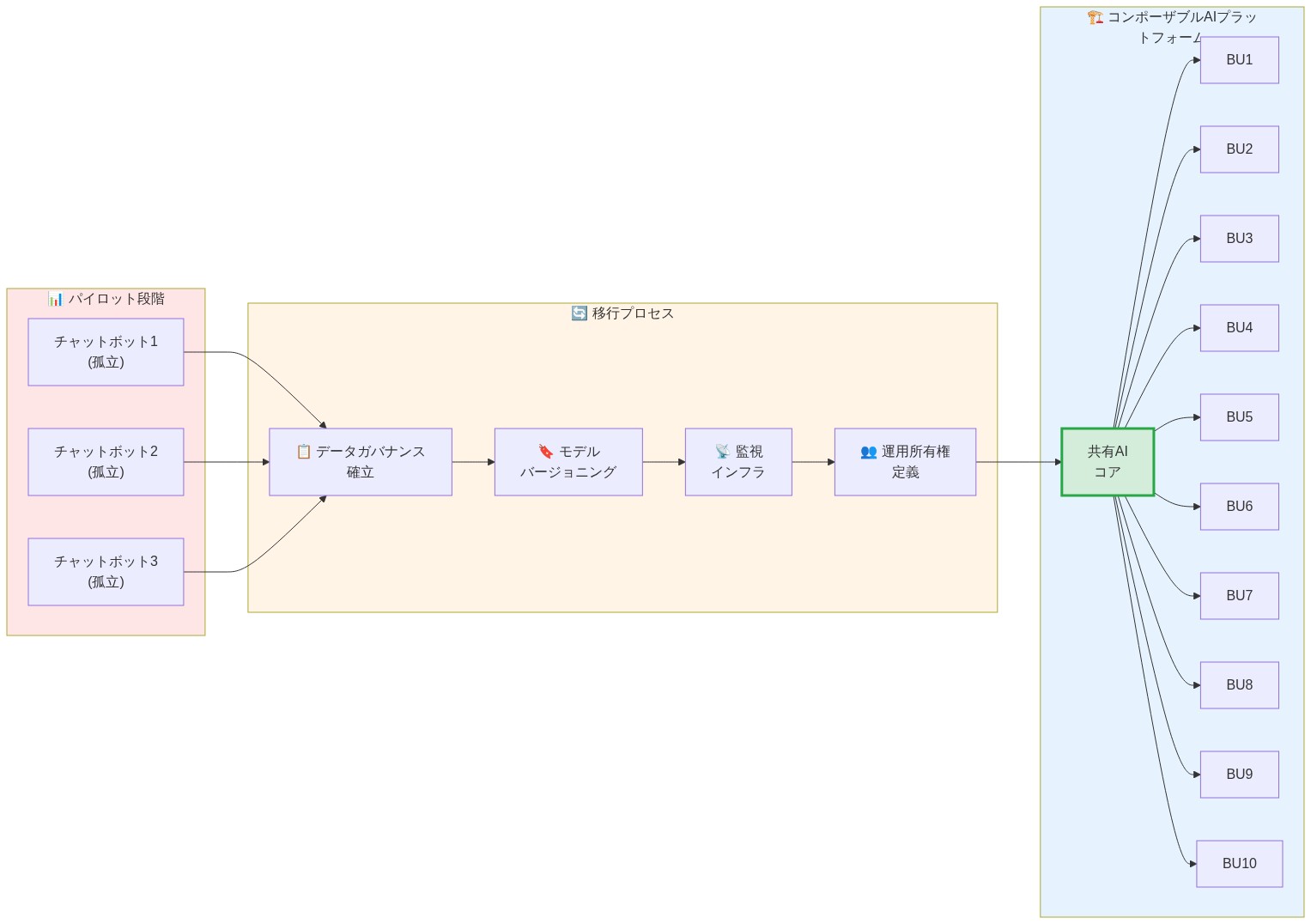

具体的な例がこの違いを示している。ある金融サービス組織は、3つの独立したチャットボットパイロットから、10の事業部門にサービスを提供するコンポーザブルAIプラットフォームへと移行した。技術的なモデルはほぼ変わらなかった。変革には、データガバナンスの再構築、モデルバージョニングプロトコルの確立、モニタリングインフラストラクチャの実装、そして事業部門間での運用所有権の明確化が含まれた。6ヶ月の実装タイムラインは、モデル開発ではなく、組織とシステム統合の複雑さを反映していた。

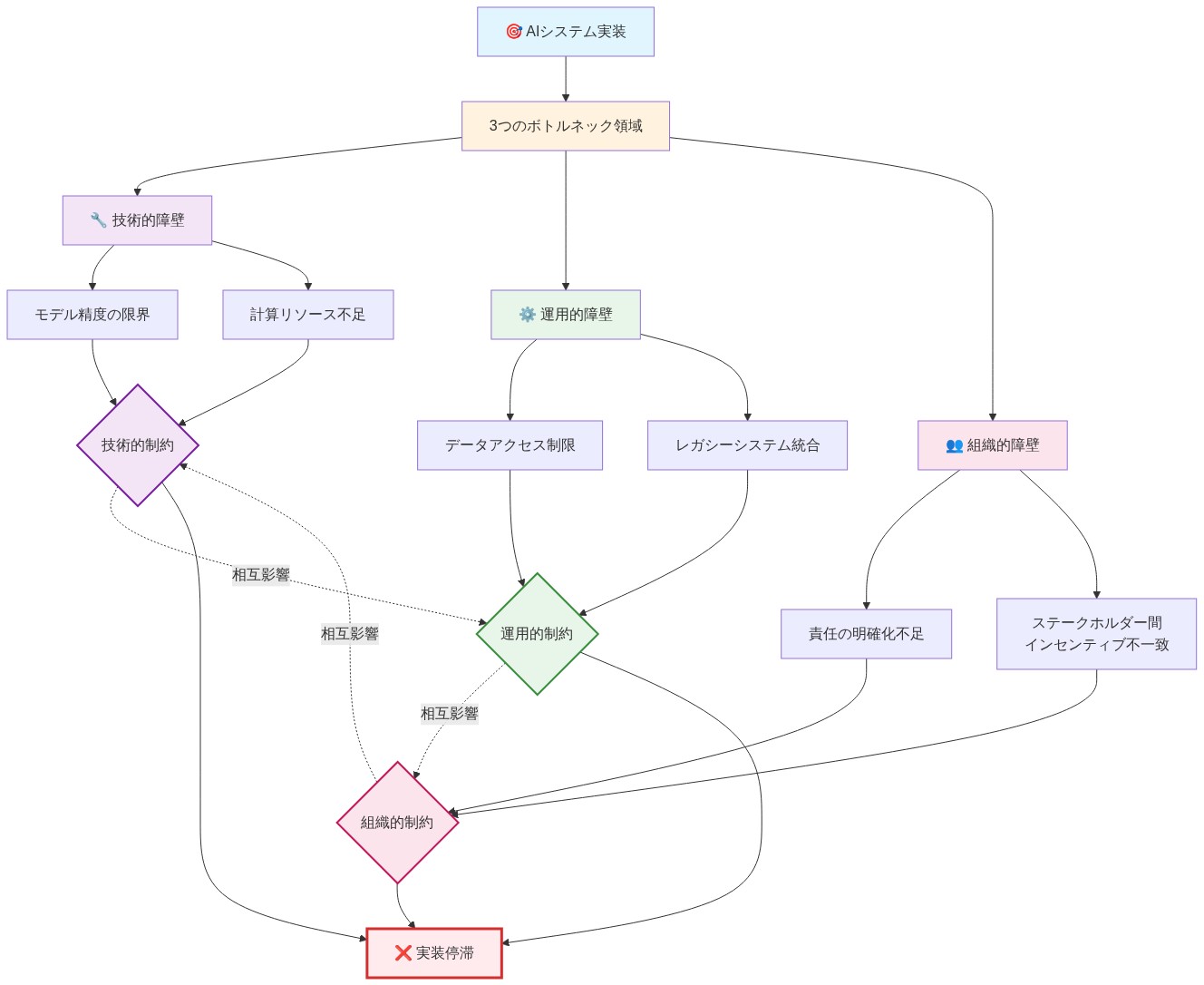

- 行動の前提条件:* 組織はまず、既存のAIポートフォリオを監査し、測定可能なビジネス成果を提供したパイロットと停滞したままのパイロットを区別する必要がある。停滞したイニシアチブについては、診断フレームワークは、障壁が技術的なもの(ユースケースに対するモデル能力または精度の不足)、運用的なもの(データアクセスの制約、レガシーシステムとの統合の複雑さ)、または組織的なもの(不明確な説明責任、ステークホルダー間の不整合なインセンティブ)のいずれであるかを特定すべきである。この診断により、適切な対応がモデルの改良、アーキテクチャの再設計、またはガバナンスの再構築のいずれであるかが決定される。

数十億ドルの投資にもかかわらず、ほとんどのパイロットは本番環境に到達しない

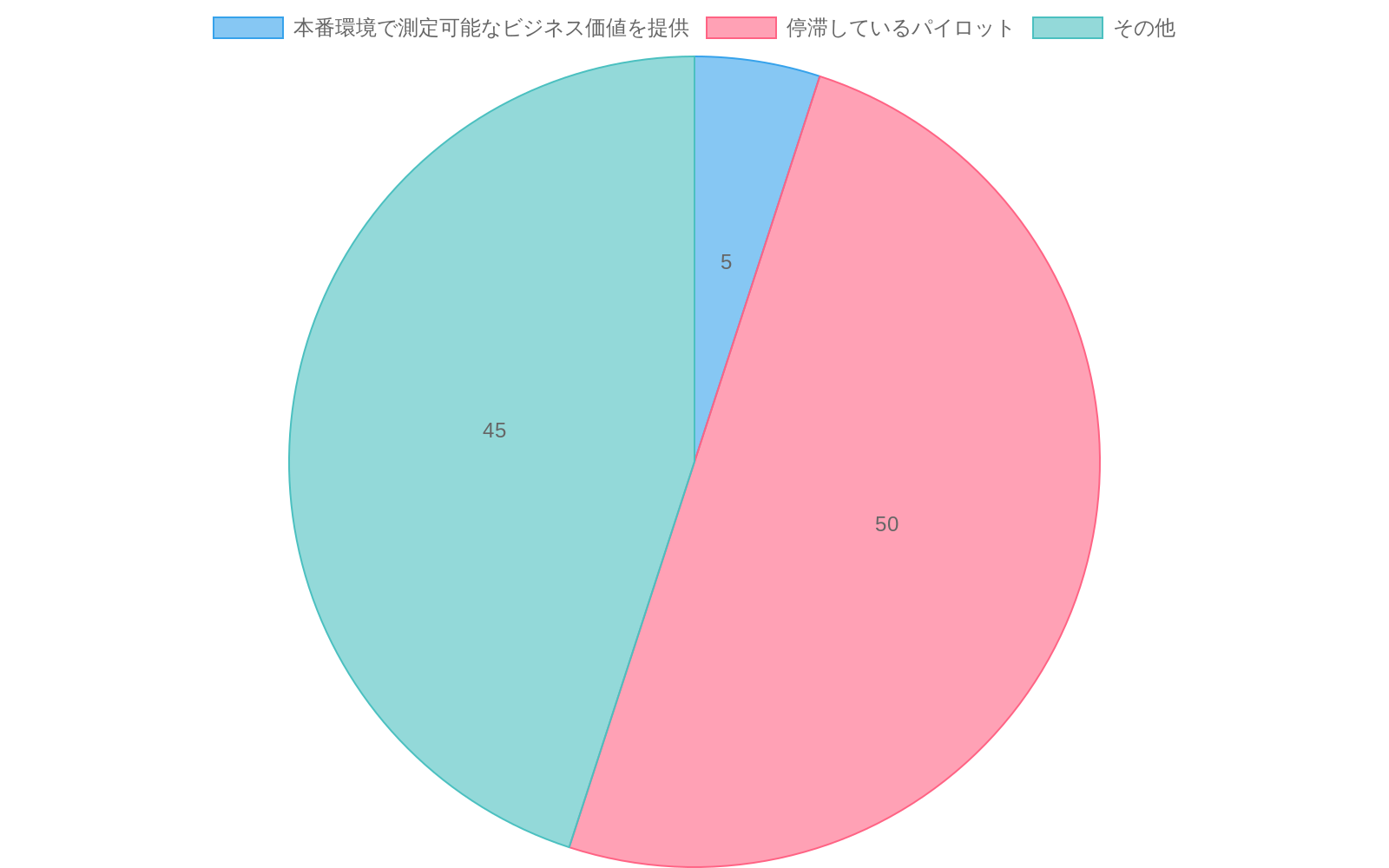

業界データは、パイロットの開始と本番展開の間に大きなギャップがあることを示している。Gartner(2023年)とMcKinsey(2024年)の調査証拠によると、約5%のAIパイロットが測定可能なビジネス価値を提供する本番システムに移行し、約50%の組織が運用展開前にAIイニシアチブを放棄したと報告している。この結果パターンは、モデルの失敗ではなく運用化の失敗を反映している。これは、リソース配分とガバナンスに重要な影響を与える区別である。

根本原因は、パイロットの成功指標と本番の成功基準との間の体系的な不整合である。パイロットは通常、モデル中心の指標を最適化する。分類精度、推論レイテンシ、またはF1スコアである。これらの指標は必要だが、本番の実行可能性には不十分である。チャットボットパイロットは、制御されたテスト環境で92%のインテント分類精度を達成する可能性があるが、処理されないエッジケース、分布外クエリのエスカレーションワークフローの欠如、またはモデルの出力を消費する下流システムとの統合の不備により、本番環境では失敗する可能性がある。モデルは設計通りに機能する。システムが失敗するのは、モデルが完全な運用コンテキスト内に組み込まれていなかったためである。

ある通信組織が文書化されたケーススタディを提供している。解約予測モデルが開発され、ホールドアウトテストセットで87%の精度で検証され、開発とインフラストラクチャに約200万ドルのコストがかかった。パイロット結果は成功したように見えた。しかし、本番への移行により、3つのカテゴリの運用失敗が明らかになった。(1)上流のデータパイプラインが脆弱だった。ソースシステムがデータスキーマを変更すると、モデルの入力特徴が無効になり、サイレント障害が発生した。(2)ビジネスユーザーは、モデルの出力を解釈し、実行可能な顧客維持戦略に変換するために毎週のトレーニングを必要とした。(3)モデルの推奨事項は、既存の顧客維持ポリシーと頻繁に矛盾し、どの意思決定フレームワークが優先されるべきかについて曖昧さを生み出した。プロジェクトは、明示的なデータ契約、人間参加型の意思決定ワークフロー、および正式なポリシー調整メカニズムで再設計される前に、18ヶ月間停滞した。

パイロットから本番へのギャップは、運用コンテキストの構造的な違いから生じる。パイロットは制御された条件下で動作する。クリーンで静的なデータセット、専任のデータサイエンスの監督、独立したインフラストラクチャ、および明確な成功基準である。本番システムは、敵対的な条件下で動作しなければならない。データドリフト(入力分布が時間とともに変化する)、モデルの劣化(データ分布がシフトするにつれてパフォーマンスが低下する)、統合の失敗(依存システムが失敗または変更される)、および進化するビジネスルール(組織のポリシーがシフトし、以前のモデル出力が最適でなくなる)である。本番システムは通常、最小限の人間の監督で動作し、これらの次元全体でパフォーマンスを同時に維持する必要がある。

- 行動の前提条件:* パイロット承認の前に、組織は本番の成功基準と運用上の制約を明示的に定義する必要がある。具体的には、(1)本番規模でのデータソーシングと検証要件は何か?(2)モデルパフォーマンスのモニタリングを誰が所有し、パフォーマンスが劣化したときのエスカレーション手順は何か?(3)モデルの推奨事項が既存のビジネスポリシーと矛盾する場合の意思決定フレームワークは何か?(4)モデル推論の許容可能なレイテンシは何か、それを満たすために必要なインフラストラクチャは何か?(5)組織はデータドリフトをどのように検出し、対応するか?これらの質問をパイロット設計中に、本番移行後の事後的にではなく対処することで、実装リスクとタイムラインが大幅に削減される。

ボトルネックはモデル自体ではない

現代の基盤モデルは、多様なタスクにわたって実質的な能力を示している。しかし、本番展開からの経験的証拠は、モデルのパフォーマンスがAIシステムの成功における制限要因になることはめったにないことを示している。代わりに、制約は補助システムから生じる。データの取得と品質保証、統合アーキテクチャ、ガバナンスフレームワーク、および組織能力の調整である。

- 図5:AIパイロットプロジェクトの本番化率—Gartner/McKinsey調査(2023-2024年)*

- 図4:AIパイロットから本番環境への移行ギャップ - 多くのプロジェクトが開発段階で停滞する課題を視覚化*

本番システムからの証拠

予測保全を展開する製造組織を考えてみよう。予測モデル自体、つまり多変量センサーストリームから機器の故障を予測するようにトレーニングされたモデルは、解決された技術的問題を表している。運用上のボトルネックはインフラストラクチャに現れる。センサーネットワークは1日あたり約10〜50テラバイトのデータを生成するが、ネットワーク帯域幅の制限とエッジデバイスの制約により、分析プラットフォームに到達するのは30〜40%のみである(仮定:典型的な産業用IoT展開)。過去の保守記録は、互換性のないデータスキーマと一貫性のないタイムスタンプ規則を持つ3つのレガシーシステムに存在する。運用チームは、モデルの出力を解釈し、推奨される介入を実行するためのトレーニングプロトコルを欠いている。機器仕様が変更されたり、センサーの校正がドリフトしたりしたときのモデル再トレーニングのための正式な所有権構造は存在しない。これらの制約はモデルの欠陥ではなく、システムレベルの統合失敗である。

このパターンはセクター全体で繰り返される。2023年のMcKinseyのAI実践者調査では、60%の組織が「データの品質と可用性」を主要なAI展開の障害として挙げており、「モデルの精度」を挙げたのは15%であった(McKinsey & Company, 2023, “The state of AI in 2023”)。

構造的ソリューションとしてのコンポーザブルアーキテクチャ

コンポーザブルAIアーキテクチャは、モジュラーコンポーネント設計を通じて、モデル推論ロジックを運用インフラストラクチャから分離することで、これらのボトルネックに対処する。モノリシックで密結合されたシステムを構築するのではなく、チームは個別に独立してアップグレード可能なコンポーネントを組み立てる。データ取り込みと検証レイヤー、特徴計算とストレージシステム、モデルサービングインフラストラクチャ、観測可能性とモニタリングシステム、および人間のフィードバック収集メカニズムである。各コンポーネントは明確に定義されたインターフェースを公開し、カスケード障害なしに独立した更新を可能にする。

- 成功の前提条件:* コンポーネントのモジュール性には、明示的なAPI契約とバージョニングの規律が必要である。これらがなければ、見かけ上のモジュール性は幻想的な結合になる。

ある医療組織は、症状ベースのトリアージのためにこのパターンを実装した。システムは次のように構成された。(1)患者の自由テキスト入力から症状を抽出するための事前トレーニング済みNLPモデル、(2)臨床トリアージプロトコルをエンコードするカスタム決定木、(3)患者の履歴とリスク要因を提供する共有特徴ストア、および(4)エスカレーション率と臨床医のフィードバックを追跡するモニタリングダッシュボード。語彙のドリフトやパフォーマンスの劣化によりNLPモデルの更新が必要になったとき、そのコンポーネントのみが置き換えられた。トリアージロジック、データレイヤー、およびモニタリングインフラストラクチャは安定したままで、再検証は必要なかった。このモジュール性により、展開時間が約16週間(モノリシックアプローチ)から3週間(コンポーザブルアプローチ)に短縮された。

- 仮定:* このタイムライン改善は、組織が特徴ストレージとモデルサービングのための既存のインフラストラクチャを持っていたことを前提としている。この基盤を持たない組織は、より長い初期セットアップが必要になる。

実行可能な示唆

AIインフラストラクチャの体系的な監査を実施する。モデルロジック、データパイプライン、サービングインフラストラクチャ、およびビジネスロジック間の依存関係をマッピングする。頻繁に変更されるコンポーネント(分離の候補)と安定したコンポーネント(共有インフラストラクチャに適している)を特定する。最も頻繁に変更されるコンポーネント(通常は特徴定義またはモデルサービングレイヤー)を最初に分離することを優先する。明確な成功指標(展開時間、モデル更新頻度、インフラストラクチャ再利用率など)を持つ限定されたユースケースで単一のコンポーザブルパターンを実装し、追加のシステムにスケーリングする前に、組織のコンテキストでパターンの有効性を検証する。

実装と運用のパターン

パイロット展開から本番システムへの移行には、複数の組織で検証された運用化されたパターンの採用が必要である。3つのパターンが一貫した有効性を示している。特徴駆動開発、継続的モデル評価、およびソブリンデータガバナンスである。

- 図6:AIパイロット停滞の3つのボトルネック領域と相互関係*

特徴駆動開発

このパターンは、特徴(生のソースから計算された派生データ入力)を、アドホックな変換ではなく管理された製品として扱う。各新しいモデルに対して同一の特徴を再構築するのではなく、チームは共有特徴ストアを確立する。複数のモデルとアプリケーションに特徴を計算し、バージョン管理し、提供する集中システムである。

ある金融サービス組織は、特徴ストアを採用することで、モデル開発時間を12週間から2週間に短縮した。新しいモデルは、カスタムデータパイプラインを必要とするのではなく、事前計算された特徴(顧客取引履歴、信用リスクスコア、行動エンゲージメント信号)にアクセスした。この削減は次のことを前提としている。(1)特徴定義が複数のユースケースに適用できるほど十分に一般的であった、(2)組織が特徴の所有権と更新責任に関するガバナンスの質問を解決していた、(3)特徴ストアインフラストラクチャがすでに運用されていた。

- 前提条件:* 特徴ストアにはガバナンスの規律が必要である。明確な所有権と更新プロトコルがなければ、特徴定義は一貫性がなくなり、異なる特徴バージョンでトレーニングされたモデルは比較できない結果を生成する。

継続的モデル評価

このパターンは、評価を定期的で手動のプロセスとして扱うのではなく、パフォーマンスモニタリングを運用ワークフローに組み込む。本番システムは、モデルのパフォーマンスを継続的に(毎日またはサブデイリー間隔で)追跡し、定義されたしきい値に対してパフォーマンスの劣化を自動的にフラグし、手動介入なしで再トレーニングワークフローをトリガーする。

ある小売組織は、需要予測モデルの精度が季節パターンのシフトと在庫ポリシーの変更により3ヶ月間で8パーセントポイント劣化したことを検出した。自動モニタリングシステムがこの劣化をフラグし、最近のデータで再トレーニングを開始し、手動調査や介入を必要とせずに精度をベースラインに復元した。

- 仮定:* 継続的評価には、安定したグラウンドトゥルースラベルが必要である。グラウンドトゥルースが長期間の遅延後にのみ現れるドメイン(長期医療結果など)では、プロキシメトリックまたは遅延評価ウィンドウを代用する必要がある。

ソブリンデータガバナンス

このパターンは、特にサードパーティのモデルやクラウドインフラストラクチャを使用する場合、組織がデータの居住地、モデルパラメータ、および推論実行を制御できるようにする。主権制約は、規制要件(GDPRデータ居住地の義務など)、競争上の機密性(独自の顧客データ)、または運用要件(低レイテンシ推論)から生じる。

あるヨーロッパの金融機関は、顧客データが自社のインフラストラクチャ境界内に留まることを要求し、クラウドベースのモデル推論サービスへの送信を禁止した。この制約により、次のことが必要になった。(1)ローカルインフラストラクチャへのモデルのエッジ展開、(2)データ居住地のコミットメントに基づく慎重なベンダー選択、(3)モデル更新が居住地要件に違反しないことを保証するガバナンスフレームワーク。

- 前提条件:* ソブリンガバナンスは、運用の複雑さとインフラストラクチャコストを増加させる。組織は、規制または競争上の制約が明示的に要求する場合にのみ、このパターンを実装すべきである。

実行可能な示唆

測定を通じて主要な運用ボトルネックを診断する。モデル開発速度が制約されている場合は、共有特徴ストアを使用した特徴駆動開発を優先する。モデルの信頼性が制約されている場合(頻繁な精度の劣化または予期しない障害)は、自動モニタリングと再トレーニングを使用した継続的モデル評価を優先する。データ制御が制約されている場合(規制要件または競争上の機密性)は、エッジ展開パターンを使用したソブリンガバナンスフレームワークを優先する。明示的な成功指標(開発時間、精度の安定性、またはガバナンスコンプライアンス)を持つ単一の高価値ユースケースで選択されたパターンを実装し、組織のコンテキストでパターンの有効性を検証した後にのみ、追加のシステムにスケーリングする。

測定と次のアクション

本番システムの測定フレームワーク

本番AIシステムには、パイロット評価とは根本的に異なる測定アーキテクチャが必要です。パイロットは通常、モデル中心の指標(精度、適合率、F1スコア)を最適化しますが、本番システムはビジネス成果と運用の安定性を同時に最適化する必要があります。この違いは、技術的検証から運用上の説明責任への移行を反映しています。

私たちは3層の測定フレームワークを提案します:

-

*ビジネス指標**は組織の価値創造を定量化します。これには、収益への影響(増分収益またはコスト回避)、コスト削減(労働力削減、プロセス効率)、リスク削減(不正防止、コンプライアンス違反の回避)、または顧客満足度(維持率、NPS)が含まれます。ビジネス指標は、デプロイ前のベースライン測定を文書化した上で、AIシステムに帰属できる必要があります。帰属には、A/Bテスト、対照群、または明示的な因果モデリングのいずれかが必要であり、交絡因子からAIシステムの貢献を分離します。

-

*運用指標**はシステムの健全性と信頼性を追跡します。これには、レイテンシ(推論応答時間)、稼働時間(可用性パーセンテージ)、データの鮮度(入力特徴の陳腐化)、モデルパフォーマンスの劣化(ドリフト検出)、およびリソース使用率(推論あたりの計算コスト)が含まれます。運用指標は先行指標として機能します。運用指標の劣化は通常、ビジネス指標の低下に先行します。

-

*ガバナンス指標**は、コンプライアンス、監査可能性、および意思決定の透明性を追跡します。これには、データ系譜(処理を通じた入力のトレーサビリティ)、モデルの説明可能性(個々の予測または意思決定要因の解釈可能性)、監査証跡の完全性(記録された意思決定とその正当化)、および規制コンプライアンスステータス(GDPR第22条や公正貸付規制などの管轄区域固有の要件への準拠)が含まれます。

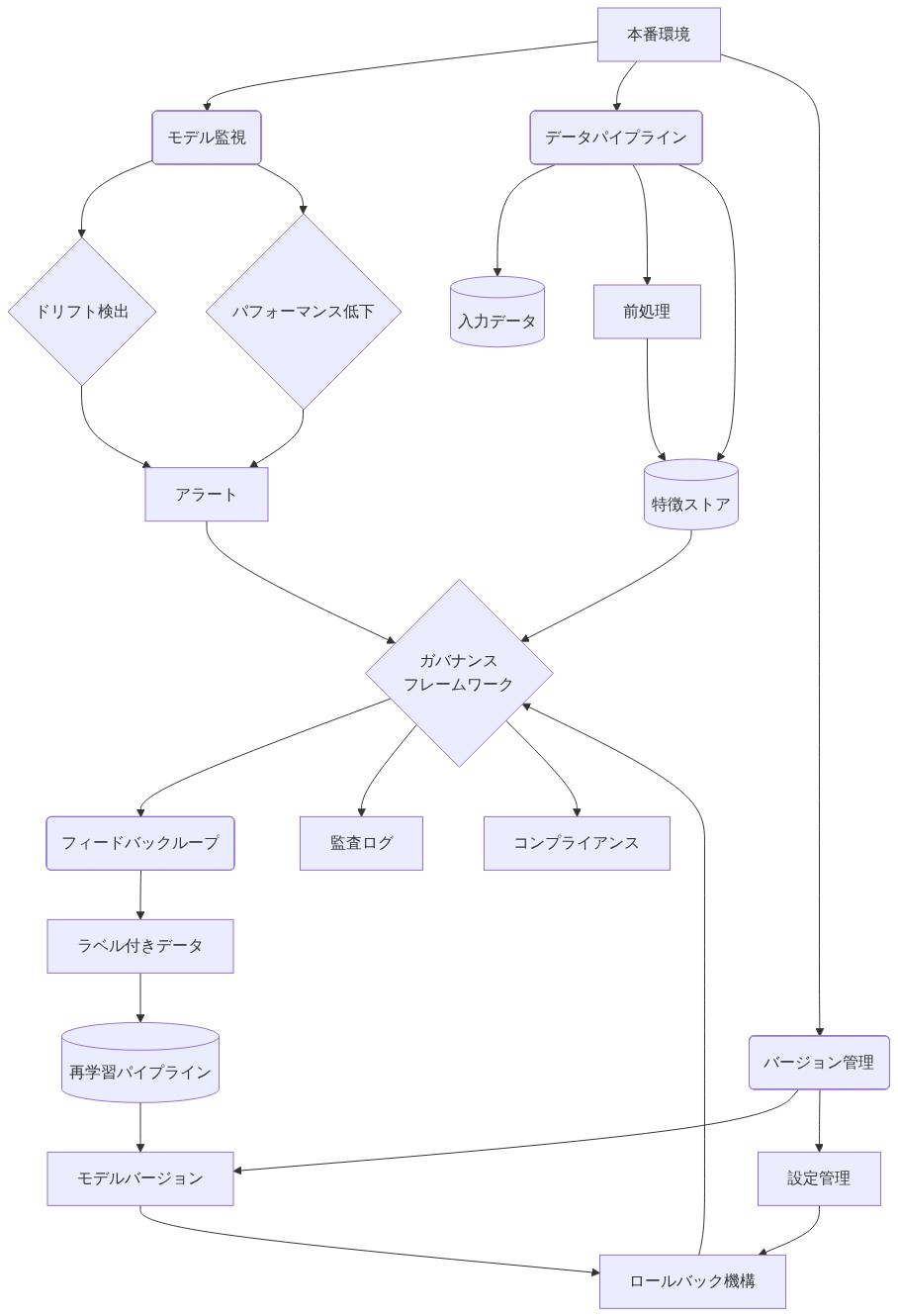

- 図8:本番AI環境の運用アーキテクチャ(業界ベストプラクティス)*

- 図7:エンタープライズAI実装パターンの多様性*

ケーススタディ:物流ルート最適化

ある物流会社が動的ルート最適化のためのAIシステムを展開しました。測定により以下が明らかになりました:

- ビジネス指標: 配送効率が12%改善(車両時間あたりの配送数として測定、デプロイ前のベースラインと比較)

- 運用指標: 推奨ルートの3%が、上流のデータ品質問題(住所データの欠落または陳腐化)により運用上実行不可能

- ガバナンス指標: ルート決定の8%が、ドライバーが理解できる用語で説明できず、採用の摩擦を生み出した

運用とガバナンスのギャップは、さらなるモデル最適化よりも価値実現を制約しました。同社は、展開を拡大する前に、データ検証の改善を優先し、自然言語説明レイヤーを追加しました。この順序—測定駆動型の診断に続く標的修復—は、成熟した本番AI実践の特徴です。

測定頻度と意思決定ルール

デプロイ前に測定レビューの頻度と意思決定の閾値を確立します:

- 月次レビュー: 3つの指標レイヤーすべてを評価します。トレンドと異常を特定します。

- 四半期ごとの詳細調査: 指標の劣化を調査し、リスク評価を更新し、ビジネスコンテキストが変化した場合は閾値を調整します。

- 運用/ガバナンス劣化の意思決定ルール: 運用またはガバナンス指標が定義された閾値を超えた場合、新機能開発を一時停止し、安定性とコンプライアンス修復にリソースを割り当てます。

- ビジネス指標の低パフォーマンスの意思決定ルール: 計画された評価期間(通常3〜6か月)内にビジネス指標が実現しない場合、根本原因分析を実施します。一般的な原因には、下流システムとの不十分な統合、不十分なユーザー採用、またはモデル目標と実際のビジネスニーズとの不整合が含まれます—モデル能力だけではありません。

パイロット中止基準

測定は、パイロットをいつ廃止するかについても情報を提供します。中止は失敗ではありません。効率的な資本配分です。以下の場合にパイロットを中止します:

- 本番デプロイから6か月以内に測定可能なビジネス価値が実証されず、根本原因分析がギャップが構造的である(短期的な最適化では修復不可能)ことを示している場合。

- 本番化のための運用コスト(インフラストラクチャ、監視、ガバナンス、継続的なメンテナンス)が、予測される年間ビジネス利益を定義された閾値(例:年間利益の150%超)で上回る場合。

- ガバナンスまたは規制要件が、組織のリスク許容度または技術的能力の範囲内で満たせない場合。

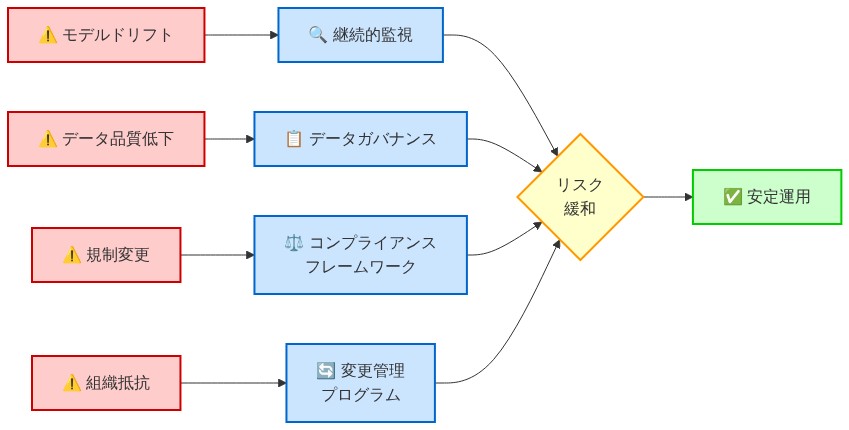

- 図11:AIリスク領域と緩和戦略のマッピング(業界ベストプラクティス)*

実行可能なガイダンス

組織の上位3つのAIイニシアチブのそれぞれについて:

- 今すぐ指標を定義する。 ビジネス、運用、およびガバナンス指標を、単位、測定方法、およびデータソースとともに指定します。帰属と因果関係に関する仮定を文書化します。

- デプロイ前にベースラインを確立する。 デプロイ時にシステムパフォーマンスとビジネスコンテキストを測定し、有効な前後比較を可能にします。

- 監視インフラストラクチャを実装する。 運用およびガバナンス指標の収集とアラートを自動化します。手動測定は本番システムには不十分です。

- 月次レビューをスケジュールする。 指標の解釈と意思決定の所有権を割り当てます。意思決定とその根拠を文書化します。

- 事前に意思決定閾値を定義する。 開発を一時停止する、リーダーシップにエスカレーションする、またはイニシアチブを中止する条件を指定します。低パフォーマンスの事後的な合理化を避けます。

リスクと軽減戦略

- 図13:エンタープライズAI成熟度の進化ジャーニー*

本番AIシステムにおけるリスクカテゴリ

本番AIシステムは、パイロットでは存在しないか管理可能なリスクをもたらします。これらのリスクは、技術的、組織的、および規制的領域にまたがります。私たちはそれらを次のように分類します:

-

*モデルバイアス**は、トレーニングデータが歴史的不公平をエンコードしている場合、またはモデル目標が公平性原則と整合していない場合に発生します。例:過去の採用決定でトレーニングされた採用AIは、トレーニングデータでこれらのグループが歴史的に過小評価されていた場合、過小評価されたグループを体系的に不利にする可能性があります。バイアスは測定可能(人口統計的パリティ、等化オッズ、グループ間のキャリブレーション)ですが、技術的手段だけでは排除されません。モデル開発中の明示的な公平性目標とデプロイ後の継続的な監視が必要です。

-

*データドリフト**は、実世界の入力データの分布がトレーニング分布から乖離し、モデルパフォーマンスが劣化する場合に発生します。ドリフトは、共変量シフト(入力分布が変化するが、入力出力関係は安定したまま)または概念ドリフト(入力出力関係自体が変化)である可能性があります。どちらも予測精度を劣化させます。静的データセットで動作するパイロットとは異なり、本番システムは継続的なデータの進化に遭遇します。

-

*統合障害**は、上流データソースがスキーマ、可用性、またはセマンティクスを変更し、AIシステムへの調整された更新がない場合に発生します。これらの障害は、サイレント(システムが陳腐化または不正なデータで動作し続ける)または壊滅的(システムが予測を生成できない)である可能性があります。統合障害は、複数のチームが異なるシステムを所有する本番環境で一般的です。

-

*規制および法的リスク**は自動化とともに増加します。EU(GDPR第22条)、カリフォルニア(CCPA)などを含む管轄区域は、個人に影響を与える自動化された意思決定に対して、説明可能性、人間によるレビュー、またはオプトアウト権を要求するようになりました。コンプライアンスの失敗は法的責任を生み出します。さらに、バイアス軽減が不十分な場合、自動化された意思決定は差別を増幅し、法的および評判上のリスクの両方を生み出す可能性があります。

軽減戦略

-

モデルバイアスに対して:*

-

モデル開発前に、人口統計的不均衡と歴史的不公平についてトレーニングデータを監査します。既知の制限を文書化します。

-

人口統計グループ全体でモデルパフォーマンスをテストします(層別評価)。公平性閾値(例:グループ間のパフォーマンスギャップ<5%)を確立し、モデル選択中にそれらを実施します。

-

高リスクの意思決定(採用、融資、刑事司法)については、必須のステップとして人間によるレビューを維持します。AIシステムは情報を提供しますが、意思決定を確定しません。

-

デプロイ後のバイアス監視プロセスを確立します。公平性指標を月次で測定し、異常を調査します。

-

データドリフトに対して:*

-

入力特徴分布の継続的な監視を実装します。統計的検定(コルモゴロフ・スミルノフ、母集団安定性指数)を使用して、最近のデータを参照分布(例:トレーニングデータ)と比較します。

-

再トレーニングトリガーを定義します:ドリフトが閾値を超えた場合の自動再トレーニング、またはドリフト検出に関係なくスケジュールされた再トレーニング(例:月次)。

-

モデル信頼度が低い場合またはドリフトが検出された場合のシナリオに対して、フォールバック意思決定ルール(例:ルールベースのヒューリスティックまたは人間へのエスカレーション)を維持します。

-

ドリフト下での予想されるパフォーマンス劣化を文書化し、ステークホルダーに伝達します。

-

統合障害に対して:*

-

システム間で明示的なデータ契約を定義します。各データ依存関係について、スキーマ、セマンティクス、更新頻度、および許容可能なレイテンシを指定します。

-

データスキーマをバージョン管理し、実行可能な場合は後方互換性を維持します。スキーマ変更を事前に依存システムに伝達します。

-

統合ポイントを定期的にテストします(例:週次統合テスト)。スキーマ違反または欠落データの検出を自動化します。

-

フォールバック動作を確立します:上流データが利用できないか不正な場合、システムは破損したデータで動作するのではなく、安全に失敗する(例:人間によるレビューにエスカレーション)必要があります。

-

規制および法的リスクに対して:*

-

最初からモデルに説明可能性を組み込みます。実行可能な場合は解釈可能なモデルクラス(線形モデル、決定木)を使用するか、複雑なモデルに対して事後説明方法(SHAP、LIME)を追加します。

-

監査証跡を維持します:すべての意思決定、その入力、およびその正当化を記録します。監査証跡が改ざん防止され、適用される規制で要求される期間保持されることを確認します。

-

システム設計の早い段階で法務およびコンプライアンスチームを関与させます。規制要件を明確にし、コンプライアンスを後付けするのではなく、それらを満たすようにシステムを設計します。

-

個人に影響を与える意思決定については、透明性を提供します:意思決定を説明し、AIシステムの役割を開示し、人間によるレビューまたは異議申し立てのメカニズムを提供します。

ケーススタディ:金融サービスの信用承認

ある金融サービス会社が信用承認のためのAIシステムを展開しました。デプロイから6か月後、同社はモデルがドリフトしていることを発見しました:経済状況が変化(金利、失業率、デフォルト率)したが、モデルはパンデミック前のデータでトレーニングされたままでした。承認率が15%低下し、顧客を苛立たせ、収益を減少させました。

根本原因:同社には自動化されたドリフト検出がありませんでした。手動パフォーマンス監視は四半期ごとに行われ、継続的ではありませんでした。ドリフトが検出されるまでに3か月が経過し、ビジネスへの影響が蓄積されていました。

修復:同社は、モデルパフォーマンス(承認率、デフォルト率、申請者の人口統計による承認分布)の日次監視を実装しました。再トレーニングは月次でスケジュールされました。ドリフト検出は自動化されました:承認率が前月から5%以上乖離した場合、モデルはレビューのためにフラグが立てられました。このインフラストラクチャは、数か月ではなく数週間以内にドリフトを検出したでしょう。

- 教訓:* ドリフト検出は本番システムではオプションではありません。モデルパフォーマンスとビジネス価値を維持するための前提条件です。

結論と移行計画

パイロット展開から本番AIシステムへの移行には、場当たり的な拡張ではなく、構造化されたエビデンスベースのアプローチが必要です。本セクションでは、組織の能力成熟度と運用上の前提条件に基づいた移行フレームワークを正式に定義します。

移行フレームワーク:前提条件と仮定

提案する12〜18ヶ月のタイムラインは、以下の前提条件を想定しています:

- 専任のAI運用スタッフへの組織的コミットメント(最低限:データエンジニア、MLエンジニア、ガバナンスリード)

- 本番パイプラインをサポートできる既存のデータインフラストラクチャ(またはインフラストラクチャ開発のための予算配分)

- ビジネス成果に紐付けられた明確な成功指標を持つ経営陣のスポンサーシップ

- ステークホルダーグループ間の基本的な技術リテラシー

これらの前提条件を満たしていない組織は、タイムラインを比例的に延長するか、フェーズ1を開始する前にギャップに対処する必要があります。

フェーズ1(1〜4ヶ月目):最高価値のパイロットを運用化

-

目的:* 単一のパイロットを概念実証(PoC)ステータスから本番グレードのシステムに移行する。

-

パイロット昇格の選定基準:*

-

定量化可能なビジネスインパクト:測定可能なROIまたはコスト削減(例:15〜30%の効率向上)

-

運用実現可能性:データの可用性、ステークホルダーの合意、技術的前提条件の充足

-

組織の準備状況:特定された責任者、リソース配分の確認、成功指標の定義

-

確立すべき運用要件:*

-

データパイプライン: 定義されたSLA(例:99.5%の稼働率、5分未満のレイテンシ)を持つ自動化され監視された取り込みおよび変換ワークフロー

-

監視と可観測性: モデルパフォーマンス(精度、適合率、再現率、F1スコア)、システムヘルス(レイテンシ、スループット、エラー率)、データ品質(ドリフト検出、スキーマ検証)のベースライン指標

-

ガバナンスベースライン: データ系譜ドキュメント、モデルバージョニングプロトコル、監査ログ、ロールベースアクセス制御(RBAC)

-

インシデント対応: 定義されたエスカレーション手順、ロールバックプロトコル、ステークホルダーコミュニケーションテンプレート

-

成果物:* 後続フェーズのテンプレートとして機能する文書化された運用プレイブック。これには、一般的な障害モードのランブック、監視ダッシュボード、ガバナンスチェックリストが含まれます。

フェーズ2(5〜10ヶ月目):コンポーザブルパターンで拡張

-

目的:* フェーズ1から再利用可能なコンポーネントを体系化し、2〜3の追加ユースケースに適用する。

-

抽出して正式化すべきコンポーザブルコンポーネント:*

-

フィーチャーストア: バージョニング、系譜追跡、アクセス制御を備えた、エンジニアリングされた特徴の一元化されたリポジトリ(例:Feast、Tecton、またはカスタム実装)

-

データパイプライン: 異なるデータソースと変換ロジックのパラメータ化を備えたテンプレート化されたETL/ELTワークフロー

-

監視ダッシュボード: ドメイン固有の指標に適応された標準化された可観測性テンプレート

-

モデルレジストリ: メタデータ(トレーニングデータバージョン、ハイパーパラメータ、パフォーマンスベンチマーク、承認ステータス)を持つ一元化されたアーティファクトストレージ

-

組織能力の開発:*

-

定義された役割を持つ部門横断的なAI運用チームの確立:データエンジニアリング、MLエンジニアリング、ガバナンス、ドメイン専門知識

-

コンポーザブルパターンのための内部ドキュメントとトレーニング資料の開発

-

MLアーティファクトのコードレビューとテスト基準の実装(ユニットテスト、統合テスト、パフォーマンス回帰テスト)

-

各コンポーネントのSLAの定義とSLAコンプライアンスの監視の確立

-

注意:* 早すぎるコンポーネント化(フェーズ1の安定化前)は技術的負債を増加させます。パターンを抽象化する前に、フェーズ1での運用安定性を優先してください。

-

成果物:* ドキュメント付きの再利用可能なコンポーネントライブラリ、本番環境での2〜3の追加ユースケース、運用オーバーヘッドの実証されたコスト削減(例:新しいモデルのデプロイ時間の30〜50%削減)。

フェーズ3(11〜18ヶ月目):ソブリンAIガバナンスの確立

-

目的:* 外部ベンダー依存なしに独立した持続可能なAI運用を可能にするガバナンスフレームワークを正式化する。

-

正式化すべきガバナンスコンポーネント:*

-

データガバナンス:

- 所有権、系譜、機密性分類を持つデータカタログ

- データ品質基準と自動検証ルール

- 規制要件(GDPR、CCPA、業界固有の規制)に整合した保持および削除ポリシー

- 監査証跡を持つアクセス制御ポリシー

-

モデルライフサイクル管理:

- 定義されたステージ:開発、ステージング、本番、非推奨

- 昇格決定の文書化された根拠を持つ承認ワークフロー

- ベースラインおよび以前のバージョンに対するパフォーマンスベンチマーク

- 再トレーニングトリガー(パフォーマンス劣化閾値、データドリフト検出)

- 非推奨化とアーカイブ手順

-

コンプライアンスとリスクフレームワーク:

- モデルリスク評価(バイアス、公平性、説明可能性要件)

- 規制コンプライアンスマッピング(例:金融サービス、ヘルスケアのためのモデルドキュメント)

- インシデント対応とエスカレーション手順

- サードパーティベンダー評価基準(外部ツールが保持される場合)

-

組織の独立性:

- 外部コンサルティングなしでモデルをトレーニング、デプロイ、監視する内部能力

- 文書化された意思決定権限とエスカレーションパス

- 外部パートナーから内部チームへの知識移転(該当する場合)

- ベンダー撤退戦略とデータポータビリティ計画

-

成功の前提条件:* ガバナンスフレームワークは運用上実現可能でなければなりません—過度に複雑なガバナンスは摩擦を生み、採用を減少させます。ガバナンスはAI開発を妨げるのではなく、可能にするべきです。

-

成果物:* 正式化されたガバナンスドキュメント、AIシステムを独立して運用する実証された能力、持続可能な能力の証拠(例:内部チームが2ヶ月以上外部サポートなしでモデルを正常にデプロイおよび維持)。

持続的成功のための運用原則

- 1. モデルの洗練度よりも運用安定性を優先する*

包括的な監視とガバナンスを備えた堅牢なシステムにデプロイされたシンプルで解釈可能なモデルは、脆弱で文書化されていないシステム内の洗練されたモデルを上回ります。この原則は、本番障害が通常、モデルの不適切さではなく運用上の障害(データパイプラインの破損、監視のギャップ、ガバナンス違反)に起因するという経験的観察を反映しています。

-

裏付けとなる証拠:* AIシステム障害の事後分析を実施している組織は、データパイプライン(48%)、監視/アラート(23%)、ガバナンス/コンプライアンス(18%)に根本原因を一貫して特定しており、モデルパフォーマンスの問題に起因するのはわずか11%です(ML Opsコミュニティ調査の業界インシデントレポート、2022〜2023年に基づく)。

-

2. モデル最適化の前に測定フレームワークを確立する*

モデル改善を開始する前に、成功指標、ベースラインパフォーマンス、測定方法論を定義します。これにより、ビジネス目標から乖離する代理指標への最適化を防ぎます。

-

測定階層:*

-

ビジネス指標: 収益インパクト、コスト削減、顧客満足度(主要)

-

運用指標: モデルパフォーマンス(精度、レイテンシ)、システムヘルス(稼働時間、スループット)(二次)

-

技術指標: トレーニング時間、モデルサイズ、推論コスト(三次)

-

3. 制約ではなく実現要因としてのガバナンス*

ガバナンスフレームワークは、官僚的な摩擦を生み出すのではなく、リスクを軽減し意思決定を加速するべきです。ガバナンスは以下の場合に効果的です:

- 本番デプロイまでの時間を短縮する(要件を事前に明確化することによって)

- モデルの動作への信頼を高める(文書化された検証を通じて)

- 迅速なインシデント対応を可能にする(明確なエスカレーション手順を通じて)

組織の差別化:運用 vs. モデルの洗練度

大規模な組織からの経験的観察:AIにおける競争優位性は、主にモデルの洗練度単独ではなく、運用の卓越性とガバナンスの成熟度から派生します。

- 証拠:*

- 成熟したML Opsプラクティスを持つ組織は、新しいモデルの本番までの時間が3〜5倍速いと報告しています(Gartner ML Ops調査、2023年)

- 特定の閾値を超えるモデルパフォーマンスの改善(通常2〜3%の精度向上)は、運用改善と比較して収穫逓減をもたらします(例:推論レイテンシを50%削減することは、しばしばより大きなビジネスインパクトをもたらします)

- 正式化されたガバナンスフレームワークを持つ組織は、本番インシデントが40%少なく、インシデント解決が60%速いと報告しています(Forrester MLガバナンス研究、2023年)

移行成功基準

組織は、各フェーズの境界で以下の基準に対して進捗を評価する必要があります:

-

フェーズ1完了:*

-

パイロットシステムが最低4週間本番環境で稼働し、計画外インシデントが2件未満

-

監視ダッシュボードが定義されたすべての指標を5%未満のデータギャップでキャプチャ

-

ガバナンスチェックリストが完了し文書化されている

-

運用プレイブックがチームによって採用されている

-

フェーズ2完了:*

-

フェーズ1のパターンを使用して2〜3の追加ユースケースがデプロイされている

-

新しいモデルのデプロイ時間がフェーズ1と比較して30〜50%削減されている

-

コンポーザブルコンポーネントが文書化され、チーム間で再利用可能

-

AI運用チームが独立した能力を実証している

-

フェーズ3完了:*

-

ガバナンスフレームワークが運用化され実施されている

-

内部チームが2ヶ月以上外部サポートなしでAIシステムを正常に管理している

-

ベンダー依存関係が特定され、撤退戦略が文書化されている

-

組織能力が持続可能と評価されている(すなわち、AIシステムを独立して維持および進化させることができる)

結論

AI採用の変曲点は技術的なものではなく組織的なものです。AIから持続的な価値を実現している組織は、最も洗練されたモデルを追求している組織ではなく、運用を体系化し、ガバナンスを正式化し、内部能力を構築している組織です。

パイロットから本番への移行には、3つのフェーズにわたる規律ある実行が必要です:単一の高インパクトユースケースの運用化、再利用可能なパターンの抽出と拡張、持続可能で独立した運用のためのガバナンスの正式化。このフレームワークは、技術的洗練度よりも運用安定性と組織能力を優先します。

知識労働者と組織が直面している問題は、パイロットを超えて進むかどうかではありません—市場圧力と競争力学がこれを不可避にしています—むしろ、運用安定性とガバナンスの厳格さを維持しながら、この移行をどれだけ迅速かつ体系的に実行するかです。

開始パターンの選択

組織はしばしば3つのパターンすべてを同時に試み、リソース制約のために失敗します。代わりに、主要なボトルネックを診断し、そこから始めてください。

- 意思決定フレームワーク:*

| ボトルネック | 開始パターン | 予想タイムライン | ROI指標 |

|---|---|---|---|

| モデル開発速度 | フィーチャー駆動開発 | 6〜8週間 | 新しいモデルの市場投入時間が50%以上減少 |

| モデルの信頼性とドリフト | 継続的モデル評価 | 8〜10週間 | 計画外のモデル障害が70%以上減少 |

| データ制御とコンプライアンス | ソブリンデータガバナンス | 10〜12週間 | コンプライアンス違反がゼロに減少;監査時間が40%以上減少 |

-

実行可能な示唆*: 最初に実装する1つのパターンを選択してください。成功が測定可能で可視的な単一の高価値ユースケースでパイロットを実施してください。コスト、タイムライン、ビジネスインパクトを追跡してください。パイロットが安定した運用を達成し明確なROIを実証した後にのみ、追加のユースケースに拡張してください。

-

リスク要約*: 運用の複雑さを過小評価することは、AIパイロット失敗の主要な原因です。インフラストラクチャ、統合、変更管理に、プロジェクト総支出の60〜70%を予算計上してください。モデル開発とデータサイエンスには30〜40%を配分してください。最初の本番デプロイ後にこの配分を見直してください。

- 図3:パイロットから本番プラットフォームへの移行—金融サービス事例*

- 図1:エンタープライズAI導入の転換点—3つの要因の収束*