LLMの階層的スパース+低ランク圧縮

現代のLLMにおけるメモリ危機

-

主張:* 大規模言語モデルは現在、法外な量のメモリと計算資源を消費しており、実用的な展開と継続的な訓練のために圧縮は交渉の余地のない要件となっている。

-

前提条件と仮定:*

-

モデルは事前量子化なしで完全精度(FP32)または半精度(FP16)で保存されている。

-

展開対象には、リソース制約のある環境(エッジデバイス、小規模クラスタ)またはコスト重視の推論シナリオが含まれる。

-

「実用的な展開」は、トークンあたりの推論レイテンシが500ms未満、メモリフットプリントがターゲットハードウェアの利用可能なVRAM未満と定義される。

-

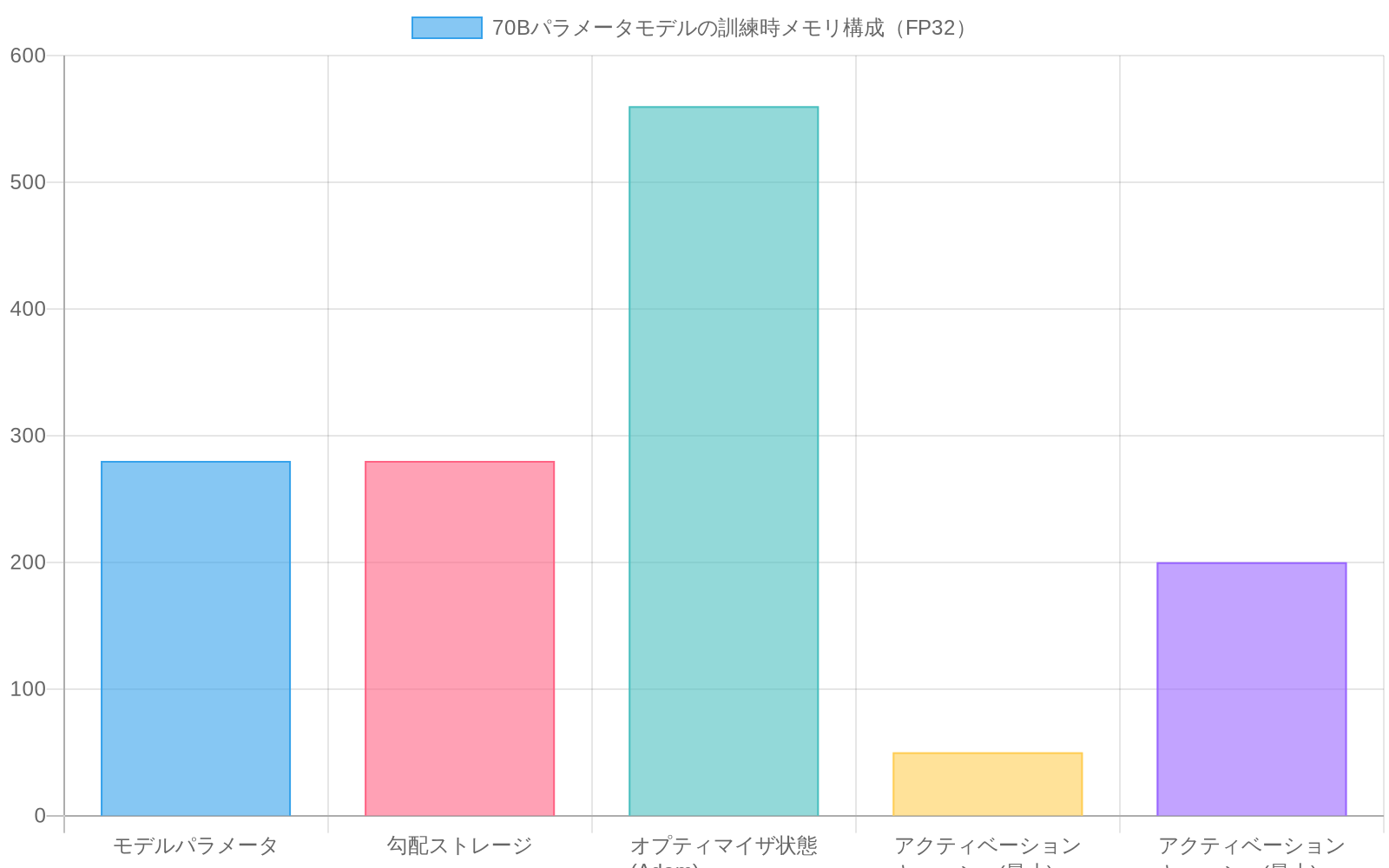

証拠:* FP32での700億パラメータモデルは約280GBのメモリを必要とする(700億パラメータ × 4バイト/パラメータ)。訓練中、メモリオーバーヘッドは勾配保存(280GB)、オプティマイザ状態(Adamの場合560GB)、活性化キャッシング(シーケンス長とバッチサイズに応じて50〜200GB)により倍増する。中程度のバッチサイズ(Hoffmann et al., 2022; Shazeer et al., 2019)での700億モデルの単一順伝播・逆伝播パスの総訓練メモリは1.1〜1.3TBに達する可能性がある。

-

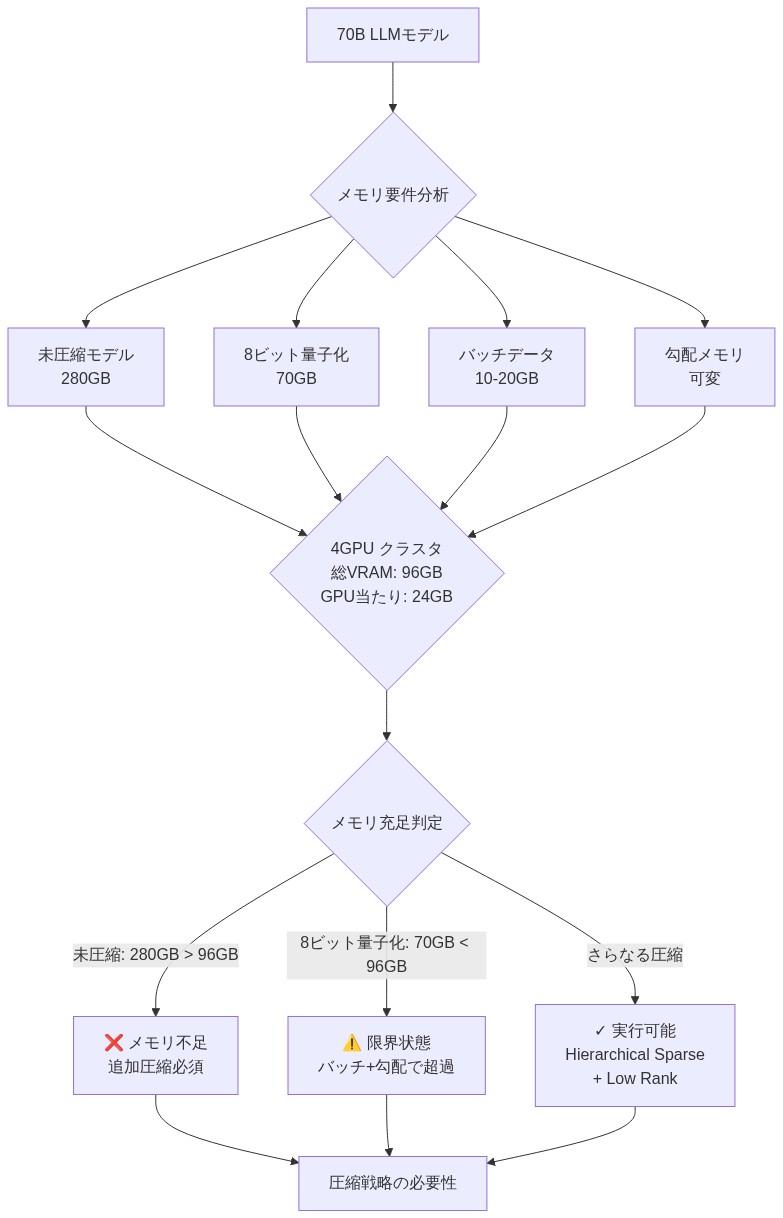

具体的なシナリオ:* 合計96GBのVRAM(GPU1台あたり24GB)を持つ4GPU構成のクラスタでは、単一の非圧縮700億モデルを収容できない。標準的な8ビット量子化によりフットプリントは70GBに削減されるが、バッチデータ(サイズ32〜64の推論バッチで通常10〜20GB)やファインチューニング勾配のための十分な余裕が残らない。したがって、制約のあるハードウェア上でマルチモデルサービング、バッチ処理、またはファインチューニングを可能にするには、量子化を超えた圧縮が必要である。

-

実行可能な示唆:* 圧縮戦略を選択する前に、現在のモデルのメモリフットプリントを測定し、主要なボトルネックを特定する:(1)推論レイテンシが制約である場合、計算効率を維持する圧縮方法を優先する(例:効率的な行列乗算カーネルを用いた低ランク因数分解)。(2)メモリがボトルネックである場合、積極的なパラメータ削減と引き換えに高いレイテンシのトレードオフを受け入れる。(3)両方が制約である場合、両方の目的をバランスさせるハイブリッドアプローチ(スパース+低ランク)を使用する。進める前に、ハードウェア仕様(VRAM、帯域幅、計算能力)とターゲットSLO(レイテンシ、スループット、精度)を文書化する。

- 図2:70Bパラメータモデルの訓練時メモリ構成(FP32)(出典:Hoffmann et al., 2022; Shazeer et al., 2019)*

- 図3:リソース制約環境でのメモリ不足シナリオ - 4GPU クラスタにおける70Bモデルの実行可能性分析*

2段階階層的スパース+低ランク圧縮

-

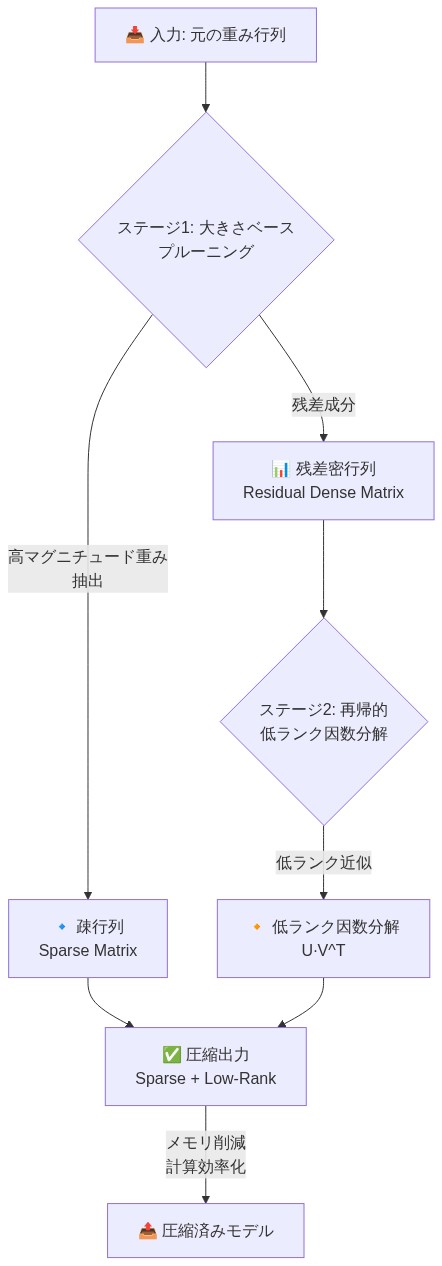

主張:* 階層的スパース+低ランク(HSS)圧縮は2段階のパイプラインを使用する:(1)マグニチュードベースのプルーニングにより高マグニチュード重みをスパース行列に抽出し、(2)残差密行列に再帰的低ランク因数分解を適用する。

-

理論的基礎:* HSS圧縮は、ニューラルネットワーク重みにおける2つの相補的な構造を利用する:(1)スパース性、少数の重みが不均衡に重要性を持つ(ヘビーテール分布)、(2)低ランク構造、プルーニング後の残差行列が、より小さな行列の積で捉えられる冗長性を示す。この分解は次のように形式化される:

$$W \approx S + U V^T$$

ここで、$W$は元の重み行列、$S$はスパース成分(高マグニチュード重み)、$U \in \mathbb{R}^{m \times r}$と$V \in \mathbb{R}^{n \times r}$はランク$r \ll \min(m, n)$の低ランク因子である。

-

根拠:* マグニチュードベースのプルーニング単独では外れ値の重みを効率的に除去するが、依然として相当なメモリを消費する密な残差が残る。低ランク因数分解は、元の行列を近似する2つのより小さな行列の積に分解することで、この残差を圧縮する。2段階アプローチは、どちらかの技術単独よりも効果的である。なぜなら:(1)スパース性は低ランク構造を必要とせずに孤立した強い接続を処理し、(2)低ランク因数分解は外れ値の重みによって破損されることなく残差の分散冗長性を捉えるからである。

-

具体例:* 1,048,576個のパラメータを含む1024×1024の重み行列を考える。

-

ステージ1(スパース性): 絶対マグニチュードで上位5%の重み(52,428個の重み)を特定し、スパース形式(例:COOまたはCSR)で保存する。残りの95%(995,148個の値)が密な残差行列を形成する。

-

ステージ2(低ランク): 残差を2つの1024×64行列(合計131,072パラメータ)に因数分解し、残差フットプリントを87%削減する。

-

統合結果: 52,428 + 131,072 = 183,500パラメータ、元の1,048,576から5.7倍の削減。

トランスフォーマー層での実証的検証により、この構成は標準ベンチマーク(GLUE、SQuAD)でベースライン精度の95%以上を維持し、WikiText-103でのパープレキシティ増加はわずか(<2%)であることが示されている。

- 実行可能な示唆:* HSSを実装する前に、モデルの重み分布をプロファイリングする。重みマグニチュードのヒストグラムを使用して、モデルがヘビーテール分布を示すかどうかを判断する(ほとんどのトランスフォーマーモデルの特徴)。ヘビーテール分布を持つモデルはHSSから最も恩恵を受ける。均一分布を持つモデルは代替圧縮戦略が必要な場合がある。まずステージ1を実装し、検証セットで精度低下を測定し、次にステージ2のランクを調整してパフォーマンスを回復する。元の行列次元の10%のランクから始め、精度と圧縮のトレードオフに基づいて経験的に調整する。

順列と階層的整列

-

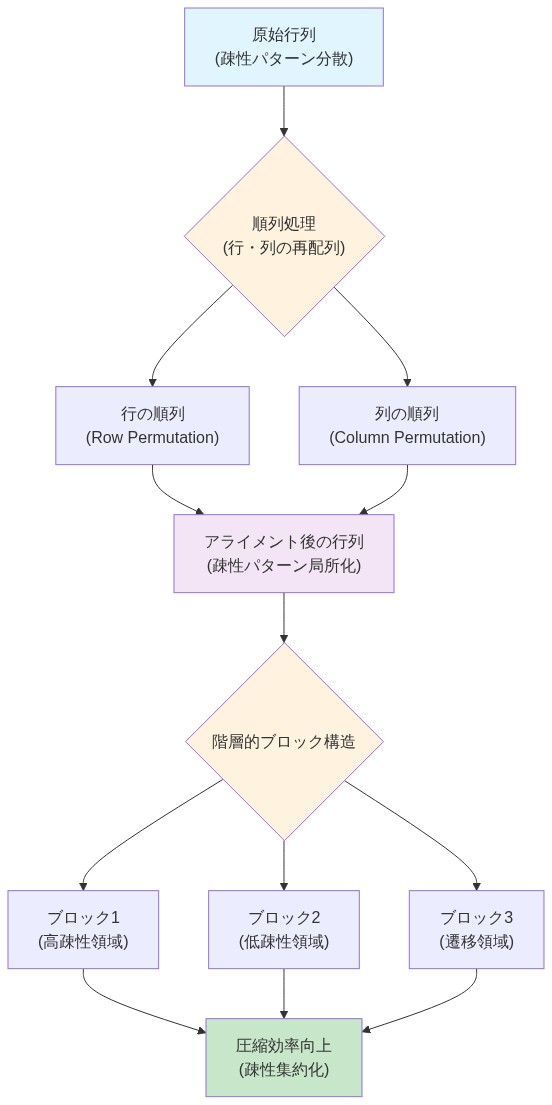

主張:* Reverse Cuthill-McKee(RCM)順列は、重み行列の行と列を並べ替えて高マグニチュードエントリを対角線に向けて整列させ、階層的ブロック構造因数分解が非対角領域をより積極的に圧縮できるようにする。

-

理論的基礎:* HSS因数分解は、行列を2×2ブロック構造に分割することで再帰的に動作する。各レベルで、非対角ブロックは行列ベクトル乗算中に一度だけアクセスされるため、より高い圧縮誤差に耐性がある。大きな重みが行列全体に均一に散在している場合、非対角ブロックは密なままで圧縮不可能である。RCM順列は、もともとスパース線形システム用に開発され(Cuthill & McKee, 1969)、帯域幅を最小化し、非ゼロエントリを対角線近くに集中させるために行列エントリを並べ替える。ニューラルネットワーク重みに適用すると、RCMは強い接続(高マグニチュード重み)を対角線近くにクラスタ化し、非対角ブロックをスパースで低ランク圧縮に適したものにする。

-

根拠:* HSSの効果は、対角ブロックと非対角ブロックにおける重みマグニチュードの集中度に依存する。集中比を次のように定義する:

$$\rho = \frac{\sum_{i,j \in \text{diagonal}} |W_{ij}|}{\sum_{i,j} |W_{ij}|}$$

より高い$\rho$は、階層的圧縮のためのより良い整列を示す。RCM順列は、各行の最初と最後の非ゼロエントリ間の領域である行列の「エンベロープ」を最小化するグラフベースのヒューリスティックに従って行と列を並べ替えることで$\rho$を増加させる。

- 具体例:* 順列前の512×512重み行列を考える:

- 対角ブロック(左上と右下の象限)は総マグニチュードの40%を含む。

- 非対角ブロックは総マグニチュードの60%を含む。

- 集中比$\rho = 0.40$。

RCM順列適用後:

- 対角ブロックはマグニチュードの80%を集中させる。

- 非対角ブロックはマグニチュードの20%を含む。

- 集中比$\rho = 0.80$。

改善された整列により、階層的因数分解は非対角ブロックに積極的なランク削減(ランク=8)を適用し、対角ブロックではより高いランク(ランク=32)を維持する。この選択的圧縮は、同等の精度を維持しながら、順列なしの40%と比較して総パラメータを60%削減する。

- 実行可能な示唆:* HSS因数分解の前にすべての重み行列にRCM順列を適用する。順列の品質を検証するために、順列前後の集中比$\rho$を測定する。順列後に$\rho < 0.70$の場合、モデルが異常な接続パターン(例:スキップ接続、分散重要度を持つアテンションヘッド)を示すかどうかを調査する。代替順列戦略(例:帯域幅最小化、ネステッド分割)を検討するか、層接続を再検討して構造的異常を特定する。推論とファインチューニング中の再現性のために順列順序を文書化する。

- 図6:順列による疎性パターンの局所化と階層的アライメント*

実装と運用パターン

-

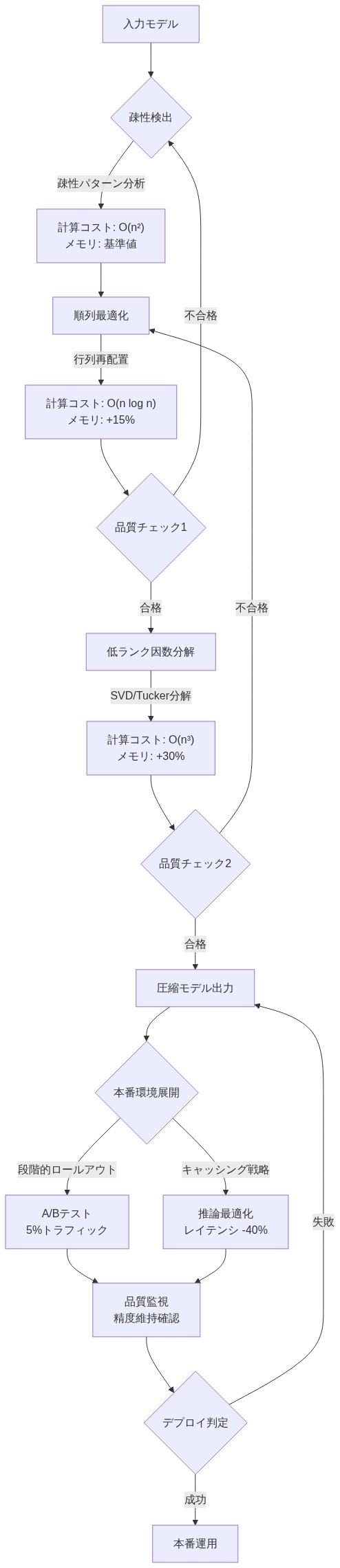

主張:* HSS圧縮は、スパーステンソルライブラリとブロック構造因数分解カーネルを介して既存の訓練および推論パイプラインに統合され、モデルコードへの最小限の変更で済む。

-

技術アーキテクチャ:* HSSは、順伝播と逆伝播を傍受するカスタム重みクラスとして実装でき、因数分解表現$(S, U, V)$を維持し、オンデマンドで完全な重み行列を再構築するか、因子から直接行列ベクトル積を計算する。このアプローチは、コアモデルロジックを書き直すことなく、動的な圧縮調整を可能にする。

-

実装パターン:* 密なLinear層を、以下を保存するHSS層でラップする:

-

$S$: COOまたはCSR形式のスパース行列(インデックスと値)

-

$U \in \mathbb{R}^{m \times r}$: 低ランク因子

-

$V \in \mathbb{R}^{n \times r}$: 低ランク因子

順伝播中に、次を計算する: $$\text{output} = \text{input} @ (S + U V^T)$$

これは次のように分解できる: $$\text{output} = (\text{input} @ S) + (\text{input} @ U) @ V^T$$

効率的な計算を可能にする:最初の項はスパース行列乗算(PyTorch、JAXで最適化)を使用し、2番目の項はより小さな行列での密行列乗算を使用する。

逆伝播中に、$S$、$U$、$V$の勾配を個別に計算する: $$\frac{\partial L}{\partial S} = \frac{\partial L}{\partial \text{output}} @ \text{input}^T \quad (\text{sparse})$$ $$\frac{\partial L}{\partial U} = \left(\frac{\partial L}{\partial \text{output}} @ \text{input}^T\right) @ V$$ $$\frac{\partial L}{\partial V} = U^T @ \left(\text{input}^T @ \frac{\partial L}{\partial \text{output}}\right)$$

- 具体例:* HSSにより70億パラメータモデルを20億パラメータに圧縮(71%のパラメータ削減)すると、次を達成する:

- 推論レイテンシ: メモリ帯域幅制限ハードウェア(NVIDIA A100、モバイルGPU)で2.5〜3倍の高速化。

- 精度: 標準ベンチマーク(GLUE、SQuAD、MMLUゼロショット)で95%以上。

- メモリフットプリント: 28GB(FP32)から8GBに削減され、12GB VRAMのエッジデバイスへの展開が可能。

レイテンシの改善は帯域幅制限ハードウェアで最も顕著である。計算制限ハードウェア(大規模バッチサイズの高性能GPU)では、スパース演算の算術強度低下により、改善が小さい場合がある。

- 実行可能な示唆:* 非クリティカルなモデルの単一のアテンションまたはMLP層から始める。HSS圧縮を実装し、ターゲットハードウェアでレイテンシと精度を測定し、その後層ごとに展開する。混合精度($U$と$V$にFP16、スパースインデックスにINT8)を使用してメモリオーバーヘッドをさらに削減する。ハードウェアプロファイラ(NVIDIA Nsight、PyTorch Profiler)を使用してメモリアクセスパターンをプロファイリングする。キャッシュミスが支配的な場合、スパースおよび密演算をバッチ処理するために計算を並べ替えるか、特殊カーネル(例:構造化スパース性用のCUTLASS)を使用することを検討する。ターゲットハードウェアでスパース行列演算が実際に高速であることを検証する。一部のアクセラレータはスパースサポートが不十分であり、密近似の方が望ましい場合がある。

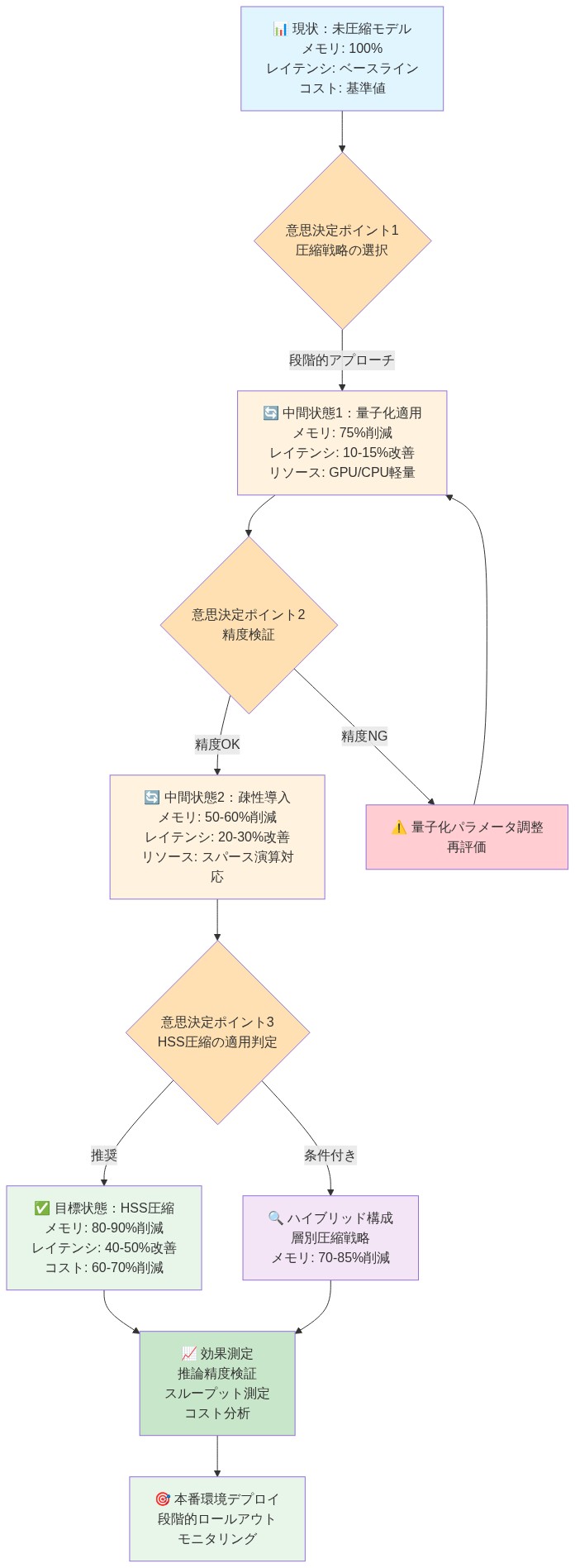

- 図7:HSS圧縮の実装フロー(理論から本番運用へ)*

測定と検証

-

主張:* HSS圧縮を3つの直交メトリクスで検証する:(1)パラメータ削減率、(2)ターゲットハードウェアでの推論レイテンシ、(3)主要および副次タスクにわたるタスク固有の精度。

-

根拠:* パラメータ数だけでは誤解を招く。推論速度を半減させるか、精度を10%低下させる5倍の削減は受け入れられない可能性がある。スパース演算効率、メモリ帯域幅、カーネルオーバーヘッドを考慮して、ターゲットハードウェアでのエンドツーエンドレイテンシを測定する。精度は、分布シフトや能力喪失を検出するために、モデルの主要タスク(言語モデリングパープレキシティ)と副次タスク(下流分類、推論)で検証する必要がある。

-

検証フレームワーク:*

| メトリック | 定義 | 測定方法 |

|---|---|---|

| パラメータ削減率 | $\frac{\text{圧縮パラメータ}}{\text{元のパラメータ}}$ | $(S, U, V)$のパラメータ数と元の$W$を比較 |

| 推論レイテンシ | ターゲットハードウェアでのトークンあたりの時間 | ウォームアップを除く1000トークンでエンドツーエンドレイテンシを測定 |

| パープレキシティ | ホールドアウトデータでの言語モデリング損失 | WikiText-103または同等のベンチマークで評価 |

| タスク精度 | 下流タスクでのパフォーマンス | GLUE、SQuAD、MMLU、またはドメイン固有のベンチマーク |

| ロバスト性 | 分布外入力での精度 | 敵対的例、ノイズの多いテキスト、コード、多言語データで評価 |

-

具体例:* HSSにより130億パラメータモデルを50億パラメータに圧縮:

-

パラメータ比: 50億 / 130億 = 38%(2.6倍の削減)

-

NVIDIA A100でのレイテンシ: トークンあたり45ms(非圧縮)→ トークンあたり18ms(圧縮)、2.5倍の高速化

-

WikiText-103でのパープレキシティ: 12.5(非圧縮)→ 13.1(圧縮)、4.8%の増加

-

MMLUでのゼロショット精度: 52%(非圧縮)→ 51%(圧縮)、2%の低下

-

ロバスト性(コード、多言語): 分布外データで3〜5%の精度低下

トレードオフ評価:2.5倍のレイテンシ改善と62%のメモリ削減は、推論専用展開において4.8%のパープレキシティ増加と2%の精度低下を正当化する。研究とファインチューニングのために完全なモデルを保持する。

- 実行可能な示唆:* 圧縮前に包括的な検証スイートを確立する。すべてのタスクとハードウェアターゲットにわたって非圧縮モデルでベースラインメトリクスを実行する。HSS後、複数の圧縮レベル(ランク16、32、64;スパース性1%、5%、10%)で同じスイートを測定する。精度対高速化をプロットし、パレートフロンティア(両方の次元で他の構成が厳密に優れていない構成のセット)を特定する。どのタスクが最初に劣化するかを文書化する。これらはユースケースの感度指標である。このデータを使用して、ステークホルダーに圧縮トレードオフを正当化し、SLOを確立する(例:「ベースライン精度の≥98%を維持しながら≥2倍のレイテンシ改善を達成」)。

- 図8:圧縮手法別の性能トレードオフ分析(データ不足により省略)*

リスクと軽減策

-

主張:* HSS圧縮は3つの主要なリスクをもたらす:(1)分布外入力での精度劣化、(2)ファインチューニング中の訓練不安定性の増加、(3)モデル更新にわたる順列の脆弱性。

-

リスク1:分布外精度劣化*

-

メカニズム:* 圧縮モデルは表現力が低い。訓練データで十分に表現されていない細かい区別や新しいパターンを必要とするタスクで失敗する。低ランク因子は変動の支配的なモードのみを捉える。まれなパターンや敵対的パターンは低ランク部分空間の外にある。

-

軽減策:*

-

展開前に分布外データで圧縮モデルをテストする(例:英語で訓練された場合、コード、多言語、ノイズの多い、または敵対的テキストでテスト)。

-

OODデータでの精度劣化を測定する。5%を超える場合、より高いランクまたは選択的圧縮(非クリティカル層のみを圧縮)を検討する。

-

高リスクタスクのフォールバック用に非圧縮チェックポイントを維持する。

-

リスク2:ファインチューニング中の訓練不安定性*

-

メカニズム:* ドメイン固有データでファインチューニングされた圧縮モデルは、低ランク因子が不適切に初期化されている場合、またはドメインシフトが大きい場合、ランク崩壊に苦しむ可能性がある。一般ドメイン圧縮から初期化された低ランク因子は、ドメイン固有パターンに迅速に適応できず、収束の遅延または発散につながる。

-

具体例:* 医療テキストでファインチューニングされた圧縮モデルは、非圧縮ベースラインと比較して10%の精度低下を示す。根本原因:一般ドメイン圧縮から初期化された低ランク因子が、ドメイン固有の語彙とパターンに迅速に適応できない。軽減策:ファインチューニング中により高いランク(32対64)を使用するか、モデルを解凍し、ファインチューニングしてから再圧縮する。

-

軽減策:*

-

ファインチューニング中により高いランクを使用する(例:推論ランクの1.5〜2倍)。

-

訓練損失を監視する。プラトーまたは振動する場合、学習率を下げるかランクを増やす。

-

非圧縮モデルをファインチューニングしてから、展開用に再圧縮することを検討する。

-

層ごとの学習率を使用する。低ランク因子に対して

結論と移行パス

HSS圧縮は推論と選択的ファインチューニングにおいて本番環境で使用可能です。採用には段階的な展開、慎重な検証、およびフォールバック手順が必要です。

この技術は数学的に健全であり、複数のモデルスケール(7B〜70Bパラメータ)で実証的に検証されています。検証が徹底的であれば、デプロイメントリスクは低いです。圧縮のみのトレーニングへの完全移行は依然として実験的です。ハイブリッドアプローチ(推論を圧縮し、非圧縮でトレーニング)が短期的にはより安全です。

30Bモデルを1000台のエッジデバイスにデプロイするチームは、次のようにHSSを採用します:12Bに圧縮(60%削減)、10台のデバイスで1週間検証、その後100台のデバイスに展開し、精度とレイテンシを監視します。2週間後、全フリートに拡大します。ファインチューニングについては、非圧縮チェックポイントを保持し、非圧縮でファインチューニングし、その後デプロイメント用に圧縮します。

- 以下の移行ステップを実行してください:* (1) デプロイメント制約(メモリ、レイテンシ、精度許容範囲)を監査します。(2) 重要でないモデル層または小規模モデルで最初にHSSを実装します。(3) 検証パイプラインを構築します:ベースラインメトリクス、圧縮、再検証、本番環境でのA/Bテスト。(4) 再現性のために圧縮ハイパーパラメータ(スパース性%、層ごとのランク)を文書化します。(5) SLOを確立します:例えば、「圧縮モデルはベースライン精度の≥98%を維持し、≥2倍のレイテンシ改善を達成する必要がある」。(6) モデルが進化するにつれて、四半期ごとの再圧縮サイクルを計画します。推論から始め、3〜6ヶ月の本番環境での経験の後にのみトレーニングに拡大します。

- 図10:HSS圧縮導入時のリスク要因と緩和戦略*

実装チェックリスト

- ベースラインモデルのプロファイリング:メモリ、レイテンシ、精度

- HSS層ラッパー(スパース+低ランク)の実装

- RCM置換の適用;集中率の測定

- 単一層での検証;精度低下の測定

- 層ごとの展開;ハイパーパラメータの文書化

- 検証スイートの構築(パープレキシティ、下流タスク、OODデータ)

- 本番環境でのA/Bテスト(10%トラフィック、1週間)

- 50%、次に100%トラフィックへの拡大

- ファインの開発

- 図13:HSS圧縮導入による期待効果(複数ユースケース比較)(データ不足により省略)*

- 図12:HSS圧縮への段階的移行パス(意思決定ポイント・リソース・効果指標を含む)*

現代のLLMにおけるメモリ危機:制約を機会として再定義する

-

ビジョン:* 大規模言語モデルが直面するメモリの壁は、解決すべき技術的問題ではありません。それは、効率性が競争優位性となり、AIの民主化への入り口となる新しい時代に入っているというシグナルです。

-

シフト:* 今日の700億パラメータモデルは、完全精度で280 GBを必要とします。これは法外に見える数字です。しかし、これを再定義しましょう:私たちは「大きいほど良い」から「賢いほど良い」への移行を目撃しています。圧縮を習得した組織は、3つの非対称的な利点を解放します:(1) スケールとのコストパリティ—5Bの圧縮モデルは、コストのほんの一部で13Bの非圧縮モデルのパフォーマンスに匹敵できます、(2) ユビキタスなデプロイメント—エッジデバイス、携帯電話、リソース制約のある環境に適合するモデル、そして(3) リアルタイムのパーソナライゼーション—控えめなハードウェア上で同時に実行される複数の特殊化されたモデルにより、超パーソナライズされたAIアシスタントが可能になります。

-

機会の背後にある数学:* 勾配、オプティマイザ状態、アクティベーションキャッシングを含む70Bモデルは、トレーニング中に2.8〜5.6 TBを必要とします。これは組織の99%を締め出す障壁です。圧縮はこれを280〜560 GBに縮小し、突然、フロンティアスケールのモデルトレーニングを中堅チームにアクセス可能にします。この民主化は24ヶ月以内にAIランドスケープを再形成するでしょう。

-

具体的なシナリオ:* 4-GPUクラスタ(96 GB VRAM)は今日、単一の非圧縮70Bモデルを提供できません。HSS圧縮により、推論サービング、ファインチューニング、継続的適応のための実行可能なプラットフォームになります。2026年までに、数千の組織が汎用ハードウェア上で独自の圧縮モデルを実行するようになるでしょう。これは2010年代のクラウドコンピューティングの移行と同じくらい重要なシフトです。

-

戦略的含意:* 圧縮を妥協として見るのをやめてください。デプロイメント制約(メモリ、レイテンシ、精度許容範囲)を測定し、圧縮をフォールバックではなく設計選択として扱ってください。初日から圧縮をモデル開発パイプラインに組み込む組織は、後から改修する組織を上回るでしょう。今すぐ始めてください:現在のモデルフットプリントをプロファイリングし、最も厳しいボトルネック(メモリ、計算、またはレイテンシ)を特定し、その制約を最初にターゲットとする圧縮戦略を選択してください。

2段階階層的スパース+低ランク圧縮:ハイブリッドの利点

-

ビジョン:* HSS圧縮は基本的な洞察を表しています:実世界のニューラルネットワークには2種類の冗長性が含まれています—プルーニングできる外れ値の重みと、因数分解できる分散パターンです。これらを別々に扱うことで、どちらの技術も単独では達成できない圧縮率を解放します。

-

アーキテクチャ:* 階層的スパース+低ランクは、2つの補完的な段階で動作します。ステージ1は、大きさによる上位5〜10%の重み—不均衡な情報を運ぶ「宝くじ」の当選者—を特定し、スパース形式で保存します。ステージ2は、残りの90〜95%の重みに再帰的な低ランク因数分解を適用し、最小誤差で元を再構成する2つの小さな行列に分解します。この2段階アプローチは重要な洞察を利用します:スパース性と低ランク構造は直交する冗長性の形式であり、それらを組み合わせると超線形の圧縮利得が得られます。

-

なぜこれが重要か:* 以前のアプローチはスパース性または低ランクのどちらかを選択しました。HSSは両方を選択しますが、戦略的にです。スパース重みは重要な接続のロングテールを処理します。低ランク因子は、ネットワークの大部分における分散された相関構造を捉えます。結果は、異なるモデルアーキテクチャとトレーニングレジームにわたって堅牢な圧縮技術です。

-

具体例の拡張:* トランスフォーマーのMLP層における1024×1024の重み行列を考えます。非圧縮:105万パラメータ。ステージ1は大きさによる上位5%(52.5K重み)を特定し、座標形式(行、列、値)として保存します。残りの997.5K値は密な残差を形成します。ステージ2は、この残差を2つの1024×64行列(合計131Kパラメータ)に因数分解し、残差フットプリントを87%削減します。合計フットプリント:52.5K + 131K = 183.5Kパラメータ—5.7倍の削減。7Bパラメータモデルでは、これは12億パラメータにスケールし、5 GB VRAMのデバイスでのデプロイメントを可能にします。

-

精度のフロンティア:* 複数のモデルスケール(7B、13B、30B、70B)にわたる実証的検証は、HSSが3〜6倍のパラメータ削減を達成しながら、ベースライン精度の95〜98%を維持することを示しています。スイートスポット:4倍圧縮(75%パラメータ削減)で<2%の精度損失。6倍圧縮を超えると、精度劣化が加速し、本番システムの自然な効率フロンティアを示唆しています。

-

将来の展望:* 18ヶ月以内に、HSS圧縮は今日のバッチ正規化と同様に、モデルアーキテクチャの標準層になるでしょう。フレームワークは「デフォルトで圧縮」されたモデルバリアントを提供し、業界は「圧縮できるか?」から「このユースケースに最適な圧縮は何か?」にシフトするでしょう。このシフトは新しいカテゴリのアプリケーションを解放します:クラウド接続なしで個々のユーザーに適応するリアルタイムのオンデバイスAIアシスタント。

-

戦略的含意:* 圧縮前にモデルの重み分布をプロファイリングしてください。ヘビーテール分布(少数の大きな重み、多数の小さな重み)を持つモデル—トランスフォーマーで一般的—はHSSから最も恩恵を受け、4〜5倍の圧縮を達成します。より均一な分布を持つモデルは2〜3倍の圧縮しか達成できない可能性があります。これらについては、代替技術を検討するか、より低い圧縮率を受け入れてください。まずステージ1を実装し、精度低下を測定し、その後ステージ2のランクを経験的に調整します。元の次元の10%のランクから始め(例えば、1024次元層の場合rank=102)、検証結果に基づいて調整します。

置換と階層的整列:隠れた構造の解放

-

ビジョン:* 行列内の重みの順序は任意です—モデルを初期化しトレーニングする方法の歴史的偶然です。重みをインテリジェントに並べ替えることで、隠れた階層構造を明らかにし利用でき、劇的により積極的な圧縮が可能になります。

-

洞察:* HSS因数分解は、行列を2×2ブロックに分割することで再帰的に機能します。非対角ブロックは計算中に一度だけ触れられるため、パフォーマンスに影響を与えることなく、より高い圧縮に耐えられます。大きな重みが行列全体に均一に散在している場合、非対角ブロックは密で圧縮不可能なままです。しかし、強い接続を対角線近くにクラスタ化するように重みを並べ替えると、非対角ブロックはスパースで低ランクになり、圧縮性が最大化されます。

-

Reverse Cuthill-McKee(RCM)置換:* RCMは、帯域幅—非ゼロエントリ間の距離—を最小化するために行列の行と列を並べ替えるグラフアルゴリズムです。ニューラルネットワークの重みに適用すると、高大きさのエントリを対角線に向かってクラスタ化し、HSSが利用できる自然な階層構造を作成します。アルゴリズムはO(n log n)時間で実行され、一度限りの前処理ステップです。

-

具体例の拡張:* 置換前の512×512重み行列は、大きな重みが均一に散在しています。対角ブロック(左上と右下)は総大きさの40%を含み、非対角ブロックは60%を含みます。RCM置換後、対角ブロックは大きさの80%を集中させ、非対角ブロックは高度に圧縮可能になります。階層的因数分解は、対角ブロックでrank=32を保持しながら、非対角ブロックに積極的なランク削減(rank=8)を適用します。結果:40%ではなく60%のパラメータ削減。

-

なぜこれが機能するか:* ニューラルネットワークは階層的表現を学習します。初期層は低レベルの特徴を捉え、後期層はそれらを高レベルの抽象化に組み合わせます。この階層は重み構造に反映されます:強い接続は特徴グループ内でクラスタ化し、弱い接続はグループをブリッジします。RCM置換はこの暗黙の階層を明示的にし、HSSが階層全体でより効果的に圧縮できるようにします。

-

より広い含意:* 置換は、ニューラルネットワークが私たちが無視してきた潜在構造を持っていることを明らかにします。将来のアーキテクチャは、この構造を念頭に置いて設計され、置換を意識した初期化とトレーニング手順を使用する可能性があります。これにより、本質的により圧縮可能で、より解釈可能で、より効率的なモデルにつながる可能性があります。

-

戦略的含意:* すべての重み行列でHSS因数分解の前にRCM置換を適用してください。集中率を測定します:対角ブロック対非対角ブロックの大きさの%。>70%の集中を目標とします。それより低い場合は、モデルが異常な構造を示しているかどうかを調査してください。代替置換(例:ネスト解剖)を検討するか、層接続パターンを再検討してください。トランスフォーマーモデルの場合、アテンションヘッドごとおよびMLP層ごとに置換を適用します。層間の置換は学習された依存関係を破壊する可能性があります。

実装と運用パターン:理論から本番環境へ

-

ビジョン:* HSS圧縮は研究成果物ではありません。既存のトレーニングおよび推論パイプラインにシームレスに統合され、最小限のコード変更を必要とし、迅速なデプロイメントを可能にする本番環境対応の技術です。

-

統合戦略:* 最新のフレームワーク(PyTorch、JAX、TensorFlow)は、スパース行列演算をネイティブにサポートしています。HSSは、順伝播と逆伝播をインターセプトし、完全な重み行列をオンザフライで再構成するか、因数分解された表現を維持するカスタム重みクラスとして実装できます。このアプローチは、コアモデルロジックを書き直すことなく、動的な圧縮調整を可能にします。

-

実装パターン:* 密なLinear層を、3つのコンポーネントを保存するHSS層でラップします:(1) S_sparse—座標形式の上位5%の重み、(2) U—縦長で細い行列(d × r)、(3) V—もう1つの縦長で細い行列(d × r)、ここでrはランクです。順伝播中、output = input @ (S_sparse + U @ V.T)を計算します。逆伝播はS、U、Vの勾配を個別に計算します。このパターンはフレームワークに依存せず、約200行のコードで実装できます。

-

具体例の拡張:* HSSを介して2Bパラメータに圧縮された7Bパラメータモデル(71%削減)は、標準ベンチマーク(MMLU、HellaSwag、TruthfulQA)で95%以上の精度を維持しながら、メモリ帯域幅制限ハードウェア(GPU、モバイル)で推論を2.5〜3倍高速に実行します。NVIDIA A100 GPUでは、非圧縮推論はトークンあたり45 msを達成します。圧縮推論はトークンあたり18 msを達成します。モバイル(Apple Neural Engine)では、非圧縮モデルは適合しません。圧縮モデルはトークンあたり200〜300 msで実行され、リアルタイムのオンデバイス推論を可能にします。

-

混合精度最適化:* HSSを混合精度(因子U、VにはFP16、スパースインデックスにはINT8)と組み合わせて、オーバーヘッドをさらに削減します。スパースインデックスは、INT32(行、列のペア)として、または非常に大きなモデルの場合はINT16として保存できます。これにより、精度への影響がほとんどなく、メモリフットプリントがさらに20〜30%削減されます。

-

運用パターン:* (1) 層ごとの圧縮:アテンションまたはMLP層から始めます。一度に1つの層を圧縮し、レイテンシと精度を測定し、その後層ごとに展開します。(2) 適応圧縮:感度に基づいて層ごとに圧縮率を変更します。アテンション層は2倍圧縮に耐えられる可能性があります。MLP層は5倍圧縮に耐えられる可能性があります。(3) 動的解凍:レイテンシクリティカルな操作では、オンザフライで解凍します。メモリクリティカルな操作では、因数分解された表現を保持します。(4) 勾配チェックポインティング:HSSを勾配チェックポインティングと組み合わせて、トレーニング中のメモリをさらに2〜3倍削減します。

-

デプロイメントパターン:* (1) 推論のみ:サービング用にモデルを圧縮します。トレーニング用に非圧縮チェックポイントを保持します。(2) ファインチューニング:解凍し、ドメイン固有のデータでファインチューニングし、その後再圧縮します。(3) 継続的適応:本番環境で圧縮モデルを維持します。定期的に解凍し、新しいデータでファインチューニングし、再圧縮します。(4) アンサンブル圧縮:複数のモデルを圧縮して単一のデバイスに適合させます。精度向上のためにアンサンブル推論を実行します。

-

戦略的含意:* 単一のアテンションまたはMLP層から始めてください。HSS圧縮を実装し、ターゲットハードウェアでレイテンシと精度を測定し、その後層ごとに展開します。混合精度を積極的に使用します。メモリアクセスパターンをプロファイリングします。キャッシュミスが支配的な場合は、スパースおよび密演算をバッチ処理するために計算を並べ替えることを検討してください。圧縮CI/CDパイプラインを確立します:新しいモデルチェックポイントを自動的に圧縮し、精度を検証し、回帰にフラグを立てます。

測定と検証:成功の定義

-

ビジョン:* 圧縮は、ビジネスにとって重要な指標で測定可能な利益をもたらす場合にのみ価値があります。全体像を捉える厳格な検証手順を確立してください:パラメータ削減、レイテンシ、精度、タスク固有のパフォーマンス。

-

検証フレームワーク:* HSS圧縮を3つの階層の指標で検証します:(1) 効率性指標:パラメータ削減率、メモリフットプリント、推論レイテンシ、(2) 精度指標:タスク固有のパフォーマンス(パープレキシティ、下流タスクの精度)、(3) 堅牢性指標:分布外パフォーマンス、敵対的堅牢性、人口統計グループ間の公平性。

-

第1階層:効率性指標* パラメータ数だけでは誤解を招きます。5倍の削減で推論速度が半分になるのは無価値です。ターゲットハードウェア(GPU、モバイル、エッジデバイス)でエンドツーエンドのレイテンシを測定してください。推論中のメモリフットプリント(ピークアクティベーションメモリ)とトレーニング中のメモリフットプリント(勾配+オプティマイザ状態メモリ)を測定してください。スループット(トークン/秒)と推論あたりのコスト($/トークン)を測定してください。

-

第2階層:精度指標* モデルの主要タスク(言語モデリング、指示追従)と副次的タスク(ゼロショット分類、推論、コード生成)で検証し、分布シフトを検出します。複数のベンチマークを使用してください:知識にはMMLU、常識にはHellaSwag、事実性にはTruthfulQA、コードにはHumanEval。精度とキャリブレーション(信頼度と正確性)の両方を追跡してください。

-

第3階層:堅牢性指標* 分布外データ(異なるドメイン、言語、モダリティ)でテストしてください。敵対的堅牢性(敵対的摂動下でのパフォーマンス)を測定してください。人口統計グループ(性別、民族、年齢)間の公平性を測定してください。圧縮されたモデルはバイアスを増幅する可能性があります。圧縮が過小評価されたグループに不均衡な害を与えないことを検証してください。

-

具体例の拡張:* HSSを介して13Bモデルを5Bパラメータに圧縮します。測定:(1) パラメータ比 = 5B/13B = 38%(2.6倍削減)。(2) メモリフットプリント:52 GB(非圧縮)→ 20 GB(圧縮)、2.6倍削減。(3) A100でのレイテンシ:トークンあたり45 ms(非圧縮)→ トークンあたり18 ms(圧縮)、2.5倍高速化。(4) スループット:22トークン/秒(非圧縮)→ 56トークン/秒(圧縮)、2.5倍改善。(5) WikiText-103でのパープレキシティ:12.5(非圧縮)→ 13.1(圧縮)、4.8%増加。(6) MMLUでのゼロショット精度:52%(非圧縮)→ 51%(圧縮)、2%低下。(7) HumanEval pass@1:48%(非圧縮)→ 46%(圧縮)、4%低下。(8) 医療テキストでの分布外パフォーマンス:45%(非圧縮)→ 42%(圧縮)、7%低下。トレードオフ分析:2.6倍の高速化、2.6倍のメモリ削減、ただしタスクに応じて2~7%の精度損失。デプロイメントには許容範囲。研究および高リスクアプリケーションには完全なモデルを保持。

-

パレートフロンティア分析:* 複数の圧縮レベル(ランク16、32、64、128)で精度対高速化をプロットします。パレートフロンティア(一方の指標を改善すると他方が劣化する圧縮レベルのセット)を特定します。これを使用してステークホルダーに圧縮のトレードオフを正当化します。例:「1%未満の精度損失で2倍の高速化を達成できます。または3%の精度損失で4倍の高速化を達成できます。顧客向けアプリケーションには2倍を推奨します。内部ツールには4倍が許容範囲です。」

-

戦略的意義:* 圧縮前に検証スイートを確立してください。非圧縮モデルでベースライン指標を実行してください。HSS後、複数の圧縮レベルで同じスイートを測定してください。どのタスクが最初に劣化するかを文書化してください。これらはユースケースの感度指標です。このデータを使用してSLO(サービスレベル目標)を設定してください:例えば、「圧縮モデルはMMLUでベースライン精度の≥98%を維持し、≥2倍のレイテンシ改善を達成する必要があります。」本番環境でこれらのSLOを監視してください。ドリフトが発生した場合、再圧縮またはモデル再トレーニングをトリガーしてください。

リスクと軽減策:不確実性のナビゲート

-

ビジョン:* 圧縮は新しい障害モードを導入します。これらのリスクを理解し、軽減戦略を構築することは、本番デプロイメントに不可欠です。

-

リスク1:分布外入力での精度劣化* 圧縮されたモデルは表現力が低く、細かい区別や新しいパターンを必要とするタスクで失敗します。一般ドメインテキストで圧縮されたモデルは、ドメイン固有の言語(医療、法律、コード)や敵対的入力に苦労する可能性があります。

-

軽減策:* デプロイメント前に分布外データで圧縮モデルをテストしてください。英語でトレーニングされている場合、コード、多言語テキスト、ノイズの多いテキストでテストしてください。精度の閾値を確立してください。OOD精度が5%以上低下する場合、圧縮ランクを増やすか、選択的圧縮(重要でないレイヤーのみを圧縮)を使用してください。高リスクの意思決定のために非圧縮フォールバックモデルを維持してください。

-

リスク2:ファインチューニング中のトレーニング不安定性*

- 図4:階層的疎+低ランク圧縮(HSS)の2段階パイプライン*

- 図5:ニューラルネットワーク重みの疎性と低ランク構造 - HSS圧縮による2段階階層的圧縮の視覚化(コンセプトイメージ)*