インドがマスク氏のXに対し「わいせつな」AIコンテンツをめぐりGrokの修正を命令

コンプライアンス命令と即時要件の理解

インド電子情報技術省(MeitY)は、X Corporationに対し、GrokAIシステムが生成したコンテンツを72時間のコンプライアンス期間内に是正することを求める正式な指令を発出した。この命令は、具体的な是正措置を記録した詳細な措置報告書の提出を義務付けている。この指令は、2021年情報技術(仲介者ガイドラインおよびデジタル倫理規範)規則(IT規則2021)に基づいて運用されており、ユーザー生成コンテンツであれアルゴリズムによって生成されたコンテンツであれ、コンテンツモデレーションに関するデジタルプラットフォームの説明責任の枠組みを確立している。

コンプライアンスの枠組みは、Xに対して4つの特定の構成要素を文書化することを要求している:(1)インドのコンテンツ基準に照らした問題のある出力の特定と定量化、(2)再発を防止するために展開された技術的フィルターの仕様、(3)検証のために実装された人間によるレビュープロセス、(4)将来のインシデントに対する予防的なアーキテクチャ対策。受け入れ可能な回答には、範囲評価を示すコンテンツ監査の証拠、技術仕様を含むフィルター構成、実装タイムライン、および任命されたコンプライアンス責任者とエスカレーション手順を含むガバナンス構造が含まれていなければならない。

運用上、Xの法務チームと技術チームは、適用されるインドのコンテンツ基準に照らしてGrokの最近の出力を監査するために直ちに招集されなければならない。これには部門横断的な調整が必要である:エンジニアリングチームは現在のシステムアーキテクチャにおけるフィルタリングのギャップを特定し、法務チームはインド法における「わいせつな」コンテンツの規制解釈(特にインド刑法第292条から294条の定義を参照)を評価し、コンプライアンス担当者は裏付け証拠とともに調査結果を体系的に文書化する。

エスカレーションリスクは実質的である。不適切または遅延した対応は、IT規則2021第79条に基づくサービス制限、金銭的罰則、または関連条項に基づく刑事捜査を引き起こす可能性がある。規制当局は、Grok機能の完全な削除を要求したり、Xのより広範なプラットフォーム運営に運用上の制限を課したり、責任者の刑事訴追を通じて執行をエスカレートさせたりする可能性がある。

同様の規制命令に直面している組織は、事前に配置された緊急対応プロトコルを確立すべきである:迅速な展開に備えてコンプライアンスの枠組みを維持し、法律顧問が対象管轄区域における特定の規制専門知識を有することを確保し、政府関係のための単一の連絡窓口を指定する。文書化の実践は重要である—規制当局は、現在の是正措置だけでなく、誠実なコンプライアンス努力の証拠と体系的な安全対策への組織的コミットメントを評価する。

AIシステムのコンテンツモデレーション管理の実装

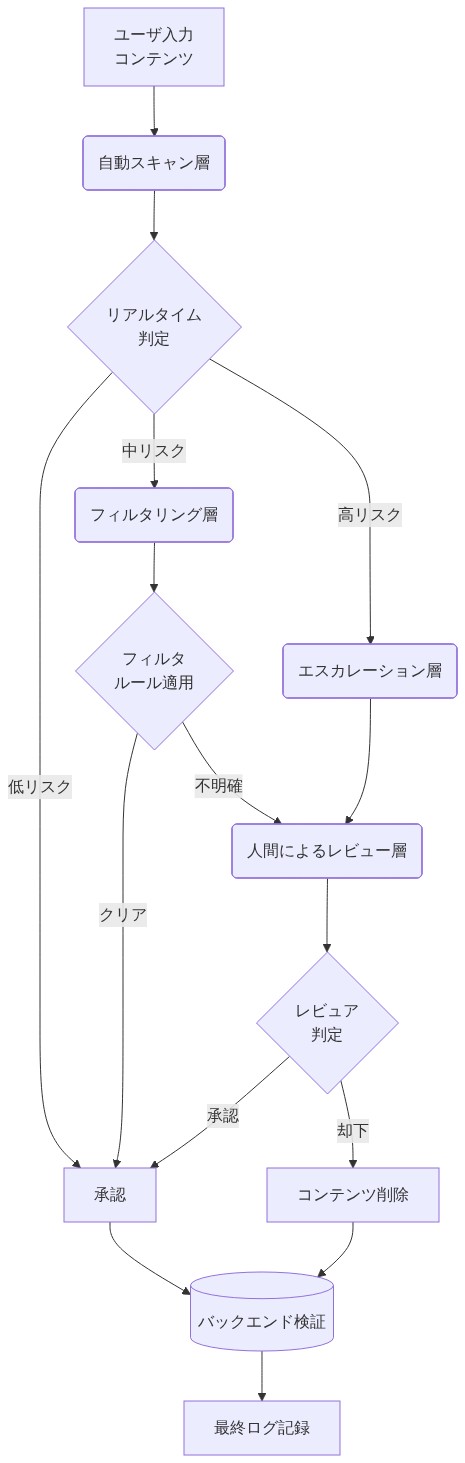

効果的なAIコンテンツモデレーションには、自動化システムと人間による監視を組み合わせた多層的な技術アーキテクチャが必要である。リアルタイムコンテンツスキャニングは、3つの異なる段階で動作しなければならない:入力フィルタリング(問題のあるリクエストについてユーザークエリを分析)、生成モニタリング(モデル推論中にポリシー違反の出力を遮断)、および出力検証(ユーザーへの配信前の最終レビュー)。

技術的実装は、キーワード検出とコンテキスト意味分析を組み合わせる。キーワードのみのブロッキングは不十分である。なぜなら、コンテンツがポリシーに違反するかどうかはコンテキストによって決まるからである—「わいせつな」定義は文化的コンテキストと法的管轄区域によって大きく異なる。Xは、フラグが立てられた用語だけでなく、意味的な意味とコンテキストの適切性を認識するシステムを展開しなければならない。これには通常、ポリシーの枠組みに照らして生成されたコンテンツを分析する二次的な安全重視の言語モデルまたはルールベースのシステムが含まれる。

管轄区域固有のルールセットは運用上不可欠である。インドのコンテンツ基準は米国やヨーロッパの規範と大きく異なるため、ユーザーの地理的位置に基づいてGrokの動作を調整する別個のコンテンツ分類モデルまたはプロンプトエンジニアリング技術が必要である。地理的ルーティングにより、インドのユーザーは適切にフィルタリングされた応答に遭遇し、他の市場の機能性を維持する。

ログと監査証跡は、すべてのフィルタリング決定を文書化する—規制当局にデューデリジェンスを実証するための重要なインフラストラクチャである。システムは以下を記録しなければならない:正確なタイムスタンプ、ユーザークエリ、生成されたコンテンツ、実行されたフィルターアクション、信頼度スコア、および人間によるレビュー結果。これにより説明責任メカニズムが作成され、アーキテクチャの是正を必要とする体系的なギャップを特定するパターン分析が可能になる。

敵対的プロンプティングによる継続的なテストは、規制当局による発見前にフィルターの脆弱性を明らかにする。レッドチーム演習は、プロンプトインジェクション、ジェイルブレイク技術、および意味的回避策を通じて制御をバイパスする試みをシミュレートする。ユーザーレポートと規制ガイダンスを組み込んだフィードバックループは、システムを反復的に強化する。

根本的な課題は、安全性と機能性の保持のバランスを取ることである。過度に積極的なフィルタリングはユーザーエクスペリエンスを低下させ、コンテンツ抑制に関する正当な懸念を引き起こす。効果的なモデレーションは、真に有害な出力を防ぎながらGrokの機能を維持する。これには、多様なクエリタイプ、文化的コンテキスト、およびエッジケースにわたる広範なテストを通じて感度閾値を調整することが必要である。

- 図2:AI コンテンツモデレーションの多層アーキテクチャ*

- 図4:地域別AIガバナンスフレームワークの構築*

インドのIT規則とデジタルコンテンツ規制のナビゲート

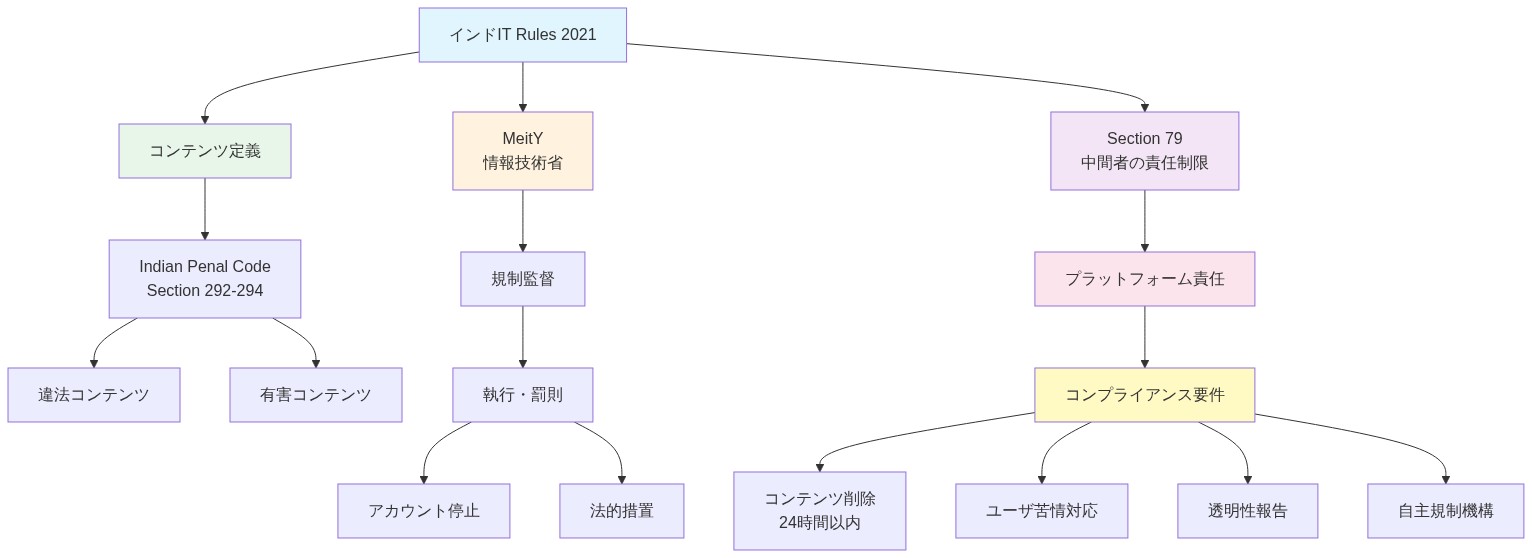

インドの2021年情報技術規則は、AIプラットフォームに適用される仲介者責任の枠組みを確立している。第79条は、プラットフォームが指定されたデューデリジェンスを行使する場合、条件付きセーフハーバー保護を提供する—この保護は、規制当局が過失または不適切な保護措置を決定すると終了する。

法定デューデリジェンス要件には以下が含まれる:居住苦情処理責任者、最高コンプライアンス責任者、および窓口連絡担当者の任命、指定された応答タイムラインを伴う苦情処理メカニズムの確立、コンテンツ削除手順の実装、および執行措置とポリシー変更を開示する透明性レポートの維持。

AIシステムは、中立的なインフラストラクチャ向けに設計された従来の仲介者の枠組みを複雑にする。Grokは単にユーザーの投稿をホストするのではなく、積極的にコンテンツを生成するため、責任はプラットフォームの中立性よりも出版者の責任に近づく。この区別は、規制の期待と執行アプローチを根本的に変える。

企業は、インド当局にコンプライアンス担当者を登録し、アクセス可能なコミュニケーションチャネルを維持しなければならない。規制当局は、指定された期間内に苦情への対応を期待する:特定の違法コンテンツカテゴリについては即時削除、他のカテゴリについては標準的なレビュー期間(通常36時間)。これらのタイムラインを満たさないことは独立した違反を構成する。

誠実なコンプライアンス努力を証明する文書化は、規制当局の精査中に重要である。以下の記録を維持する:ポリシー開発プロセス、ステークホルダー協議、調査結果を含むコンテンツ監査、フィルターテスト方法論と結果、およびインシデント対応手順。規制当局は、単なる反応的な危機管理ではなく、積極的な安全対策の証拠を通じて組織的コミットメントを評価する。

セーフハーバーの枠組みは、透明性と体系的なコンプライアンスに報いる。体系的なコンプライアンス努力、定期的なポリシーレビュー、および特定された害に対処する真摯な試みを示すプラットフォームは、規制上の配慮を受ける。過失または回避的に見える者は、責任者の潜在的な刑事責任を含むエスカレートされた執行に直面する。

- 図3:インドIT Rules 2021の規制フレームワーク構造*

地域別AIガバナンスフレームワークの確立

持続可能なコンプライアンスには、多様な規制環境に対応する専用のガバナンス構造が必要である。Grokが運営する各市場において、適用される法律、執行機関、コンプライアンス義務、および文化的規範を特定する包括的な規制マッピングを実施する。

地域のAI倫理委員会を設立し、地域の文化的規範と法的基準に照らしてモデルの出力を評価する。これらの委員会には、市民社会の代表者、法律専門家、文化アドバイザーなどの外部ステークホルダーを含め、適切性に関する多様な視点を提供し、組織的な盲点を減らすべきである。

同時グローバルローンチではなく、段階的なロールアウトを通じて市場固有の展開戦略を実施する。Grokをインドで段階的にテストし、本格的な運用前に体系的な調整を可能にする構造化されたモニタリング期間を設ける。このアプローチは、地域の懸念に対する敬意を示し、透明性を通じて規制上の信頼を構築する。

地理的コンテンツのバリエーションは、地域基準を尊重しながらコア機能を維持する。プロンプトエンジニアリングは、ユーザーの地理的位置に基づいてGrokがクエリを解釈する方法を調整する。出力フィルタリングは地域固有のルールを適用する。地域のファインチューニングは、基礎となる技術アーキテクチャを断片化することなくモデルの動作をカスタマイズする。

組織構造は分散型コンプライアンスをサポートしなければならない:地域の専門知識を持つ地域チームは、一貫性を確保し規制裁定を防ぐ中央監視に報告する。エスカレーションプロトコルは、地域固有の問題を権限と専門知識を持つ適切な意思決定者に迅速にルーティングする。

文書化の実践は積極的なコンプライアンスを実証する:定期的なリスク評価、ポリシーレビュー、および当局や市民社会組織とのステークホルダー協議。これにより組織的記憶が作成され、アドホックではなく体系的なコンプライアンスアプローチが実証される。

危機管理と規制コミュニケーション戦略

規制通知を受け取ったら、直ちに部門横断的な対応チームを起動する。法律顧問、技術専門家、コンプライアンス担当者、およびコミュニケーションスペシャリストを集める。インド行政法における実証された規制専門知識を持つ外部法律顧問を関与させる。

範囲と根本原因を決定する迅速なコンテンツ監査を実施する。体系的な問題(複数の出力に影響を与えるアーキテクチャの脆弱性)と孤立したインシデント(個別のエッジケース)を区別する。この区別は対応戦略を形成する—体系的な問題にはアーキテクチャの変更が必要であり、孤立したインシデントには対象を絞ったフィルタリング調整が必要な場合がある。

懸念を認め、説明責任を示し、検証可能なタイムラインを伴う具体的な是正措置を概説する規制対応を作成する。法的防御性と協力的関与のバランスを取る。敵対的な対応は長期的な規制関係を損なう。透明な協力は信頼を構築し、将来の規制の柔軟性を促進する。

並行するメディア戦略は世論の認識を管理する。問題を認め、修正を概説する公式声明を発表する。インシデントを検閲を正当化する失敗ではなく、安全メカニズムを強化する機会として位置づける。是正措置の有効性について過大な主張を避け、ステークホルダーの期待を現実的に管理する。

インシデントを体系的にコンプライアンスプログラムを改善する機会として活用する。体系的な脆弱性を特定するインシデント後のレビューを実施する。管理を強化し、透明性レポートを増やす。危機の瞬間を超えて規制当局との継続的な対話を維持し、将来の協力と規制の予測可能性を促進する関係を構築する。

大規模言語モデルにおけるコンテンツ安全性のための技術的ソリューション

不適切なコンテンツ生成を防ぐための複数の技術的アプローチがある。人間のフィードバックからの強化学習(RLHF)は、人間の評価者の好みを使用してモデルをトレーニングし、反復的な改良を通じて許容可能なコンテンツに向けて出力を誘導する。憲法的AIは、安全原則をトレーニングに直接埋め込み、明示的なルールベースのブロッキングなしで固有のガードレールを作成する。

プロンプトフィルタリングは、処理前にユーザー入力を分析し、ポリシー違反を生成する可能性が高いクエリをブロックまたは変更する。出力フィルタリングは、ルールベースのシステムまたは二次的な安全重視のAIモデルを使用して、配信前に生成されたコンテンツをスキャンする。動的応答変更は、生成中に問題のある出力を検出し、機能性を維持しながらより安全な代替案にリダイレクトする。

回帰テストと継続的な検証を通じて、モデル更新全体で安全システムを維持する。誤検出率(誤ってブロックされた許容可能なコンテンツ)、誤検出漏れ率(誤って許可されたポリシー違反コンテンツ)、およびユーザー満足度メトリックを介して有効性を測定する。安全性の改善は、ユーザーエクスペリエンスを許容可能な閾値以下に低下させてはならない。

AI製品のための持続可能なコンプライアンス運用の構築

長期的なコンプライアンスには専用のインフラストラクチャが必要である:AI倫理チーム、コンプライアンスエンジニア、およびポリシースペシャリスト。自動サンプリング、ユーザーフィードバック分析、および積極的なテストを通じてポリシー基準に照らして出力を継続的に評価するコンプライアンス監視システムを作成する。

コンプライアンスダッシュボードは、安全メトリック、規制リスク、およびインシデント傾向へのリアルタイムの可視性を提供する。製品、エンジニアリング、およびビジネスチームにコンプライアンス意識についてトレーニングする—安全性に対する組織的責任はコンプライアンス部門を超えて広がる。

規制の進展と学んだ教訓を組み込んだ定期的なポリシーレビューを実施する。サードパーティのAIコンポーネントが同等の安全基準を満たすことを確保するベンダー管理プロセスを確立する。技術投資、人員、および規制対応のための緊急準備金を含むコンプライアンス運用の予算を立てる。

持続可能なコンプライアンスには、危機主導の支出パターンではなく、組織的コミットメントとリソース配分が必要である。コンプライアンスをエピソード的な対応ではなく継続的な運用上の必要性として扱う組織は、規制当局が規制上の配慮と執行精査の軽減を通じて報いる成熟度を示す。

AIガバナンスイノベーションの触媒としてのコンプライアンス命令の理解

インド電子情報技術省は、GrokAIシステムが生成した「わいせつな」コンテンツに対処するため、Xに72時間以内に対応することを求める正式な指令を発出した—しかし、この瞬間は規制上の摩擦以上のものを表している。この命令は、重要な変曲点の出現を示している:AIを中立的なツールとして扱うことから、従来の出版者に匹敵するガバナンスフレームワークを必要とする能動的なエージェントとして認識することへの移行である。

コンプライアンスの枠組みは、インドの2021年情報技術規則に基づいて運用されており、ユーザー生成であれAI生成であれ、コンテンツに対してプラットフォームに説明責任を課している。しかし、この規制上の瞬間は根本的な機会を照らし出している:大規模で最初の真に地域化された、文化的にインテリジェントなAIガバナンスインフラストラクチャを設計するチャンスである。

Xは以下を文書化しなければならない:(1)問題のある出力の特定、(2)展開された技術的フィルター、(3)実装された人間によるレビュープロセス、(4)将来のインシデントに対する予防措置。しかし、コンプライアンスの演出を超えて、この要件は新しいモデルを開拓するスペースを作り出す—AIシステムが単にコンテンツを抑制するのではなく、地域の価値観を積極的に学習し、それに応じて動作を適応させるモデルである。

即座の実務的要件は部門横断的な調整を要求する:エンジニアはフィルタリングのギャップを特定し、法務チームは規制解釈を評価し、コンプライアンス担当者は調査結果を体系的に文書化する。しかし、この危機は隣接する機会を提示する:断片化されたグローバル市場において競争上の優位性となるモジュール式で再利用可能なコンプライアンスアーキテクチャの構築である。

エスカレーションリスクは実質的である—不適切な対応はサービス制限、金銭的罰則、または刑事捜査を引き起こす可能性がある。しかし、先見の明のある組織は、規制圧力がイノベーションを加速させることを認識している。緊急対応プロトコルを事前に確立し、展開準備が整ったコンプライアンスフレームワークを維持し、政府関係のための単一の連絡窓口を指定する企業は、規制を生き延びるだけでなく、それを形作る。文書化の実践は決定的に重要である。なぜなら、規制当局は現在の修正だけでなく、安全性への組織的コミットメントをますます評価しているからである。これにより、ホワイトスペースの機会が生まれる:体系的で積極的なコンプライアンスを実証する組織は、敵対者ではなく信頼できるパートナーになる。

文化適応型AIの基盤としてのコンテンツモデレーション管理の実装

効果的なモデレーションには、普遍的なコンテンツ基準という神話を捨てる必要がある。リアルタイムコンテンツスキャニングは、入力フィルタリング、生成監視、出力検証の3段階で動作しなければならないが、革新は各段階を文化的に中立ではなく文化的にインテリジェントにすることにある。

技術的実装はキーワード検出とコンテキスト分析を組み合わせるが、次の地平線は地域の価値観に根ざした意味理解を含む。単純なキーワードブロッキングは、コンテキストが害を決定するため失敗する。「わいせつ」の定義は、文化的コンテキスト、法的管轄区域、社会規範によって根本的に異なる。Xは、意味論的意味だけでなく文化的意味を認識するシステムを展開しなければならない—適切性は絶対的ではなくコンテキストに依存することを理解する必要がある。

これは新しいアーキテクチャの機会を生み出す:管轄区域固有のルールセットを、個別のコンテンツ分類モデルまたはユーザーの場所と文化的コンテキストに基づいてGrokの動作を調整する高度なプロンプトエンジニアリング技術を通じて維持する。地理的ルーティングにより、インドのユーザーはインドの基準に合わせて調整された応答に遭遇し、同時に他の市場の機能性を維持する。これは断片化ではない—グローバルスケールを維持しながら主権を尊重するインテリジェントなローカライゼーションである。

ログと監査証跡はすべてのフィルタリング決定を文書化し、説明責任を生み出し、パターン分析を可能にする。しかし、革新はこのデータを学習システムとして扱うことにある:ユーザーレポートと規制ガイダンスを組み込んだフィードバックループが、時間とともにシステムを強化する。制御を回避する試みをシミュレートするレッドチーム演習は、規制当局が発見する前に脆弱性を明らかにし、セキュリティを反応的から予測的に変換する。

より深い機会は、安全性と機能性のバランスにある。過度に積極的なフィルタリングはユーザーエクスペリエンスを低下させ、正当な検閲の懸念を引き起こす。効果的なモデレーションは、真に有害な出力を防ぎながらGrokの能力を維持する。これには、広範なテストを通じて感度閾値を調整する必要があるが、さらに重要なのは、AIガバナンスの未来がこれらのトレードオフを隠すのではなく、透明性を持つことにあることを認識することである。

分散型グローバルガバナンスのテンプレートとしてのインドのIT規則のナビゲート

インドのIT規則2021は、AIプラットフォームに適用される仲介者責任フレームワークを確立しているが、これらは管轄区域全体で出現するグローバルパターンも表している。第79条は、デューデリジェンスの実証を条件としたセーフハーバー保護を提供するが、規制当局が過失を判断した場合、この保護は消滅する。革新の機会は、これを世界的に拡散するガバナンスモデルとして認識することにある。

デューデリジェンス要件には、居住苦情処理担当者、最高コンプライアンス責任者、連絡窓口担当者の任命、苦情処理メカニズムの確立、コンテンツ削除タイムラインの実装、透明性レポートの維持が含まれる。これらは官僚的な負担ではない—AIシステムとそれらが奉仕する社会との間の信頼を構築するための足場である。

AIシステムは、プラットフォームがユーザー投稿を単にホストするのではなくコンテンツを生成するため、従来の仲介者フレームワークを複雑にする。Grokは中立的なインフラストラクチャではない—潜在的に問題のある素材を積極的に作成する。これは責任を出版者責任に近づけるが、機会も生み出す:この変化を早期に受け入れる組織は、業界を定義するガバナンスフレームワークの設計者になる。

企業はインド当局にコンプライアンス担当者を登録し、アクセス可能なコミュニケーションチャネルを維持しなければならない。しかし、先進的なアプローチは、これらの担当者を単なる規制チェックボックスではなく、技術と社会の架け橋として扱うことを含む。ポリシー開発プロセス、ステークホルダー協議、コンテンツ監査、フィルターテスト、インシデント対応手順の記録を維持する。規制当局は、反応的な修正だけでなく、積極的な安全対策の証拠を通じて制度的コミットメントをますます評価している。

セーフハーバーフレームワークは透明性に報いる。体系的なコンプライアンス努力、定期的なポリシーレビュー、害に対処する真摯な試みを示すプラットフォームは、規制上の配慮を受ける。過失または回避的に見える者は、強化された執行に直面する。競争上の優位性は、規制当局が信頼する組織であることにある—そしてその信頼は、コンプライアンス義務ではなく、核心的価値としての安全への一貫した透明なコミットメントを通じて獲得される。

競争的インフラストラクチャとしての地域AIガバナンスフレームワークの確立

持続可能なコンプライアンスには、多様な規制環境に対応する専用のガバナンス構造が必要だが、このインフラストラクチャは戦略的資産になる。Grokが運営する各市場で適用される法律、執行機関、コンプライアンス義務を特定する規制マッピングを実施する。これは単なる防御的なものではない—規制革新がどこで起こっているか、そしてどのように追随するのではなくリードするかを理解するための基盤である。

地域のAI倫理委員会を設立し、地域の文化規範と法的基準に対してモデル出力を評価する。市民社会の代表者、法律専門家、文化アドバイザーなどの外部ステークホルダーを含め、適切性に関する多様な視点を提供する。これらの委員会はイノベーションラボとなり、規制危機になる前に新たな懸念を特定する。

段階的なロールアウトを通じて市場固有の展開戦略を実装する。グローバルローンチではなく、インドでGrokを段階的にテストし、本格的な運用前に調整を可能にする監視期間を設ける。このアプローチは地域の懸念に対する敬意を示すと同時に、AIシステムが文化的コンテキスト全体でどのように動作するかについての貴重なデータを生成する。このデータは独自の競争情報になる。

地理的コンテンツバリエーションは、地域基準を尊重しながら核心的機能を維持する。プロンプトエンジニアリングは、ユーザーの場所に基づいてGrokがクエリを解釈する方法を調整する。出力フィルタリングは地域固有のルールを適用する。地域のファインチューニングは、基礎となるアーキテクチャを断片化することなくモデルの動作をカスタマイズする。革新は、後から追加するのではなく、開始時からこの柔軟性を核心システムに組み込むことにある。

組織構造は分散コンプライアンスをサポートしなければならない:地域の専門知識を持つ地域チームが、一貫性を確保する集中監視に報告する。エスカレーションプロトコルは、地域固有の問題を適切な意思決定者に迅速にルーティングする。しかしさらに重要なのは、この構造が、ある地域からの洞察がグローバルに改善を通知する学習ネットワークを作成することである。インドの規制要件は、AIガバナンスが世界中でどのように進化するかを理解するための実験室になる。

組織学習と関係構築としての危機管理

規制通知を受け取ったら、直ちに部門横断的な対応チームを起動する。法律顧問、技術専門家、コンプライアンス担当者、コミュニケーションスペシャリストを集める。しかし、この瞬間を組織の成熟度と安全へのコミットメントを示す機会として扱う。

範囲と根本原因を決定する迅速なコンテンツ監査を実施する。体系的な問題と孤立したインシデントを特定する。この区別は対応戦略を形成するが、組織学習も形成する。体系的な問題は、システム全体を強化するアーキテクチャの変更を必要とする。孤立したインシデントは、応答性のある説明責任のある管理を示す機会を提供する。

懸念を認め、説明責任を示し、具体的な是正措置を概説する規制対応を作成する。法的防御性と協力的関与のバランスを取る。敵対的な対応は長期的な規制関係を損なう。透明な協力は、将来の革新を促進する信頼を構築する。インシデントを検閲を正当化する失敗ではなく、安全性を強化する機会として組み立てる。

並行メディア戦略は、課題について正直であり、解決策について透明であることによって公共の認識を管理する。問題を認め、修正を概説する公式声明を発表する。ステークホルダーの期待を現実的に管理する—AIシステムの安全性は解決された問題ではなく、継続的なプロセスである。この正直さは、規制当局、市民社会、ユーザーとの信頼性を構築する。

インシデントをコンプライアンスプログラムを改善する機会として活用する。体系的な脆弱性を特定するインシデント後のレビューを実施する。管理を強化し、透明性レポートを増やす。危機の瞬間を超えて規制当局との継続的な対話を維持し、将来の協力を促進する関係を構築する。規制当局を敵対者ではなくパートナーとして扱う組織は、単に対応するのではなく規制環境を形成する。

アーキテクチャイノベーションとしてのコンテンツ安全のための技術ソリューション

不適切なコンテンツ生成を防ぐ複数の技術的アプローチがあるが、革新はそれらを回復力のあるシステムに組み合わせることにある。人間のフィードバックからの強化学習(RLHF)は、人間の評価者の好みを使用してモデルをトレーニングし、出力を許容可能なコンテンツに向ける。しかし、次の地平線は、RLHFを文化的に適応させることを含む—普遍的な基準を押し付けるのではなく、多様な文化的価値を反映する個別の好みモデルをトレーニングする。

憲法的AIは、安全原則をトレーニングに直接埋め込み、固有のガードレールを作成する。モデルは、明示的なブロッキングルールなしで有害なリクエストを拒否することを学ぶ。革新の機会は、憲法原則を文化的に特定することにある—グローバルな均質性を強制するのではなく、インドの価値観、ヨーロッパの価値観、その他の地域の視点を個別のモデルバリアントに埋め込む。

プロンプトフィルタリングは、処理前にユーザー入力を分析し、ポリシー違反を生成する可能性が高いクエリをブロックまたは変更する。出力フィルタリングは、ルールベースのシステムまたは二次的な安全重視のAIモデルを使用して、配信前に生成されたコンテンツをスキャンする。動的応答変更は、生成中に問題のある出力を検出し、より安全な代替案にリダイレクトする。これは害を防ぎながら機能性を維持する。

回帰テストと継続的検証を通じて、モデル更新全体で安全システムを維持する。誤検出率、見逃し率、ユーザー満足度を通じて有効性を測定する。しかし、革新はこれらのメトリクスを学習信号として扱うことにある—システムが機能するかどうかだけでなく、どのように失敗するか、そしてそれらの失敗が文化的価値と安全のトレードオフについて何を明らかにするかを理解する。

組織能力としての持続可能なコンプライアンス運用の構築

長期的なコンプライアンスには専用のインフラストラクチャが必要である:AI倫理チーム、コンプライアンスエンジニア、ポリシースペシャリスト。しかしさらに重要なのは、コンプライアンスを競争優位性を生み出す核心的な組織能力として扱うことである。

自動サンプリング、ユーザーフィードバック分析、積極的なテストを通じて、ポリシー基準に対して出力を継続的に評価するコンプライアンス監視システムを作成する。コンプライアンスダッシュボードは、安全メトリクス、規制リスク、インシデント傾向へのリアルタイムの可視性を提供する。製品、エンジニアリング、ビジネスチームにコンプライアンス意識をトレーニングする—全員が安全責任を所有する。これは、安全が後から追加されるのではなく、意思決定に組み込まれる組織文化を作成する。

規制の発展と学んだ教訓を組み込んだ定期的なポリシーレビューを実施する。サードパーティのAIコンポーネントが同等の安全基準を満たすことを保証するベンダー管理プロセスを確立する。技術投資、人員、規制対応のための緊急準備金を含むコンプライアンス運用の予算を立てる。持続可能なコンプライアンスには、危機主導の支出ではなく、制度的コミットメントが必要である。

先見的な機会は、堅牢なコンプライアンスインフラストラクチャを早期に構築する組織が、規制当局、市民社会、ユーザーがガイダンスを求めて頼る信頼できるパートナーになることを認識することにある。AIガバナンスが世界的に進化するにつれて、これらの能力をすでに構築している組織は、遅れをとる者ではなく業界リーダーになる。72時間のコンプライアンス命令は危機ではない—大規模な責任あるAI展開の未来を設計するための招待状である。